B. LE MANAGEMENT ALGORITHMIQUE DOIT ÊTRE MIEUX RÉGULÉ AFIN DE LIMITER LES DISCRIMINATIONS À L'ÉGARD DES TRAVAILLEURS DES PLATEFORMES ET DE GARANTIR LEUR INDÉPENDANCE RÉELLE

1. La compréhension des algorithmes par les travailleurs et leurs représentants paraît primordial

a) Garantir l'intelligibilité des algorithmes

(1) La transparence des algorithmes : un objectif souhaité et partiellement concrétisé

Dans le cadre des auditions menées par la mission d'information, les discussions relatives à la nécessité de garantir la transparence des algorithmes des plateformes numériques ont été nombreuses. Cependant, la notion de transparence des algorithmes désigne, selon les interlocuteurs, leur statut et leurs opinions sur le sujet, des réalités différentes qui n'ont pas les mêmes implications pour les entreprises.

D'une part, la transparence est entendue au sens de ce qui est facilement compréhensible , ce qui supposerait que les plateformes numériques informent complètement sur le fonctionnement de leurs algorithmes et leur utilisation. D'autre part, la transparence des algorithmes est également entendue comme la publication du code source , qui peut ainsi être libre d'accès, consultable, réutilisable et modifiable.

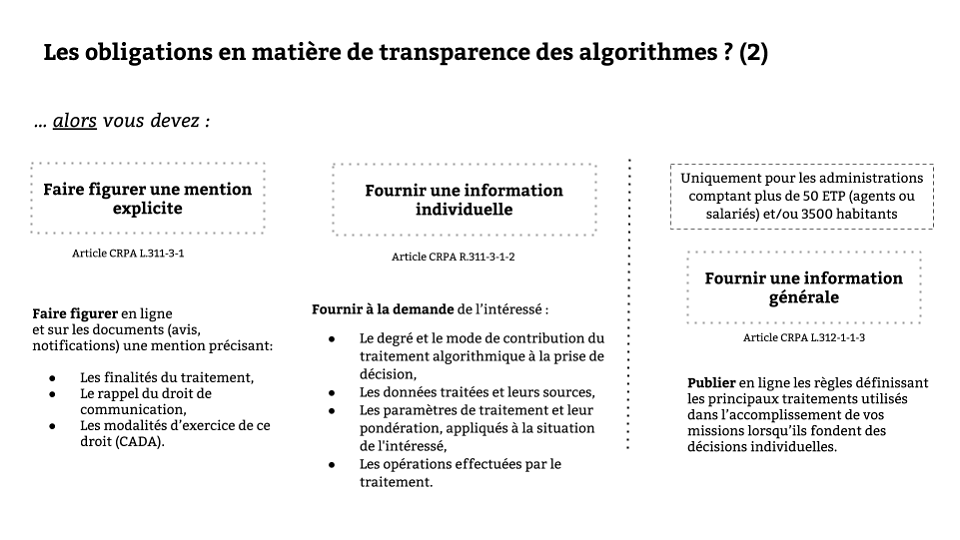

Dans le cadre des algorithmes publics, le cadre juridique a récemment évolué pour renforcer les exigences de transparence qui leur sont applicables . En effet, les algorithmes publics sont soumis à des exigences particulières, puisqu'ils doivent permettre de servir l'intérêt général et contribuent à l'application du droit auprès des administrés, c'est-pourquoi il y a une exigence de redevabilité de la part des administrations utilisatrices qui doivent être en mesure d'informer les citoyens du fonctionnement des algorithmes utilisés pour prendre des décisions les concernant.

Plus précisément, ces nouvelles obligations introduites par la loi pour une République numérique de 2016 et par le règlement général sur la protection des données de 2018 ont été codifiées au sein du code des relations entre le public et l'administration (CRPA).

Source : guides.etalab.gouv.fr

Les administrations d'Etat, les collectivités territoriales, les organismes de droit public ou de droit privé intervenant dans le cadre d'une mission de service public 229 ( * ) qui utilisent le traitement automatisé des données pour prendre des décisions individuelles sont concernés par les exigences de transparence des algorithmes résumées par le schéma ci-dessus.

(2) L'objectif d'intelligibilité des algorithmes des plateformes

Les exigences de transparence applicables aux algorithmes publics utilisés par les administrations ne sont pas transposables en l'état aux algorithmes privés utilisés par les plateformes numériques et les entreprises, ces-dernières bénéficiant de plusieurs protections juridiques permises par le droit de la propriété intellectuelle, la législation relative à la protection des brevets ou encore celle relative au secret des affaires.

La transparence, dans le sens de la publication du code source et du langage informatique des algorithmes, n'est pas forcément un objectif souhaitable, ni réaliste . En effet, les algorithmes constituant le principal actif stratégique immatériel des plateformes, reflétant le modèle économique et les choix décidés par leurs dirigeants, doivent aussi faire l'objet de protections spécifiques afin de garantir des conditions équitables de concurrence entre plateformes.

Il existe, à la marge, des plateformes qui ont choisi de rendre publics les logiciels et algorithmes qu'elles utilisent , ce qui est par exemple le cas de la plateforme numérique coopérative Coopcycle . En effet, cette plateforme, qui porte un projet économique et social en rupture avec le modèle économique et social promu par les grandes plateformes numériques, a développé son propre logiciel, Coopyleft , mais avec des spécificités d'utilisation commerciale qui vise à promouvoir le développement des plateformes numériques.

Selon un représentant de Coopcycle , le travail de consultation et d'élaboration de la licence a permis de garder « l'esprit de l'open source (diffusion de l'usage d'un logiciel libre) sous conditions sociales de son utilisation (salarisation des travailleurs s'opposant à l'exploitation du travail gratuit, usage commercial par des coopératives où les décisions sont prises démocratiquement) » 230 ( * ) .

Néanmoins, la très grande majorité des plateformes, et notamment celles avec le volume d'activité le plus élevé, ne rendent pas publics les algorithmes et logiciels utilisés pour leurs activités commerciales. Par conséquent, il est nécessaire de privilégier la compréhension des algorithmes par les entreprises utilisatrices et par ceux dont les conditions de rémunération et de travail peuvent être déterminées par algorithme . Or, force est de constater que peu de personnes aujourd'hui, à l'exception des concepteurs d'algorithmes les plus qualifiés, sont en mesure de comprendre les logiques algorithmiques sous-tendues par un langage informatique peu accessible au grand public.

Autrement dit, « il ne s'agira pas de révéler la complexité technique du système, mais de rendre la logique générale de l'algorithme accessible » 231 ( * ) .

(3) L'intelligibilité des algorithmes : un objectif qui doit devenir concret

Ces dernières années, les initiatives juridiques et politiques se sont multipliées pour favoriser l'intelligibilité, la compréhension ou l'explicabilité des algorithmes, selon les terminologies employées, sans toutefois que les critiques et les craintes relatives au manque de transparence des algorithmes ne se soient atténuées .

Parmi les initiatives politiques en la matière, il y a par exemple le rapport de Cédric Villani de 2018 sur l'intelligence artificielle appelle à « ouvrir les boîtes noires » et à promouvoir davantage l'explicabilité et l'auditabilité des algorithmes plutôt que leur transparence . Plus concrètement, le rapport mentionne « la constitution d'un corps d'experts publics assermentés, en mesure de procéder à des audits d'algorithmes, des bases de données et de procéder à des tests par tout moyen requis. Ces experts pourraient être saisis à l'occasion d'un contentieux judiciaire, dans le cadre d'une enquête diligentée par une autorité administrative indépendante ou suite à une demande du Défenseur des droits » 232 ( * ) .

En 2019, la déclaration du G20 fixait des principes relatifs à un usage responsable des outils d'intelligence artificielle dont les acteurs doivent garantir la transparence et l'explicabilité afin de :

- de favoriser une compréhension générale des systèmes d'IA ;

- d'informer les parties prenantes de leurs interactions avec les systèmes d'IA, y compris dans la sphère professionnelle ;

- de permettre aux personnes concernées par un système d'IA d'en appréhender le résultat ;

- de permettre aux personnes subissant les effets néfastes d'un système d'IA de contester les résultats sur la base d'informations claires et facilement compréhensibles sur les facteurs, et sur la logique ayant servi à la formulation de prévisions, recommandations ou décisions.

Parmi les initiatives juridiques en la matière, et au-delà des dispositions spécifiques aux algorithmes publics utilisés par l'administration qui contribuent à alimenter les débats relatifs aux algorithmes des plateformes, le règlement général sur la protection des données (RGPD) intègre par exemple la notion de transparence des algorithmes. Ainsi, l'article 13 dispose qu'en cas d'utilisation de données à caractère personnel, le responsable du traitement fournit les informations nécessaires « pour garantir un traitement équitable et transparent », dont « l'existence d'une prise de décision automatisée (...) et des informations utiles concernant la logique sous-jacente, ainsi que l'importance et les conséquences prévues de ce traitement par la personne concernée ».

Le règlement européen dit « Platform to Business » (P2B), s'inscrit également dans un mouvement de renforcement des exigences légales applicables aux plateformes en matière de transparence . D'une part, il est prévu que les places de marché et les moteurs de recherche doivent indiquer les principaux paramètres qu'ils utilisent pour classer les biens et les services sur leurs sites. D'autre part, l'obligation d'informer les entreprises utilisatrices des plateformes de la possibilité d'influer sur les résultats du classement de l'algorithme en contrepartie d'une rémunération directe ou indirecte. Enfin, l'obligation d'informer les entreprises du traitement différencié qui pourrait être accordé par la plateforme dans le cadre du référencement des offres.

Sans que ces exemples ne constituent une liste exhaustive des initiatives politiques et juridiques prises ces dernières années pour favoriser l'explicabilité des algorithmes et des logiques qui les sous-tendent, la mission d'information considère qu'il est aujourd'hui impératif que les plateformes mettent en oeuvre des processus internes permettant d'assurer la compréhension des algorithmes, notamment à destination des travailleurs et de leurs représentants .

b) Permettre l'accès des travailleurs des plateformes et de leurs représentants à des informations compréhensibles sur le fonctionnement des algorithmes

(1) L'enjeu de la compréhension du fonctionnement des algorithmes par les travailleurs

Dans le cadre des différentes auditions d'acteurs économiques menées par la mission d'information, la question des mesures mises en oeuvre par les plateformes numériques pour favoriser la compréhension du fonctionnement des algorithmes par les travailleurs a été régulièrement posée.

Plusieurs plateformes ont ainsi indiqué transmettre des informations à ce sujet à leurs travailleurs et assurer des voies de communication leur permettant de faire part de leurs interrogations. Par exemple, et sans que cela ne constitue une liste d'exemples exhaustifs, les plateformes suivantes ont transmis les informations ci-dessous relatives à l'information de leurs travailleurs :

- la plateforme Uber a indiqué travailler continuellement « à assurer une information transparente et compréhensible du fonctionnement des algorithmes (attribution des courses par exemple) » 233 ( * ) et a publié plusieurs articles pédagogiques visant à expliquer les mécanismes d'attribution des courses 234 ( * ) ou de suspension de l'activité d'un travailleur 235 ( * ) .

- la plateforme Deliveroo a mis en place un « Forum des livreurs », qui se réunit chaque trimestre avec les 25 représentants élus des livreurs et à l'occasion duquel les questions relatives au fonctionnement des algorithmes peuvent être abordées. Par ailleurs, il a été indiqué que « tout livreur partenaire de notre plateforme dispose de la possibilité de joindre la plateforme afin de demander des éclaircissements sur des décisions qui seraient prises concernant son activité de livreur partenaire. Il convient de noter que toute décision prise l'est sur le fondement de critères précis que nos équipes ont développés, et que toute décision est communiquée aux livreurs partenaires de la plateforme, quelle qu'elle soit » 236 ( * ) ;

- la plateforme Wecasa a également indiqué qu'un centre d'aide, une vidéo explicative et un podcast avaient été développés pour ses travailleurs afin de mieux leur expliquer le fonctionnement de l'algorithme. Il a également été indiqué « qu'en cas de doutes ou de questions, les professionnels ont la possibilité de contacter le service client disponible 7j/7 de 8h à 20h qui se chargera si nécessaire de faire remonter en interne. Ces retours permettent d'améliorer en continu le fonctionnement » 237 ( * ) .

Si les initiatives développées par les plateformes pour favoriser les échanges avec leurs travailleurs, notamment concernant le fonctionnement des algorithmes et des décisions prises avec leur appui, sont souhaitables, les éléments de réponse apportés à la mission d'information apparaissent toutefois très insuffisants face à l'ampleur des enjeux liés à la compréhension des algorithmes . En effet, dans la mesure où les algorithmes peuvent avoir des conséquences sur les conditions de travail et le niveau de rémunération des travailleurs, et conduire à des situations discriminatoires, les efforts des plateformes ne sont pas à la hauteur des enjeux que ces questions représentent pour leurs travailleurs et l'amélioration de leurs conditions de vie et de travail.

(2) L'enjeu de la compréhension du fonctionnement des algorithmes par les représentants des travailleurs

Les différentes auditions ont soulevé la question de la représentation des travailleurs des plateformes et de la mise en oeuvre du dialogue social a été régulièrement abordée.

À cet égard, l'ordonnance du 21 avril 2021 prévoit un processus de désignation des représentants des seuls travailleurs de mobilité, sans toutefois que les modalités de leur élection ne soient précisées, ni que des thèmes de négociation collective ne soient identifiés.

Or, il est primordial que les enjeux relatifs au management algorithmique et à la compréhension des logiques de fonctionnement des algorithmes soient abordés dans le cadre du dialogue social qui se met progressivement en place pour les plateformes de mobilité et qui, la mission d'information le recommande, devrait également concerner à moyen terme les plateformes des autres secteurs d'activité . En effet, les travailleurs des plateformes de mobilité sont particulièrement exposés aux décisions prises par les algorithmes de tarification dynamique, ce qui a des conséquences tangibles sur le niveau de rémunération et leur qualité de vie au travail.

Dans la mesure où les représentants des travailleurs contribuent au dialogue avec la direction des plateformes dans le but d'améliorer les conditions de rémunération et de travail des travailleurs, la mission d'information est convaincue de la nécessité de garantir aux représentants des travailleurs une information claire, intelligible et sur demande sur les logiques de fonctionnement des algorithmes afin que ces représentants puissent pleinement exercer le mandat ou la mission qui leur a été confié .

À la différence des plateformes numériques au sein desquelles le dialogue social commence seulement à se structurer, les entreprises qui emploient des salariés sont déjà dotées d'institutions représentatives du personnel, dont les modalités d'élection, de composition, les missions et les compétences sont définies par le droit du travail. Ainsi, pour les entreprises utilisant des algorithmes et des outils d'intelligence artificielle susceptibles d'avoir des conséquences sur leurs salariés, notamment si ces outils sont utilisés en matière de ressources humaines pour le recrutement et la gestion du personnel, il est nécessaire de prévoir des modalités d'information et de consultation des institutions représentatives du personnel déjà en place sur les enjeux du management algorithmique .

Dans cette perspective, le comité social et économique (CSE) des entreprises devrait être informé des décisions prises en matière d'utilisation des algorithmes et des outils d'intelligence artificielle au sein des entreprises . Selon Yann Leroy, « dans la mesure où le management algorithmique a des conséquences en matière d'activité et d'emploi et de gestion du personnel, les questions relatives à l'utilisation de l'IA peuvent être abordées dans ce cadre de consultation. Les investissements technologiques entrent dans le champ des discussions relatives à la situation économique de l'entreprise tandis que les conditions de travail relèvent de la politique sociale » 238 ( * ) .

Le CSE devant être instauré dans toutes les entreprises d'au moins onze salariés et disposant de compétences relativement larges en matière de politiques économique, sociale et environnementale, cette institution représentative du personnel semble en effet être un cadre de consultation approprié pour aborder les questions relatives au management algorithmique dans l'entreprise, d'autant plus que les membres du CSE sont soumis à une obligation de confidentialité.

Plus spécifiquement, Yann Leroy recommande par exemple que le CSE joue un rôle de contrôle, en vérifiant par exemple que l'employeur ait bien effectué une déclaration auprès de la Commission nationale de l'information et des libertés (CNIL) en cas d'utilisation d'un traitement automatisé de données pour la gestion du personnel, ou encore en exerçant un regard critique sur les données utilisées pour la conception des algorithmes. Pour mener à bien ce rôle de contrôle, les CSE devraient pouvoir bénéficier de l'assistance d'un expert qualifié, indépendant et externe à l'entreprise.

|

Proposition n° 11 : garantir aux représentants des travailleurs des plateformes un droit de se faire communiquer un document compréhensible et actualisé détaillant les logiques de fonctionnement des algorithmes. |

|

Proposition n° 12 : rendre applicable aux représentants des travailleurs des plateformes les obligations de confidentialité et de discrétion professionnelle qui incombent aux représentants du personnel des entreprises afin de faciliter la mise en oeuvre d'un dialogue social sur le contenu des algorithmes. |

|

Proposition n° 13 : consulter les comités économiques et sociaux sur l'introduction, l'utilisation et la modification des algorithmes et outils d'intelligence artificielle dans les entreprises et leur permettre de bénéficier de l'assistance d'un expert indépendant et externe à l'entreprise. |

(3) L'algorithme : un sujet de négociation collective ?

S'il y a un véritable effort collectif à faire afin d'améliorer les modalités d'information et de consultation des représentants des travailleurs des plateformes et des institutions représentatives du personnel des entreprises sur les questions relatives à l'utilisation des algorithmes, le rôle des représentants des travailleurs des plateformes, des salariés et des syndicats pourrait être plus ambitieux.

En effet, il a également été question de « faire du contenu de l'algorithme un objet de négociation » 239 ( * ) . Certaines personnes auditionnées ayant par exemple affirmé que « soumettre dès aujourd'hui les algorithmes au dialogue social est la solution pragmatique la plus adaptée » 240 ( * ) .

Selon les travaux de l'Institut syndical européen (ETUI) 241 ( * ) , le rôle des partenaires sociaux et des syndicats dans la régulation du management algorithmique et l'atténuation des risques que cela peut provoquer chez les travailleurs est négligé : « la négociation collective demeure certainement l'outil le plus efficace pour se protéger face aux avancées technologiques rapides en matière de management algorithmique ». Dans la mesure où le management algorithmique conduit à l'introduction de techniques de surveillance et d'évaluation constantes sur le lieu de travail afin de récolter des données sur les travailleurs et leur activité, la négociation de droits collectifs est perçue comme un moyen de limiter les prérogatives de l'employeur qui peuvent être renforcées par l'utilisation des nouvelles technologies et au détriment des travailleurs.

Dans cette perspective, les syndicats devraient être associés aux décisions stratégiques conduisant à l'utilisation d'algorithmes et d'outils d'intelligence artificielle, afin qu'ils puissent représenter les intérêts des travailleurs, permettre une meilleure prise en compte des conséquences des décisions algorithmiques sur le niveau de rémunération et les conditions de travail et négocier des droits collectifs et des protections pour les travailleurs . Les chercheurs de l'ETUI 242 ( * ) appellent notamment les syndicats européens à se poser les questions suivantes afin de s'approprier progressivement les enjeux propres à l'utilisation des algorithmes :

- savez-vous si le management algorithmique est utilisé dans votre pays et, si oui, dans quelle mesure ?

- avez-vous connaissance des risques liés à ces nouvelles technologies ?

- votre législation nationale offre-t-elle suffisamment de protections face aux risques posés par le management algorithmique ou doit-elle être modifiée ?

- comment les droits à l'information et à la consultation peuvent-ils influencer le management algorithmique ?

- comment les conventions collectives peuvent-elles fournir une protection plus appropriée face aux risques liés au management algorithmique ?

- quel rôle les syndicats peuvent-ils jouer dans la réglementation du management algorithmique ?

- avez-vous connaissance du projet de règlement de l'Union européenne relatif à une approche européenne de l'intelligence artificielle ?

Au regard des différents éléments portés à la connaissance de la mission d'information, cette dernière considère que le management algorithmique doit être un sujet de négociation collective, en particulier pour les travailleurs des plateformes, mais pas seulement. Dans cette perspective, la mission d'information souhaite saluer les évolutions législatives récentes qui ont eu lieu en Espagne à ce sujet.

|

La loi dite « Rider » en Espagne Le 11 mai 2021, le gouvernement espagnol a présenté un projet de loi relatif aux travailleurs des plateformes de livraison de repas à domicile, telles que Deliveroo , Glovo ou Uber Eats , et qui concerne entre 15 000 et 30 000 travailleurs en activité dans le pays. Cette loi, présentée comme le fruit de plusieurs mois de négociation avec les partenaires sociaux, reconnaît une présomption de salariat pour cette catégorie de travailleurs qui, dans un délai de trois mois à compter de la promulgation de la loi, soit depuis le mois d'août 2021, sont désormais reconnus comme salariés. Cette loi renforce également les contraintes des plateformes en matière de transparence des algorithmes. En effet, elle oblige les plateformes, et pas seulement celles de livraison de repas à domicile, à communiquer les paramètres des algorithmes utilisés aux syndicats, dans la mesure où il est considéré que ces algorithmes conditionnement la charge et les conditions de travail. Selon la ministre espagnole du Travail, Yolanda Diaz, « les salariés sont en droit, de connaître la réalité des règles qui conditionnent leur travail et le pénalisent en définissant des conditions de rendement jusqu'ici opaques », l'objectif de ces dispositions étant « d'offrir la transparence et d'éviter la punition algorithmique » 243 ( * ) . |

En France, au regard des évolutions législatives et règlementaires récentes et afin d'accompagner les représentants des travailleurs des plateformes, il est proposé de compléter les missions de l'Autorité des relations sociales des plateformes d'emploi, créée par l'ordonnance du 21 avril 2021. L'Autorité a notamment pour mission de promouvoir auprès des représentants des travailleurs et des plateformes le dialogue social et la concertation. Dans cette perspective, elle pourrait également être dotée d'une expertise particulière en matière d'explicabilité des algorithmes auprès des représentants des travailleurs, en s'assurant du respect par ces derniers de leur obligation de confidentialité.

|

Proposition n° 14 : compléter les missions de l'Autorité des relations sociales des plateformes d'emploi afin qu'elle puisse épauler les représentants des travailleurs des plateformes dans les discussions et négociations relatives au fonctionnement des algorithmes et à leurs conséquences pour les travailleurs. |

c) Les entreprises ont un devoir de vigilance dans l'utilisation des algorithmes

(1) La compréhension du fonctionnement des algorithmes par les entreprises

Si la très grande majorité des plateformes numériques auditionnées dans le cadre de la mission d'information ont indiqué développer leurs algorithmes en interne avec leurs propres équipes, beaucoup d'entreprises utilisant des algorithmes font appel à des prestataires extérieurs spécialisés dans la conception d'algorithmes et la programmation informatique.

En raison de la complexité technique inhérente au développement d'algorithmes et du manque de connaissance général en matière de programmation informatique, des prestataires extérieurs peuvent proposer des solutions « clés en main » et livrer un produit fini sans toutefois que l'entreprise utilisatrice de l'algorithme ne soit en mesure d'en comprendre les logiques sous-jacentes et le fonctionnement : « les règles de fonctionnement des algorithmes sont aujourd'hui opaques pour les travailleurs, voire pour les employeurs. Il n'est pas rare que seul l'auteur du code, prestataire externe à l'entreprise, soit capable de l'expliciter en intégralité » 244 ( * ) .

Or, les premiers interlocuteurs des travailleurs et de leurs représentants sont les entreprises et les plateformes, et non leurs prestataires extérieurs. C'est pourquoi ces dernières doivent être en mesure d'apporter à temps des informations fiables, compréhensibles et actualisées sur le fonctionnement des algorithmes qu'elles utilisent. Comme le rappel le think tank #Leplusimportant 245 ( * ) , l'intelligibilité des algorithmes est un prérequis indispensable pour que les travailleurs puissent s'engager contractuellement en connaissance de cause, et pour limiter les biais discriminatoires susceptibles de résulter du fonctionnement des algorithmes.

Dans cette perspective, la mission d'information souhaite encourager au maximum les entreprises utilisatrices à exiger, lors de la négociation du contrat de prestation de services avec un prestataire spécialisé dans le développement des algorithmes, des « clauses d'explicabilité et d'auditabilité » opposables à leur émetteur. En effet, les entreprises utilisatrices, dont la responsabilité pourrait être mise en cause en cas de litige avec un travailleur ou un syndicat, notamment s'il est estimé que le fonctionnement d'un algorithme est discriminatoire, doivent également pouvoir se protéger si elles ne disposent pas des compétences et des informations nécessaires.

|

Proposition n° 15 : prévoir systématiquement des clauses d'explicabilité et d'auditabilité des algorithmes lors de la négociation d'un contrat de prestation de service entre une entreprise et un prestataire de conception d'algorithmes. |

Dans cette perspective, la mission d'information souhaite rappeler que les entreprises peuvent également recourir à des prestataires extérieurs pour réaliser des analyses d'impact relative à la protection des données (AIPD). Il s'agit d'un outil permettant de construire des traitements automatisés de données conformes aux dispositions du règlement général sur la protection des données (RGPD). Si la réalisation d'une AIPD est obligatoire dans certains cas et doit être transmise à la Commission nationale sur l'informatique et les libertés (CNIL), il existe des exceptions, listées et adoptées par la CNIL après avis du Comité européen de protection des données (CEPD). La mission d'information considère qu'au regard du potentiel discriminatoire des algorithmes, notamment lorsqu'ils sont utilisés dans le domaine des ressources humaines et à des fins de gestion du personnel, certaines exceptions pourraient évoluer afin d'élargir le périmètre soumis obligatoirement à une AIPD.

|

Proposition n° 16 : intégrer obligatoirement à la formation des concepteurs d'algorithmes une sensibilisation aux enjeux éthiques et d'explicabilité. |

(2) La sensibilisation des concepteurs d'algorithmes aux enjeux éthiques et d'intelligibilité des algorithmiques

Il semble indispensable aujourd'hui de renforcer la formation et la sensibilisation des développeurs aux enjeux d'intelligibilité, d'explicabilité et de transparence des algorithmes, ainsi qu'aux enjeux éthiques liés au potentiel discriminatoire des algorithmes dès l'étape de leur conception .

À cet égard, les travaux de la Commission nationale sur l'informatique et les libertés (CNIL) sont particulièrement éclairants et encouragent à une meilleure formation des concepteurs d'algorithmes aux enjeux éthiques associés à leur travail : « l'organisation concrète du travail et de l'économie tend à segmenter les tâches et à favoriser la tendance que peuvent avoir les individus à ignorer les implications de leur activité au-delà de leur silo. Par conséquent, il est nécessaire que leur formation même mette les concepteurs des algorithmes en capacité de saisir ces implications parfois très indirectes sur les personnes mais aussi sur la société, qu'elle les responsabilise en éveillant leur vigilance » 246 ( * ) . Selon les résultats de la concertation citoyenne organisée par la CNIL le 14 octobre 2017, « 97% des participants considèrent que les développeurs doivent intégrer dans leurs pratiques une certaine éthique » 247 ( * ) .

Cédric Villani recommande également une adaptation de la formation des concepteurs d'algorithmes : « Pour parvenir à former des professionnels plus responsables, l'enseignement de l'éthique et plus largement des sciences sociales doit irriguer l'ensemble de la formation des ingénieurs et informaticiens. À terme, l'objectif est de produire des diplômés qui disposent des compétences techniques nécessaires pour développer des systèmes efficaces et des compétences en sciences sociales pour comprendre l'impact de leurs développements sur la société et ses citoyens » 248 ( * ) .

Considérant les algorithmes comme une chaîne de responsabilité humaine, la mission d'information se fait ici le relai des propositions qui ont été formulées précédemment sur ce sujet . En effet, les concepteurs et développeurs d'algorithmes sont les premiers maillons de cette chaîne et peuvent déjà jouer un rôle de vigilance face aux risques discriminatoires des algorithmes, ainsi que se préparer à expliquer en langage non informatique les logiques qui sous-tendent leur travail.

|

Proposition n° 17 : étendre le périmètre des organismes et des traitements automatisés de données devant obligatoirement faire l'objet d'une analyse d'impact relative à la protection des données (AIPD), notamment pour tous les traitements automatisés de données utilisés à des fins de ressources humaines. |

(3) Le développement d'une approche « ethics by design »

Le développement d'une approche « ethics by design » signifie s'intéresser à une conception responsable des algorithmes et, plus largement, du numérique . Concrètement, et au-delà de la sensibilisation des ingénieurs et informaticiens aux enjeux éthiques lors de la formation initiale, cela signifie également associer d'autres parties prenantes à la conception des algorithmes, prioritairement des représentants des travailleurs des plateformes et des salariés des entreprises dont les conditions de travail et de rémunération sont influencées par leur usage.

Plus largement, cette approche signifie également une plus grande ouverture à d'autres domaines de recherche, en particulier les sciences sociales, afin de pouvoir bénéficier d'expertises complémentaires dans la conception des algorithmes, notamment en matière d'identification des éventuels biais discriminatoires des algorithmes.

L'importance de développer une approche éthique et responsable de la conception des algorithmes est plébiscitée par la Commission nationale de l'informatique et des libertés (CNIL) : « à travers le design, c'est toute la relation entre l'homme et la machine qui peut être modifiée, dans le sens d'une responsabilisation de l'homme et d'une augmentation de sa capacité à prendre des décisions éclairées » 249 ( * ) . En effet, une telle démarche ne peut qu'être encouragée par la mission d'information qui réitère sa vision politique de l'algorithme comme étant avant tout une chaîne de responsabilité humaine .

Plus concrètement, l'Association française des managers de la diversité (AFMD) précise que « certaines entreprises se dotent d'organes consultatifs et indépendants (conseil ou comité d'éthique de la Data et de l'IA) afin de mettre en oeuvre des principes éthiques encadrant l'utilisation des technologies de data et d'intelligence artificielle » 250 ( * ) .

|

Proposition n° 18 : encourager les plateformes numériques et les entreprises à mettre en place des structures internes de concertation, associant notamment les représentants des travailleurs et des salariés, pour permettre une conception et une évolution partenariales, éthiques et responsables des algorithmes. |

2. Garantir la portabilité des données afin de renforcer l'indépendance et la mobilité des travailleurs des plateformes

a) Les travailleurs sont dépendants des plateformes pour accéder leurs données

(1) Un manque d'accès aux données des travailleurs organisé par les plateformes

Afin d'alimenter le fonctionnement de leurs algorithmes, les plateformes numériques collectent avant tout des données internes, propres à l'activité de leurs travailleurs. Seules les plateformes ont accès ces données, qu'elles utilisent et valorisent pour alimenter et améliorer leurs algorithmes afin de créer de la valeur ajoutée. Toutefois, cette valeur est inégalement partagée, les travailleurs des plateformes n'ayant pas accès aux données qu'ils génèrent en travaillant, et ne percevant pas non plus de rémunération spécifique pour l'utilisation des données qu'ils produisent.

Dans la mesure où les données collectées sont nécessaires au fonctionnement des algorithmes, les plateformes établissent une distinction claire entre les « données personnelles » et les « données d'activité », considérant que ces dernières revêtent un caractère sensible car propres à leur fonctionnement privé et protégées par les règles de la concurrence.

(2) Un manque d'accès qui renforce leur sentiment de dépendance

Au fil des auditions, la mission d'information a cependant acquis la conviction que les difficultés d'accès des travailleurs aux données générées par leur activité renforcent le caractère déterminant du management algorithmique sur leur charge et leurs conditions de travail .

En effet, dans la mesure où les travailleurs des plateformes et leurs représentants ne sont pas associés à la conception des algorithmes, où ils ne sont pas en capacité d'en comprendre les logiques de fonctionnement et où ils n'ont pas de visibilité quant aux données qu'ils produisent et à leur utilisation, le sentiment de dépendance, voire de subordination, ressenti par certains travailleurs des plateformes est amplifié.

Cette situation renforce également le sentiment de dépendance qui peut être ressenti dans la mesure où les données des travailleurs peuvent témoigner de leurs performances au travail et pourraient leur être utiles pour valoriser leur expérience auprès d'autres plateformes. Comme l'explique le think tank #Leplusimportant , « les données d'activité des travailleurs indépendants recourant aux plateformes de mise en relation par voie électronique sont essentielles à leurs employabilité et construction de leur plan de carrière. Elles conditionnent donc largement leur capacité à exercer leur activité » 251 ( * ) .

Autrement dit, un moindre accès aux données signifie également une moindre mobilité des travailleurs .

(3) Relativiser la distinction entre données personnelles et données d'activité

Au fil des auditions, la mission d'information a constaté qu'une distinction lexicale assez marquée existait en fonction des personnes auditionnées en matière d'accès aux données des travailleurs des plateformes, certains intervenants faisant référence aux « données d'activité » tandis que d'autres aux « données personnelles », ce qui pouvait parfois rendre certaines discussions confuses.

La Commission nationale de l'informatique et des libertés (CNIL) a toutefois apporté des éclaircissements utiles sur cette question, considérant que malgré une distinction qui commence à s'établir dans le langage courant, cette dernière doit être relativisée car il n'y a pas de délimitation nette entre ces deux notions : « il n'existe en effet pas de distinction entre données professionnelles et données à caractère personnel : toute donnée reliée directement ou indirectement à une personne physique est soumise au RGPD » 252 ( * ) .

Dès lors, la mission d'information invite à prendre du recul par rapport à l'emploi distinct de ces deux notions et à privilégier l'usage du terme de « données à caractère personnel ».

b) Des avancées législatives et réglementaires récentes en matière d'accès aux données

(1) L'accès des travailleurs à leurs données à caractère personnel

Premièrement, les évolutions législatives nationales récentes s'inscrivent dans la continuité des dispositions du règlement général sur la protection des données (RGPD). En effet, l'article 15 du RGPD dispose que toute personne peut obtenir du responsable du traitement de données la confirmation que ses données personnelles sont utilisées ou inutilisées. Si elles le sont, les personnes concernées peuvent demander que les informations suivantes leur soient communiquées :

- les finalités de traitement des données ;

- les catégories de données utilisées ;

- les destinataires des données utilisées ;

- la durée de conservation des données et les critères utilisés pour déterminer cette durée ;

- l'existence du droit de demander au responsable du traitement la rectification ou l'effacement des données à caractère personnel ;

- le droit d'introduire une réclamation auprès d'une autorité de contrôle ;

- l'existence d'une prise de décision automatisée et les conséquences prévues de ce traitement pour la personne concernée.

Dans la continuité de ces dispositions, l'article 47 de loi d'orientation des mobilités du 24 décembre 2019 créé l'article L.7342-7 du Code du travail qui dispose que : « Les travailleurs mentionnés à l'article L. 7341-1 bénéficient du droit d'accès à l'ensemble des données concernant leurs activités propres au sein de la plateforme et permettant de les identifier. Ils ont le droit de recevoir ces données dans un format structuré et celui de les transmettre. Le périmètre précis de ces données ainsi que leurs modalités d'accès, d'extraction et de transmission sont définies par décret ».

Si la rédaction de la loi mentionne les données relatives aux « activités propres » des travailleurs des plateformes, il est bien ici question de leurs données à caractère personnel, comme le précise le décret d'application du 16 juillet 2021.

(2) La transmission des données à caractère personnel des travailleurs par les plateformes

Conformément aux dispositions de l'article 47 de la loi d'orientation des mobilités du 24 décembre 2019, le décret du 16 juillet 2021 relatif aux données personnelles permettant la valorisation de l'activité professionnelle des travailleurs des plateformes de mise en relation par voie électronique élucide premièrement l'ambiguïté des termes de la loi.

En effet, il est d'emblée précisé que : « les données mentionnées à l'article L. 7342-7 sont les données à caractère personnel au sens de l'article 4 du règlement (UE) 2016/679 du 27 avril 2016 du Parlement européen et du Conseil relatif à la protection des personnes physiques à l'égard du traitement des données à caractère personnel et à la libre circulation de ces données » 253 ( * ) .

Par ailleurs, ce décret précise les données à caractère personnel qui sont concernées :

- les données relatives à l'immatriculation ou à l'inscription du travailleur en tant que travailleur indépendant ;

- la date d'entrée en relation contractuelle avec la plateforme ;

- les données relatives aux prestations effectuées par le travailleur par l'intermédiaire de la plateforme : leur nature, le nombre total de prestations effectuées, ainsi que, dans un format consolidé lorsque la nature des prestations le justifie, leur durée totale, exprimée en heures, les plages horaires moyennes des prestations, leur secteur géographique et leur distance moyenne ;

- le montant des revenus d'activité versés par la plateforme en contrepartie des prestations effectuées, déduction faite des frais de commission ;

- lorsque ces données existent, les évaluations des prestations effectuées au cours des douze derniers mois ;

- le cas échéant, les données personnelles que détient la plateforme de mise en relation par voie électronique et qui sont attachées à l'exercice de la responsabilité sociale qui lui incombe :

o le montant de la contribution à la formation professionnelle pris en charge par la plateforme au cours de la dernière année civile écoulée et le montant cumulé des contributions prises en charge par la plateforme les années précédant celle-ci ;

o l'intitulé des actions permettant de faire valider les acquis de l'expérience auxquelles le travailleur a participé au cours de la dernière année civile écoulée et l'intitulé des formations suivies les années précédant celle-ci ;

o le montant de l'abondement au compte personnel de formation.

Enfin, ce décret vise également à favoriser la mobilité des travailleurs des plateformes qui ont le droit de demander et de recevoir, dans un délai d'un mois après avoir formulé leur demande, les données mentionnées ci-dessous, mais également de les transférer à des tiers.

(3) Se saisir pleinement des nouveaux droits et outils à leur disposition

Si la mission d'information salue les évolutions législatives et règlementaires récentes mentionnées ci-dessus en matière de droit d'accès aux données pour les travailleurs des plateformes, elle appelle également à une certaine vigilance. En effet, pour que le droit d'accès aux données des travailleurs soit pleinement effectif, il faut premièrement et avant tout que les travailleurs des plateformes et leurs représentants se saisissent de ce droit, ce qui suppose qu'ils disposent d'une information adéquate concernant les évolutions législatives et règlementaires récentes en la matière.

Par ailleurs, l'exercice de ce droit n'est pas neutre pour les plateformes numériques qui devront, dans un délai de trois mois à compter de la publication du décret du 16 juillet 2021, soit à compter du 16 octobre 2021, avoir mis en place des processus d'organisation internes effectifs permettant de répondre aux demandes de leurs travailleurs dans un délai d'un mois.

Or, les auditions menées par la mission d'information laissent penser au rapporteur que les plateformes numériques ne se sont pas suffisamment préparées à l'entrée en vigueur de ce décret. En effet, peu de plateformes ont accepté de communiquer sur les processus internes déjà mis en oeuvre pour favoriser l'accès de leurs travailleurs à leurs données.

À cet égard, la plateforme Deliveroo a par exemple indiqué que « les livreurs partenaires qui travaillent avec Deliveroo peuvent exercer leur droit d'accès en vertu de l'article 15 du règlement RGPD en contactant notre équipe d'assistance aux livreurs partenaires via une adresse électronique dédiée ou en contactant notre délégué à la protection des données à une adresse électronique spécifique. Nous fournissons aux livreurs partenaires des informations sur leurs droits en application du règlement RGPD, et sur la manière de les exercer, dans notre politique de confidentialité en ligne » 254 ( * ) .

Si de telles initiatives doivent être encouragées au sein de l'ensemble des plateformes numériques concernées, la mission d'information s'interroge toutefois sur la capacité des plateformes à traiter, dans les délais réglementaires prévus, les demandes formulées par les travailleurs. Or, il est essentiel que ce droit d'accès aux données soit pleinement effectif, car il permet des actions concrètes permettant aux travailleurs des plateformes et à leurs représentants de commencer à se réapproprier une partie de leur travail et de devenir véritablement les maillons d'une chaine humaine que le management algorithmique tend à effacer .

* 229 Article L.300-2 du CRPA.

* 230 Contribution écrite transmise au groupe d'études sur l'économie sociale et solidaire du Sénat à la suite de la de la table-ronde sur le thème des plateformes numériques coopératives du 26 mai 2021.

* 231 David Bounie, Winston Maxwell, « L'explicabilité des algorithmes est-elle un droit fondamental », Le Monde, 1 er septembre 2019.

* 232 Cédric Villani, Donner un sens à l'intelligence artificielle, 2018.

* 233 Contribution écrite à la suite de l'audition du 13 juillet 2021.

* 234 Notre système de proposition de commandes en toute transparence | Uber Blog

* 235 Comprendre les raisons pouvant mener à une désactivation du compte | Uber Blog

* 236 Contribution écrite à la suite de l'audition du 13 juillet 2021.

* 237 Contribution écrite à la suite de l'audition du 22 juillet 2021.

* 238 Sous la direction de Patrick Adam, Intelligence artificielle, gestion algorithmique du personnel et droit du travail, « Le comité social et économique face à l'intelligence artificielle ».

* 239 Contribution écrite de #Leplusimportant à la suite de l'audition du 9 juillet 2021.

* 240 Contribution écrite d'indépendants.co à la suite de l'audition du 27 juillet 2021.

* 241 Valerio De Stefano et Simon Taes, « Management algorithmique et négociation collective », Notes de prospective de l'ETUI, Mai 2021.

* 242 Ibid.

* 243 Cécile Thibaud, « Loi Riders » : les livreurs espagnols de Deliveroo et Uber Eats seront salariés, 12 mars 2021.

* 244 Contribution écrite de #Leplusimportant à la suite de l'audition du 9 juillet 2021.

* 245 Ibid.

* 246 CNIL, Comment permettre à l'homme de garder la main ? Les enjeux éthiques des algorithmes et de l'intelligence artificielle, Synthèse du débat public animé par la CNIL dans le cadre de la mission de réflexion éthique confiée par la loi pour une République numérique, Décembre 2017.

* 247 Ibid.

* 248 Cédric Villani, Donner un sens à l'intelligence artificielle, 2018.

* 249 CNIL, Comment permettre à l'homme de garder la main ? Les enjeux éthiques des algorithmes et de l'intelligence artificielle, Synthèse du débat public animé par la CNIL dans le cadre de la mission de réflexion éthique confiée par la loi pour une République numérique, Décembre 2017.

* 250 Contribution écrite à la suite de l'audition du 20 juillet 2021.

* 251 Contribution écrite de #Leplusimportant à la suite de l'audition du 9 juillet 2021.

* 252 Contribution écrite de la CNIL à la suite de l'audition du 7 septembre 2021.

* 253 Article 1 du décret du 16 juillet 2021 relatif aux données personnelles permettant la valorisation de l'activité professionnelle des travailleurs des plateformes de mise en relation par voie électronique.

* 254 Contribution écrite de Deliveroo à la suite de son audition le 13 juillet 2021.