B. UNE PERSISTANCE DES CONTENUS HAINEUX QUI S'IMMISCE DANS LES FAILLES DU DROIT EN VIGUEUR ET DE SON APPLICATION PERFECTIBLE

1. Malgré les progrès réalisés par les plateformes, la persistance des contenus haineux en ligne

a) Un phénomène difficile à mesurer, mais persistant...

Le rapport de la « mission Facebook » le rappelait fort justement : les réseaux sociaux sont « une formidable avancée pour la liberté d'expression » 23 ( * ) . Mais, comme le soulignait aussi le rapport visant à renforcer la lutte contre le racisme et l'antisémitisme sur internet 24 ( * ) , on ne peut nier « la banalisation du racisme et de l'antisémitisme sur internet ».

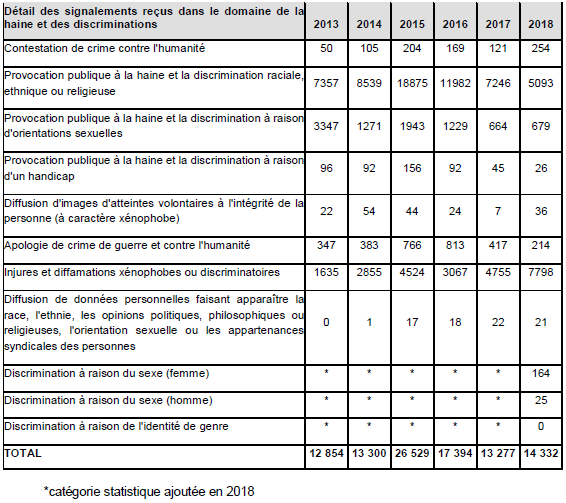

Il n'existe pas de statistiques officielles et exhaustives quantifiant l'ampleur du phénomène. En revanche, certains indices peuvent être utilisés, comme les signalements à la plateforme Pharos . En 2018, celle-ci dénombrait 163 723 signalements , dont 14 000 relevaient de la haine en ligne ou de discriminations 25 ( * ) . La majorité des signalements concerne des contenus présents sur les réseaux sociaux américains. Comme le montre le tableau suivant, plus de la moitié relevaient des injures ou diffamations xénophobes ou discriminatoires et plus du tiers de la provocation publique à la haine et la discrimination raciale, ethnique ou religieuse :

Source : ministère de

l'Intérieur,

contribution au rapport 2018 de la CNCDH sur la lutte

contre le racisme, janvier 2019

Malgré ces données lacunaires, il est indéniable qu'une réponse au sentiment d'impunité des discours de haine en ligne doit être apportée, et que « l'indifférence » des pouvoirs publics dénoncée par le rapport visant à renforcer la lutte contre le racisme et l'antisémitisme sur internet doit cesser .

b) ... malgré d'importants progrès réalisés par les plateformes

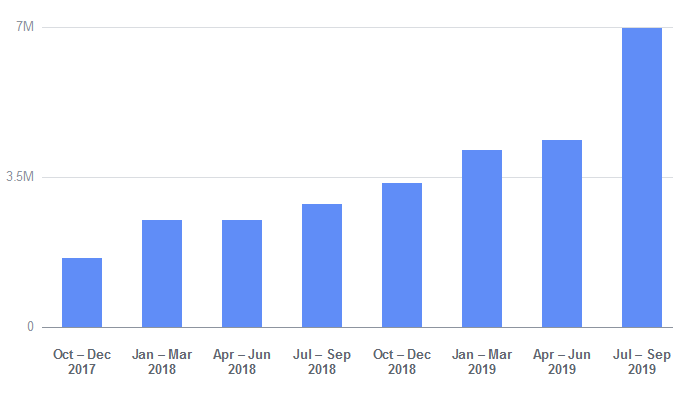

Les plateformes ont réalisé des progrès, comme cela a pu être souligné par le rapport de la « mission Facebook ». La plus grande attention donnée par les grandes plateformes à ce sujet se traduit d'abord par une hausse du nombre de contenus traités , comme le montrent, ci-dessous, les données publiées par Facebook dans son rapport de transparence sur les pratiques de l'entreprise en la matière 26 ( * ) .

Nombre de contenus considérés comme des

« discours haineux »

traités par Facebook dans le

monde

(en millions)

Source : Facebook, rapport de transparence

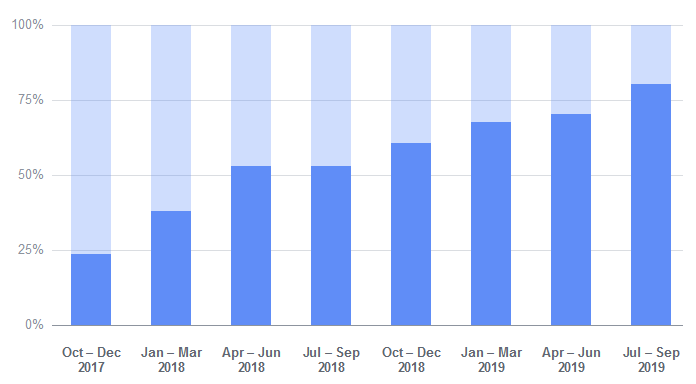

La très grande majorité des contenus traités aujourd'hui par l'entreprise le seraient d'ailleurs avant toute notification des utilisateurs , comme le montre le graphique ci-dessous.

Répartition des contenus traités avant ou après notification par les utilisateurs (en % du total des contenus traités)

Source : Facebook, rapport de

transparence.

Nb : la partie sombre représente les contenus

traités de façon proactive, c'est-à-dire avant

notification, et la partie claire représente les contenus traités

après notification.

Dans le cadre de la mise en oeuvre du code de conduite au niveau européen, on constate effectivement une hausse du taux de notifications examinées en 24 heures pour l'ensemble des entreprises concernées , à près de 89 %. 72 % des contenus considérés comme des discours de haine illégaux seraient supprimés (contre 28 % lors de la première évaluation du dispositif). Cependant il existe de grandes disparités : quand Facebook retire 82,4 % des contenus notifiés et Youtube 85,4 %, Twitter ne retire que 43,5 %.

Les acteurs se sont dotés d'importants moyens humains . Facebook aurait recours aux services de 15 000 modérateurs de contenus dans le monde, avec l'aide de partenaires comme Accenture, Genpact, CCC et Majorel, répartis sur plus d'une vingtaine de sites dans le monde, notamment en Allemagne, en Irlande, en Lettonie, aux Philippines, en Espagne ou aux États-Unis.

Ils appliquent davantage de mesures de transparence, à travers les rapports réguliers, la publication des « standards de la communauté »... Facebook envisage même la création d'une instance d'appel indépendante pour gérer les cas les plus délicats.

Par ailleurs, les données publiées par Facebook font état d'un taux d'erreur relativement faible : sur les 7 millions de contenus haineux traités par l'entreprise entre juillet et septembre 2019, 1,4 million ont fait l'objet d'un recours, soit 20 %, mais seuls 169 700 ont été republiés suite au recours, soit 2,4 % des contenus traités mais 12 % des contenus ayant fait l'objet d'un appel. Enfin, 2 200 contenus ont été rétablis sans qu'un recours n'ait été effectué. Le taux d'erreur global est donc de 2,4 % sur cette période.

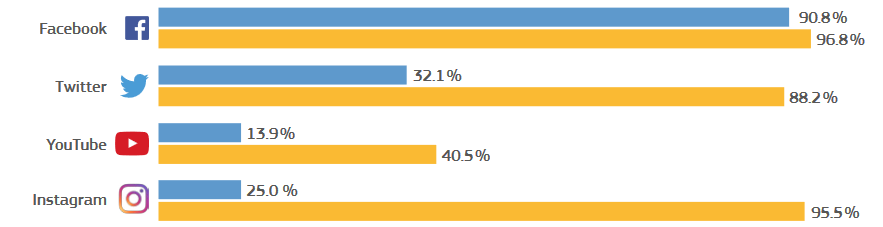

Enfin, il semble que la marge de progression la plus importante se trouve dans les mesures relatives à la transparence quant aux suites données aux notifications , comme le montre le graphique ci-dessous.

Information des utilisateurs suite à une notification

Source : Commission européenne, quatrième

évaluation du code de conduite

contre les discours de haine

illégaux en ligne, février 2019.

En sombre figurent les

réponses aux utilisateurs, en plus clair celles des tiers de

confiance.

La rapporteure de la commission des lois de l'Assemblée nationale souligne également le degré de coopération hétérogène des différentes plateformes avec les autorités publiques : si Youtube et Facebook retireraient près de 80 % des contenus haineux signalés dans les 24 heures par la plateforme Pharos, ce ne serait le cas que de 50 % des contenus signalés à Twitter.

2. Un droit en vigueur régulièrement contesté et insuffisamment appliqué.

On ne peut ignorer l'une des grandes limites de la directive « e-commerce » : elle était censée permettre l'émergence d'entreprises européennes du numérique ; mais elle ne fait aujourd'hui que protéger les grandes entreprises non européennes.

Deux dispositions font aujourd'hui l'objet d'une remise en cause : le principe du pays d'origine et le principe de la responsabilité limitée.

La remise en cause de la responsabilité limitée des hébergeurs est envisagée dans de nombreux domaines. Par exemple, au regard de la protection des consommateurs, la persistance de produits frauduleux sur les places de marché en ligne pourrait plaider pour un renforcement de leur responsabilité. C'est une piste sur laquelle travaille la direction générale de la concurrence, de la consommation et de la répression des fraudes.

S'agissant de la haine en ligne, le droit en vigueur est considéré comme inadapté à l'enjeu, selon des arguments bien résumés par le rapport de la députée Laëtitia Avia pour la commission des lois de l'Assemblée nationale :

- certains acteurs de l'internet ont un rôle actif, « d'accélération des contenus » 27 ( * ) , qui les distinguent de simples intermédiaires techniques et qui nécessitent d'aller au-delà de la responsabilité limitée ;

- l'absence de régulateur pour garantir l'application de la LCEN ;

- les procédures de signalement sont insuffisamment harmonisées, trop complexes pour les utilisateurs et la transparence des procédures en cas de retrait est insuffisante ;

- le montant maximal de la sanction (375 000 euros d'amende pour une personne morale) est jugé inadapté à la réalité du secteur (en 2018, le chiffre d'affaires de Facebook atteignait 55,8 milliards de dollars) ;

- des difficultés structurelles entravent le travail des enquêteurs et de l'autorité judiciaire (« défaut d'identification des titulaires de comptes à l'origine de la publication de contenus illicites (hébergements à l'étranger, réquisitions infructueuses, anonymat sur internet...), caractère massif du contentieux, absence d'obligation pour ces opérateurs de disposer d'une représentation légale en France »)... Ce dernier point est soulevé à plusieurs reprises par la circulaire du 4 avril dernier, qui incite à agir auprès des FAI plutôt qu'auprès des hébergeurs, souvent difficiles à identifier et à localiser. De plus, la mise en cause de la responsabilité pénale des hébergeurs est délicate car cela nécessite de prouver la complicité 28 ( * ) de l'hébergeur dans la commission du délit sous-jacent, et l'élément intentionnel de l'infraction. De fait, comme le souligne la rapporteure de la commission des lois de l'Assemblée nationale, on ne trouve aucun cas d'engagement de responsabilité pénale d'un hébergeur à raison des contenus stockés.

Par ailleurs, le blocage des sites internet s'est toujours heurté à une certaine inefficacité technique, contre laquelle il apparaît difficile de lutter à l'aide d'une loi : il est très facile de copier-coller un site en en changeant le nom de domaine. C'est le phénomène des « sites miroirs ».

Plusieurs personnes auditionnées ont néanmoins souligné que le droit en vigueur permet déjà de poursuivre les auteurs et les hébergeurs de propos haineux illicites. Ce qui ferait défaut serait donc, d'une part, la volonté politique au plus haut niveau de l'État - ce qui semble avoir changé, comme le démontre notamment la circulaire du 4 avril 2019 précitée -, d'autre part, les moyens mis à disposition de la justice sur ce sujet.

S'agissant de l'action au niveau européen, comme le remarquait le rapport visant à renforcer la lutte contre le racisme et l'antisémitisme sur internet, « la lutte contre la haine en ligne repose (...) actuellement (...) sur le volontarisme des plateformes, leur principale motivation affichée étant de protéger leur réputation ». Le rapport de la « mission Facebook » relevait « l'insuffisance et le manque de crédibilité des démarches d'autorégulation développées par les plus grandes plateformes », qui se traduisent notamment par une asymétrie extrême d'information entre les pouvoirs publics et les plateformes, un caractère trop « autocentré » de cette autorégulation. Il considérait que « l'insuffisance constatée (des) mécanismes de modération et le manque de transparence du fonctionnement de leur plateforme justifient une intervention des pouvoirs publics, nonobstant les efforts consentis par certains acteurs ».

* 23 Mission « Régulation des réseaux sociaux - Expérimentation Facebook », Créer un cadre français de responsabilisation des réseaux sociaux : agir en France avec une ambition européenne, mai 2019.

* 24 Karim Amellal, Laëtitia Avia, Gil Taïeb, Renforcer la lutte contre le racisme et l'antisémitisme sur Internet , 20 septembre 2018.

* 25 Contre 4 500 pour terrorisme et 20 000 pour atteinte aux mineurs. La grande majorité des signalements (90 000) relevait de l'escroquerie et de l'extorsion.

* 26 https://transparency.facebook.com/community-standards-enforcement#hate-speech . Il s'agit des contenus considérés comme haineux en application des « standards de la communauté » définis par l'entreprise.

* 27 Les moteurs de recherche et les réseaux sociaux ont une fonction de hiérarchisation algorithmique des contenus hébergés, ayant pour effet d'accélérer ou de ralentir la diffusion des contenus. C'est pourquoi il est parfois envisagé d'introduire, au sein de la directive « e-commerce », un « troisième statut », qui responsabiliserait davantage les intermédiaires techniques. Il en va notamment ainsi de la résolution européenne adoptée par le Sénat à l'initiative de Catherine Morin-Desailly le 30 novembre 2018 sur la responsabilisation partielle des hébergeurs de contenus numériques, où l'on peut lire que « le régime de responsabilité allégé des hébergeurs, tel qu'il résulte de ladite directive, n'est aujourd'hui plus adapté à ces nouveaux défis » et appelle à « une évolution du cadre légal pour créer un statut intermédiaire entre celui d'hébergeur et celui d'éditeur, spécifiquement dans le cas d'une hiérarchisation par un algorithme des informations présentées à l'utilisateur du service ». C'était également une recommandation du rapport d'information de MM. Laurent Béteille et Richard Yung, fait au nom de la commission des lois du Sénat et intitulé « Lutte contre la contrefaçon : premier bilan de la loi du 29 octobre 2007 » , publié en février 2011.

* 28 Qualifiée de « complicité d'un genre nouveau » par un auteur (E. Dreyer, Responsabilités civile et pénale des médias).