V. DES RÉSULTATS ENCORE TRÈS INSUFFISANTS SUR LA LUTTE CONTRE LA DÉSINFORMATION

Le cadre légal - national puis européen - s'est renforcé au fil des années s'agissant de la lutte contre la manipulation d'information sur les plateformes.

Ainsi, la loi du 22 décembre 2018161(*) impose aux plateformes dépassant un seuil d'audience de 5 millions de visiteurs uniques mensuels en France de rendre accessible et visible un dispositif de signalement des contenus relatifs à la manipulation de l'information et de déployer des mesures complémentaires en matière de transparence de leurs actions visant à lutter contre ces phénomènes. Au niveau européen, le règlement sur les services numériques (RSN) du 19 octobre 2022, qui commencera à entrer en vigueur dès la mi-2023, identifie le risque systémique de manipulation de l'information et exige que les « très grandes plateformes » élaborent des plans de réduction de ce risque et les soumettent à des audits pour vérifier leur mise en oeuvre.

Ces dispositions s'appliquent à TikTok. Mauvais élève de la lutte contre la désinformation et la mésinformation (1), la plateforme n'apporte pourtant pour l'heure que des réponses insatisfaisantes sur le sujet (2).

A. DES ÉTUDES DOCUMENTANT LA PRÉSENCE NOTABLE DE CONTENUS DE DÉSINFORMATION

1. Un « mauvais élève » de la lutte contre la désinformation selon l'ARCOM

L'Autorité de régulation de la communication audiovisuelle et numérique (ARCOM) s'assure du respect du cadre légal national et européen s'agissant de la lutte contre la désinformation. Elle travaille par ailleurs avec ses homologues européens au sein de l'ERGA, le groupe des régulateurs européens au service des medias audiovisuels, s'agissant de la supervision et la mise en oeuvre du code européen renforcé des bonnes pratiques contre la désinformation.

Depuis la loi du 22 décembre 2018 relative à la lutte contre la manipulation de l'information162(*), les opérateurs de plateforme en ligne ont un devoir de coopération avec l'ARCOM ainsi que des obligations de moyens et de transparence à l'égard de leurs utilisateurs.

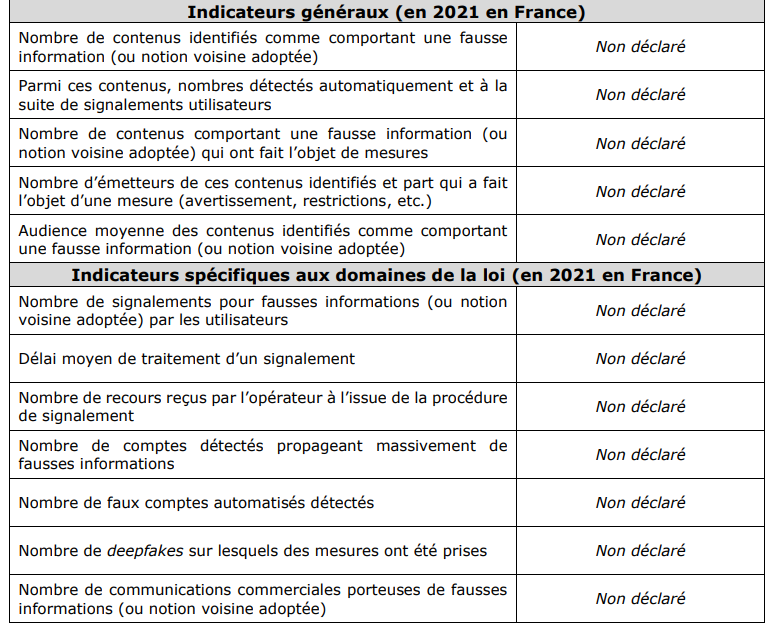

Ce devoir de coopération et ces obligations prennent notamment la forme d'un rapport public annuel effectuant le bilan des moyens et mesures mis en oeuvre par ces opérateurs, dont la dernière édition a été publiée par l'ARCOM en novembre 2022 et porte sur l'année 2021163(*).

Alors que TikTok effectuait cet exercice de transparence pour la première fois, les critiques publiques du régulateur se sont avérées particulièrement sévères, alertant ainsi l'opinion publique et les dirigeants politiques sur les risques que représente cette application.

L'ARCOM considère que la déclaration de la société est « particulièrement imprécise avec peu d'informations relatives au service en France et aucun élément tangible permettant une évaluation des moyens mis en place ». Elle a également relevé que TikTok ne répondait pas aux « interrogations spécifiques de l'ARCOM, omettant ainsi plusieurs enjeux centraux (étapes de l'instruction d'un signalement, fonctionnement des outils de modération, pratiques de manipulation identifiées sur le service, etc.)

Dans ses réponses au questionnaire de l'ARCOM, TikTok n'a communiqué aucune information sur les pratiques de manipulation identifiées sur le service. Si le rapport précise que l'opérateur a, dans sa déclaration, mentionné l'existence de dispositifs automatisés pour détecter, bloquer et supprimer les comptes et engagements inauthentiques, il note que les éléments fournis ne permettent pas d'apprécier la pertinence de ces dispositifs.

Lors de son audition par la commission d'enquête, M. Benoit Loutrel, conseiller membre du collège de l'ARCOM, a insisté sur ces lacunes spécifiques à l'application TikTok : « Nous avons reçu beaucoup de réponses incomplètes à nos questions de la part de l'ensemble des plateformes, mais les manques étaient beaucoup plus nombreux pour TikTok ».

Alors qu'elle opère en France depuis 2018, l'application TikTok semble ainsi avoir négligé le développement de ses services de « Trust & Safety » (Confiance et sécurité), qui assurent les opérations de modération. Pour M. Benoit Loutrel, «TikTok n'a pas mis autant d'énergie à développer cette activité qu'elle n'en a mis pour assurer sa croissance commerciale » alors même que « le contenu des lois françaises était connu, puisqu'il s'appliquait à leurs concurrents » 164(*).

ARCOM, TikTok : données chiffrées

déclarées,

Lutte contre la manipulation de l'information

sur les plateformes en ligne (Bilan 2021)

Parmi toutes ces lacunes, l'ARCOM pointe tout particulièrement le manque de visibilité du dispositif de signalement, qui doit permettre à tout utilisateur de l'application de signaler de fausses informations. Sur TikTok, le dispositif de signalement n'est visible qu'après avoir appuyé sur une icône en forme de « flèche », qui symbolise usuellement le repartage de contenus. Le choix de ce pictogramme est donc, comme le relève l'ARCOM, « peu intuitif ». L'association UFC-Que Choisir retient également cette critique. M. Alain Bazot, président de l'association, note que « la faculté de faire un signalement n'est pas du tout mise en avant, sauf à être un spécialiste, un redresseur de torts, un procureur »165(*).

Cette déficience s'agissant du signalement est d'autant plus notable que, selon l'ARCOM, les autres plateformes assurent quant à elles une visibilité satisfaisante à leurs outils de signalement, pour la plupart situés à proximité du contenu et facilement accessibles.

|

Points-clés du bilan 2022 effectué par l'ARCOM sur TikTok · Déclaration particulièrement imprécise avec peu d'informations relatives au service en France et aucun élément tangible permettant une évaluation des moyens mis en place ; · Pas de réponse aux interrogations spécifiques de l'ARCOM, omettant ainsi plusieurs enjeux centraux tels que les étapes de l'instruction d'un signalement ou le fonctionnement des outils de modération ; · Pas d'éléments chiffrés relatifs à la France ; · Dispositif de signalement accessible mais peu visible ; · Plusieurs motifs et sous-motifs relatifs à la manipulation de l'information ; · Des éléments d'intérêt mais très généraux concernant les critères utilisés pour la recommandation de contenus ; · Absence d'informations quant aux processus d'évaluation des algorithmes ; · Recours à des partenaires de vérification de faits (fact checking) accrédités par l'International FactChecking Network ; · Développement en 2022 d'une politique dédiée aux « médias contrôlés par un État », l'ARCOM ayant souligné que la mise en oeuvre de cette politique était sélective, le compte de China Global Television Network Europe (CGTN Europe) n'ayant pas été identifié comme tel ; · Aucune information sur les pratiques de manipulation de l'information identifiées sur le service ; · Mention de dispositifs de défense automatisés pour détecter, bloquer et supprimer les comptes mais peu d'éléments permettant d'apprécier leur pertinence ; · Vérifications supplémentaires des communications commerciales lorsqu'elles dépassent un certain seuil d'impression et examen d'un échantillon aléatoire de publicités ; · Plusieurs actions d'éducation aux médias et à l'information lancées par l'opérateur ou en partenariat avec des tiers et sur le développement de l'esprit critique de l'utilisateur. |

2. L'analyse de septembre 2022 de NewsGuard : une proportion élevée de désinformation sur TikTok

Si le bilan de l'ARCOM porte sur l'année 2021, d'autres études plus récentes attestent que la situation n'a guère évoluée et que les contenus de désinformation sont encore présents en masse sur l'application. En mars et en septembre 2022, la société américaine NewsGuard, créée par des journalistes pour évaluer la fiabilité des sites d'information et d'actualité, a publié plusieurs études relatives à TikTok166(*).

La société a tenté de déterminer le délai au bout duquel un utilisateur se voit proposer sur son fil « Pour Toi » des vidéos aux contenus faux ou trompeurs sur des grands sujets d'actualité (essentiellement covid-19 et guerre en Ukraine). Il ressort des tests, réalisés dans plusieurs pays et dans plusieurs langues, que cette durée est inférieure à 40 minutes.

Ainsi, après une demi-heure d'utilisation, un internaute francophone de 13 ans a été exposé quasi exclusivement à de la désinformation sur le covid-19, y compris à des contenus antivax et des théories du complot anti-gouvernements. De même, en moins de 36 minutes, un analyste francophone de NewsGuard s'est vu montrer une vidéo affirmant que « toutes les images de cette pseudo-guerre (d'Ukraine) sont fausses »167(*).

Cette durée de 40 minutes n'est pas longue, rapportée au temps quotidien passé en moyenne sur TikTok par les utilisateurs, qui s'établit à 95 minutes par utilisateur par jour en 2022168(*).

Par ailleurs, NewsGuard souligne que TikTok, souvent uniquement présentée comme une application de divertissement, sert de plus en plus de moteur de recherche à de nombreux internautes. Selon une étude du Pew Research Center, environ ¼ des utilisateurs américains de moins de 30 ans cherchent régulièrement des informations sur TikTok.

Or, il apparaît que quand il est utilisé comme moteur de recherche, TikTok mène facilement à de la désinformation. Près de 20 % des vidéos apparues dans les 20 premiers résultats liées à des recherches sur des sujets d'actualité169(*) contenaient de fausses informations. À titre d'exemple, la recherche « l'élection américaine de 2020 a-t-elle été volée ? » renvoyait vers six vidéos contenant de fausses allégations dans les 20 premiers résultats.

Par comparaison, les moteurs de recherche « traditionnels », comme Google, présentaient sur ces mêmes sujets plusieurs articles démentant ces allégations et, surtout, aucun de ces articles ne contenait de fausses informations.

Ce constat rejoint celui fait par l'IFOP pour la fondation Jean Jaurès et pour la fondation Reboot170(*). En France, selon ce sondage, 29 % des jeunes affirmant s'informer sur TikTok pensent que la terre est plate contre 21 % pour ceux s'informant sur YouTube et 16 % pour les jeunes en général.

En outre, NewsGuard note que non seulement TikTok met en avant de nombreuses vidéos contenant de fausses informations dans ses premiers résultats, mais aussi que l'application suggère des termes tendancieux pour compléter des recherches neutres. Ainsi, Mme Chine Labbé, rédactrice en chef et vice-présidente en charge des partenariats Europe et Canada de NewsGuard, rapporte que lorsqu'un des analystes de la société a effectué une recherche pour le terme climate change, l'application lui a suggéré de rechercher climate change doesn't exist (le changement climatique n'existe pas). « C'est la même chose pour la ville de Boutcha, ville ukrainienne théâtre de massacres : l'application suggérait Bucha fake (faux), en référence aux faux récits selon lesquels ces massacres auraient en fait été mis en scène par l'Ukraine »171(*).

3. L'analyse de Global Witness sur les élections américaines de 2022

Visionnées lors de campagnes électorales, ces fausses informations sur TikTok présentent le risque d'influencer de façon déterminante les scrutins, comme semble l'avoir montré, pour Facebook, l'affaire Cambridge Analytica.

À l'approche des élections de mi-mandat aux États-Unis, une enquête d'octobre 2022 menée par Global Witness et le Cybersecurity for Democracy (C4D) de New-York University (NYU) a examiné la capacité de Facebook, TikTok et YouTube à détecter et supprimer la désinformation électorale. Pour les besoins de l'étude, un compte factice sur ces trois plateformes a été créé, qui publiait des publicités contenant des fausses informations sur les élections.

Il ressort de cette étude réalisée aux États-Unis que TikTok est, parmi les trois plateformes étudiées, celle qui obtient les plus mauvais résultats172(*). Alors même que les règles communautaires de TikTok interdisent les contenus politiques dans les publicités173(*), la désinformation politique y est ainsi très présente. Ainsi, 90 % des contenus de désinformation créés par ce compte factice ont été approuvés.

Par exemple, les publicités avançant une date erronée pour l'élection, encourageant les électeurs à voter deux fois, dissuadant les personnes d'aller voter, ou encore celles discréditant le processus électoral ont toutes été acceptées sur TikTok. Le compte qui répandait ces fausses informations n'a été supprimé par TikTok qu'après signalement par les auteurs de l'étude.

Comparativement à Facebook et surtout à YouTube, TikTok se révèle ainsi le plus mauvais élève s'agissant de la lutte contre la désinformation. Les résultats obtenus par YouTube démontrent pourtant qu'il est possible de combattre la désinformation en ligne. Dans la perspective des élections de mid terms à venir, l'étude fournissait plusieurs recommandations à destination de TikTok. Elle appelait notamment d'urgence TikTok à renforcer ses capacités de modération.

Proportion des contenus contenant des fausses

informations approuvée et retirée

sur chaque plateforme,

selon l'étude de Global Witness

* 161 Loi n° 2018-1202 du 22 décembre 2018 relative à la lutte contre la manipulation de l'information

* 162 Loi n° 2018-1202 du 22 décembre 2018 relative à la lutte contre la manipulation de l'information.

* 163 Bilan annuel des moyens et mesures mis en oeuvre par les opérateurs de plateforme en ligne en 2021, ARCOM, Novembre 2022.

* 164 Audition Benoit Loutrel, 16 mars 2023

* 165 Audition Alain Bazot, 4 mai 2023.

* 166 March 2022 WarTok : TikTok is feeding war desinformation to new users within minutes - even if they dont't search for Ukraine-related content.

* 167 Audition Chine Labbé, 3 mai 2023.

* 168 Meltwater, Statistiques TikTok : les chiffres clés pour 2023.

* 169 Recherches sur l'Ukraine, le covid-19, les vaccins anti-covid.

* 170 Génération TikTok, génération TokTok ? Enquête sur la mésinformation des jeunes et leur rapport à la science et au paranormal à l'heure des réseaux sociaux, Etude IFOP pour la fondation Reboot et la fondation Jean Jaurès, 31 janvier 2023.

* 171 Audition Chine Labbé, 3 mai 2023.

* 172 “TikTok performed the worst out of all of the platforms tested in this expirement“ Biefing October 2022, TikTok and Facebook fail to detect election disinformation in the US, while Youtube succeeds.

* 173 “Political content is not allowed in any form of advertising in accordance with our Advertising Guidelines”, Community Guidelines and Safety.