TITRE VIII

ADAPTATIONS DU DROIT NATIONAL

CHAPITRE IER

Mesures d'adaptation de la loi n°

2004-575 du 21 juin 2004 pour la confiance dans l'économie

numérique

Article 22

Adaptations de la loi pour la confiance dans

l'économie numérique

L'article 22 du projet de loi vise à adapter la loi du 21 juin 2004 pour la confiance dans l'économie numérique afin de tirer les conséquences de l'application du règlement européen sur les services numériques.

La commission a adopté cet article modifié par l'adoption de deux amendements des rapporteurs, de nature rédactionnelle ou de coordination juridique.

1. Le droit en vigueur : une nécessaire mise à jour de la loi du 21 juin 2004 pour la confiance dans l'économie numérique

La loi française du 21 juin 2004 pour la confiance dans l'économie numérique (LCEN) a été adoptée afin de transposer les dispositions de la directive 2000/31 sur le commerce électronique, dite directive e-commerce, à une période où le développement de l'économie numérique n'était pas aussi abouti qu'aujourd'hui.

Cette législation pose les grands principes applicables à la régulation de l'économie numérique, qui demeurent encore valables aujourd'hui. En particulier, le principe de la responsabilité des hébergeurs de services de communication au public en ligne, l'absence de surveillance générale des données et le principe dit « du pays d'origine » selon lequel les prestataires de services de la société de l'information doivent se conformer à la législation de leur pays d'établissement.

Or, depuis cette directive, au regard des évolutions du marché, des innovations technologiques et des priorités politiques des Gouvernements successifs, la LCEN a été modifiée à de nombreuses reprises, sans pour autant permettre de s'adapter au mieux aux nouvelles pratiques et aux nouveaux risques inhérents au développement d'une société et d'une économie de plus en plus numériques.

La directive e-commerce ayant atteint ses limites, et face aux risques de fragmentation durable des législations nationales des États membres au sein de l'Union européenne, de nouveaux règlements européens ont été adoptés, en particulier le règlement sur les services numériques (RSN) ou Digital Services Act (DSA) et le règlement sur les marchés numériques (RMN) ou Digital Markets Act (DMA).

Ces deux règlements européens sont des règlements horizontaux d'harmonisation maximale, c'est-à-dire que les États membres ne devraient pas adopter ou maintenir des exigences nationales supplémentaires dans les domaines relevant du champ d'application de ces deux règlements, sauf si cela est expressément prévu.

L'article 22 du projet de loi vise à modifier plusieurs dispositions de la LCEN afin de tirer les conséquences de l'application du RSN, prévue au 17 février 2024. Toutefois, pour les très grandes plateformes en ligne et les très grands moteurs de recherche en ligne, les dispositions du RSN s'appliqueront à compter du 25 août 2023, la Commission européenne ayant récemment publié la liste des entreprises concernées : AliExpress, Amazon Store, App Store, Booking, Facebook, Google Maps, Google Play, Google Shopping, Instagram, LinkedIn, Pinterest, Snapchat, TikTok, Twitter, Wikipédia, YouTube, Zalando, Bing et Google Search.

2. Le dispositif envisagé : une restructuration de la loi pour la confiance dans l'économie numérique afin de tirer les conséquences de l'entrée en vigueur du règlement sur les services numériques

La nécessaire adaptation de la LCEN est l'occasion à la fois de restructurer son contenu, de mettre à jour les définitions retenues, d'abroger les dispositions redondantes avec le RSN ou devenues obsolètes, et d'ajouter des dispositions supplémentaires qui nécessitent une adaptation de notre droit national.

a) La création des articles 1-1 et 1-2

Afin de disposer, au sein du titre Ier « De la liberté de communication en ligne », d'un chapitre Ier « La communication au public en ligne » plus cohérent, sont insérés deux articles supplémentaires après l'article 1er.

Premièrement, un article 1-1 qui reprend les dispositions des III, IV et V de l'article 6 de la LCEN, dans sa version actuelle. Ces dispositions sont respectivement relatives à la mise à disposition du public de certaines informations dans un standard ouvert, à l'exercice du droit de réponse auprès du directeur de la publication d'un éditeur ainsi qu'à l'application des dispositions de la loi du 29 juillet 1881 sur la liberté de la presse.

Deuxièmement, un article 1-2 qui reprend les dispositions du VI de l'article 6 de la LCEN dans sa version actuelle. Ces dispositions sont relatives à la sanction de la méconnaissance des obligations prévues au nouvel article 1-1 par un éditeur de service de communication au public en ligne.

b) La création de l'article 5-1 au sein de la LCEN

L'article 22 du projet de loi prévoit également une réorganisation du chapitre II du titre Ier, qui concerne les articles 5 à 9.

Premièrement, l'intitulé de ce chapitre II est modifié pour devenir « Les fournisseurs de services intermédiaires » plutôt que « Les prestataires techniques ».

Deuxièmement, une section 1 est créée au sein de ce chapitre, intitulée « Définitions et obligations relatives aux fournisseurs de services intermédiaires ».

Troisièmement, un article 5-1 est créé afin de définir les services de la société de l'information conformément à la définition retenue par la directive (UE) 2015/1535 du Parlement européen et du Conseil du 9 septembre 2015 prévoyant une procédure d'information dans le domaine des services de la société de l'information.

Il est également institué une définition des services intermédiaires, conformément à la définition retenue par l'article 3 du RSN. Ces services comprennent les services de simple transport, les services de mise en cache et les services d'hébergement.

c) La réécriture de l'article 6 au sein de la LCEN

L'article 22 du projet de loi procède à une restructuration importante de l'article 6 de la LCEN, qui suit désormais la structure suivante :

- définitions ;

- obligations des services d'accès à Internet et sanctions associées aux manquements ;

- obligations des hébergeurs et sanctions associées aux manquements ;

- obligations applicables à la fois aux services d'accès à Internet et aux hébergeurs, ainsi que leurs sanctions ;

- obligations applicables aux services de plateforme en ligne ;

- obligations applicables aux réseaux sociaux ;

- sanction pour signalement abusifs.

L'exercice de restructuration de l'article 6 de la LCEN a conduit à l'abrogation des dispositions suivantes, considérées comme obsolètes, contraires ou redondantes avec les dispositions du RSN :

- les conditions dans lesquelles la connaissance des faits litigieux est présumée acquise, dans le cadre du régime de responsabilité des hébergeurs, ont été abrogées car allant au-delà du RSN ;

- l'interdiction des obligations générales de surveillance, qui est redondante avec le RSN ;

- les obligations de transparence et de mise en place d'un système de signalement, redondantes avec le RSN ;

- les dispositions relatives au signalement des activités illicites de jeux d'agent, abrogées car devenues obsolètes par la réforme 2019/2020 sur la régulation des jeux d'argent en ligne, qui prévoit un pouvoir d'intervention direct de l'Autorité nationale des jeux sur les opérateurs.

2. La position de la commission - Une adaptation souhaitable de la loi pour la confiance dans l'économie numérique

La commission spéciale a adopté deux amendements des rapporteurs, de nature rédactionnelle ou de coordination :

- l'amendement COM-133 du rapporteur Patrick Chaize, de nature rédactionnelle ;

- l'amendement COM-134 du rapporteur Loïc Hervé, qui effectue les coordinations nécessaires aux modifications adoptées à l'article 5 du projet de loi.

La commission spéciale a adopté l'article 22 ainsi modifié.

Article 23

Adaptations relatives à la lutte

contre les contenus terroristes et pédopornographiques

L'article 23 procède à diverses coordinations et à une réorganisation des articles 6-1 à 6-2-1 de la loi du 21 juin 2004 pour la confiance dans l'économie numérique (LCEN).

Sur le fond, l'article prévoit de relever le plafond maximal de l'amende pénale - de 4 à 6 % du chiffre d'affaires mondial - encourue par un hébergeur en cas de méconnaissance habituelle de l'obligation d'informer immédiatement les autorités compétentes de contenus terroristes présentant une menace imminente pour la vie.

Il tend également à supprimer les conclusions du rapporteur public dans le cadre d'un recours exercé devant le tribunal administratif contre une injonction de retrait de contenus à caractère terroriste.

La commission spéciale a adopté cet article en rétablissant les conclusions du rapporteur public.

1. Des mesures de réorganisation et de coordination des dispositions de la LCEN relatives à la lutte contre les contenus terroristes et pédopornographiques

À l'instar des articles 22, 24 et 25 du présent projet de loi, l'article 23 prévoit une réorganisation de certaines dispositions de la loi n° 2004-575 du 21 juin 2004 pour la confiance dans l'économie numérique (LCEN).

Il créerait une section 2 intitulée « Dispositions relatives à la lutte contre les contenus terroristes et pédopornographiques » qui regrouperait les articles 6-1 à 6-2-1. Les dispositions de l'actuel article 6-5 de la LCEN, consacré à l'information du mineur et des titulaires de l'autorité parentale sur l'utilisation civique et responsable des réseaux sociaux, seraient intégrées à l'article 6 par l'article 22 du projet de loi, tandis que l'article 6-2 actuel, sur le contrôle du respect des obligations d'agrément préalable et de déclaration encadrant les enfants influenceurs, serait renuméroté 6-5.

Sur proposition du rapporteur, la commission spéciale a adopté un amendement COM-135 de clarifications rédactionnelles.

La commission spéciale a également noté qu'aucune des mesures d'harmonisation - recommandées par André Reichardt, dans son rapport135(*) sur la loi du 16 août 2022136(*), s'agissant des procédures nationale et européenne de retrait de contenus terroristes -, n'a été prévue. La prochaine adoption du règlement en vue de prévenir et de combattre les abus sexuels sur les enfants (CSAM)137(*) en créera peut-être de nouveau l'occasion.

2. Le rehaussement de l'amende encourue par les hébergeurs en cas de méconnaissance habituelle de l'obligation d'information de la présence de contenus terroristes en ligne

Le règlement (UE) 2021/784 du Parlement européen et du Conseil du 29 avril 2021 relatif à la lutte contre la diffusion des contenus à caractère terroriste en ligne (règlement TCO) a imposé de prévoir une sanction à l'encontre des hébergeurs qui, de manière habituelle, ne respecterait pas une injonction de retrait dans l'heure dont le montant maximal était fixé à 4 % du chiffre d'affaires mondial. C'est ce qui a été inscrit à l'article 6-1-3 de la LCEN créé par la loi du 16 août 2022 précitée.

Ce même montant maximal de 4 % du chiffre d'affaires mondial a été choisi en cas de méconnaissance habituelle par un hébergeur de son obligation d'informer immédiatement les autorités lorsqu'il prend connaissance d'un contenu à caractère terroriste présentant une menace imminente pour la vie, bien qu'aucun montant maximal n'ait été fixé dans le règlement européen.

L'article 23 du projet de loi prévoit de rehausser ce montant à 6 % du chiffre d'affaires mondial en cohérence avec l'article 52 du RSN, qui fixe ce plafond pour toutes les infractions à ce règlement.

Ce rehaussement ne paraît pas de nature à améliorer la cohérence d'ensemble des sanctions pécuniaires prévues dans le cadre de la LCEN ; toutefois il semble légitime de prévoir la sanction maximale autorisée au regard du risque réel pour les citoyens en cas de non-notification de soupçon de préparation d'un attentat.

3. Le maintien des conclusions du rapporteur public en cas de recours contre une injonction de retrait de contenus à caractère terroriste

L'article 23 prévoit également la suppression des conclusions du rapporteur public en cas de recours exercé devant le tribunal administratif contre une injonction de retrait de contenus à caractère terroriste, ce qui se justifierait du fait des délais de jugement resserrés pour ce contentieux.

Or, l'article R. 732-1-1 du code de justice administrative138(*) prévoit d'ores et déjà la possibilité pour le magistrat statuant seul de dispenser le rapporteur public, sur sa proposition, de prononcer des conclusions à l'audience pour ce contentieux.

Comme elle l'a déjà fait aux articles 2 et 3, la commission spéciale a adopté l'amendement COM-135 précité afin de conserver le caractère facultatif de cette dispense de conclusions du rapporteur public et laisser le soin aux magistrats de décider de l'opportunité de cette dispense.

La commission spéciale a adopté l'article 23 ainsi modifié.

Article 24

Adaptations au RSN de la loi du 21 juin

2004 pour la confiance dans l'économie numérique

L'article 24 déplace, sans modification substantielle, les dispositions relatives au blocage judiciaire de l'accès aux contenus illicites pour tenir compte de la restructuration de la loi pour la confiance de l'économie numérique du 21 juin 2004. Par ailleurs, il abroge l'actuel article 6-4 de la même loi, où étaient inscrites depuis 2021, par « pré-transposition » du RSN, les obligations qui s'imposent aux opérateurs en matière de lutte contre la diffusion de contenus illicites.

La commission spéciale a adopté cet article sans modification.

L'article 24 du projet de loi poursuit deux objectifs, tous deux liés à la restructuration de la LCEN.

En premier lieu, il déplace, sans les modifier, les dispositions relatives à l'intervention du président du tribunal judiciaire et à la portée de ses décisions en matière de lutte contre les contenus illicites.

Ces dispositions, qui figurent actuellement au I du 8 de l'article 6 et à l'article 6-3 de la LCEN, se trouveraient ainsi intégrées à une nouvelle section « Dispositions relatives à l'intervention de l'autorité judiciaire » regroupant :

- l'article 6-3, désormais relatif à la compétence du président du tribunal judiciaire pour prescrire en procédure accélérée « toutes mesures propres à prévenir un dommage ou à faire cesser un dommage occasionné par le contenu d'un service de communication au public en ligne » ;

- l'article 6-4, correspondant à l'actuel article 6-3 et qui concerne la portée des décisions judiciaires ainsi rendues, c'est-à-dire la possibilité pour l'autorité administrative, sur le fondement de la décision judiciaire, d'obtenir la mise hors d'accès des sites « miroirs » ou le déréférencement de ceux-ci ;

- l'article 6-5 (correspondant à l'actuel article 6-2 et dont le déplacement est prévu par l'article 23 du présent projet de loi), qui autorise l'administration à saisir le juge judiciaire lorsqu'elle constate qu'un contenu fait apparaître un mineur en violation des obligations d'agrément posées par le code du travail ou des obligations déclaratives posées par la loi n° 2020-1266 du 19 octobre 2020 visant à encadrer l'exploitation commerciale de l'image d'enfants âgés de moins de seize ans sur les plateformes en ligne.

Ces déplacements n'emportent pas de changement de fond des dispositions concernées.

Le même article 24 abroge l'article 6-4 actuel de la LCEN, où figure la liste des obligations qui s'imposent aux plateformes en ligne en matière de lutte contre les contenus illicites. Ces obligations, qui sont largement couvertes par le RSN s'agissant des « très grandes » plateformes (donc celles qui atteignent le seuil de 45 millions de connexions mensuelles à l'échelle européenne), concernent dans notre droit national les plateformes dépassent le seuil fixé par décret139(*) de 10 millions de visiteurs uniques par mois sur le territoire français.

Plus en détail, ces obligations concernent :

- la mise en oeuvre de procédures et de moyens humains et technologiques proportionnés permettant une coopération efficace avec les autorités judiciaires ou administratives compétentes (information sur les suites données aux injonctions ; traitement des réquisitions visant à identifier les utilisateurs ; conservation temporaire des contenus signalés et qui ont été rendus inaccessibles ou retirés à des fins de recherche, de constatation et de poursuite des infractions pénales)140(*) ;

- la désignation d'un point de contact unique, personne physique chargée de la communication avec les autorités publiques ;

- la mise à la disposition du public, de façon accessible, des conditions générales d'utilisation de leur service, cette obligation étant assortie de règles de transparence en matière de modération des contenus et de lutte contre les contenus illicites ;

- l'obligation de rendre compte au public des moyens mis en oeuvre pour lutter contre les contenus illicites, selon des modalités et une périodicité fixées par l'Arcom ;

- la mise en place d'un dispositif de signalement des contenus illicites aisément accessible et facile d'utilisation ;

- le traitement en priorité des signalements soumis par les tiers de confiance ;

- la mise en oeuvre de procédures et de moyens humains et technologiques proportionnés permettant le traitement effectif des signalements de contenus illicites (accusé de réception ; examen rapide ; information de l'auteur sur les suites données à son signalement et sur les voies de recours à sa disposition ; information de l'utilisateur en cas de retrait d'un contenu, en l'informant (notamment) de l'existence de sanctions civiles et pénales en cas de publication de contenus illicites ; etc.) ;

- la mise en oeuvre de dispositifs de recours interne ;

- l'exposition, dans les conditions générales d'utilisation, des procédures conduisant par exemple à la suspension ou à la résiliation d'un compte ;

- l'obligation de rendre compte à l'Arcom des procédures et moyens mis en oeuvre pour l'application des dispositions précitées.

Pour les opérateurs atteignant un nombre de visiteurs uniques mensuels encore plus important (15 millions de visiteurs uniques mensuels sur le territoire français), des obligations complémentaires s'appliquent. Ils doivent ainsi, aux termes du II de l'actuel article 6-4, procéder chaque année à une évaluation des risques systémiques liés au fonctionnement et à l'utilisation de leurs services en matière de diffusion des contenus illicites et d'atteinte à la liberté d'expression, mettre en oeuvre des mesures raisonnables, efficaces et proportionnées pour atténuer les risques de diffusion de ces contenus, et rendre compte au public de l'évaluation de ces risques et de la nature des mesures d'atténuation prises.

L'article 6-4 avait été inséré dans la LCEN au cours des débats sur la loi n° 2021-1109 du 24 août 2021 confortant le respect des principes de la République ; comme le rappelait le rapport établi, lors de l'examen de ce texte, par Jacqueline Eustache-Brinio et Dominique Vérien141(*) au nom de la commission des lois, cet ajout avait vocation, à l'initiative du Gouvernement, à « anticiper et “pré-transposer” [le RSN] » alors que débutaient seulement les négociations sur ce texte. Dans ce contexte, il est regrettable que le Gouvernement n'ait pas fourni, pour permettre la juste évaluation de cette évolution, des éléments chiffrés permettant de mesurer l'écart entre les seuils figurant dans la loi actuelle (10 ou 15 millions de visiteurs uniques par mois sur le territoire français) et le nouveau seuil issu du RSN (c'est-à-dire un « nombre mensuel moyen de destinataires actifs du service dans l'Union égal ou supérieur à 45 millions »), a fortiori alors que ces seuils sont fondés sur un ensemble de personnes (visiteurs uniques d'un côté, destinataires actifs de l'autre) et un périmètre géographique (la France d'un côté, l'Union européenne de l'autre) différents.

En dépit de cette lacune, il n'a pas paru raisonnable au rapporteur Loïc Hervé de maintenir dans la loi des dispositions qui prétendaient anticiper le RSN alors que celui-ci va entrer en application. Pour cette raison, il n'a pas proposé à la commission spéciale de revenir sur l'abrogation de l'article 6-4.

La commission spéciale a adopté l'article 24 sans modification.

Article 25

Adaptations de la loi pour la confiance dans

l'économie numérique

L'article 25 du projet de loi vise également à adapter la loi du 21 juin 2004 pour la confiance dans l'économie numérique afin de tirer les conséquences de l'application du règlement européen sur les services numériques, notamment concernant les missions et compétences du coordinateur national pour les services numériques : l'Autorité de régulation de la communication audiovisuelle et numérique (Arcom).

La commission a adopté cet article modifié par l'adoption de trois amendements du rapporteur Patrick Chaize, de nature rédactionnelle ou de coordination entres les procédures d'enquêtes domiciliaires attribuées à l'Arcom et à la Commission nationale pour l'informatique et les libertés (Cnil).

1. Une adaptation nécessaire des missions et pouvoirs de l'Arcom, désignée coordinateur national pour les services numériques

a) La réécriture de l'article 7

Tirant les conséquences de l'article 49 du règlement européen sur les services numériques, l'article 25 de ce projet de loi réécrit l'article 7 de la LCEN pour désigner l'Arcom comme coordinateur des services numériques. Ce coordinateur « est responsable de toutes les questions en lien avec la surveillance et l'exécution du présent règlement dans cet État membre, sauf si l'État membre concerné a assigné certaines missions ou certains secteurs spécifiques à d'autres autorités compétentes. Le coordinateur pour les services numériques a, en tout état de cause, la responsabilité d'assurer la coordination au niveau national vis-à-vis de ces questions et de contribuer à une surveillance et une exécution efficaces et cohérentes du présent règlement dans toute l'Union ».

L'article 25 du projet de loi désigne également la Direction générale chargée de la concurrence, de la consommation et de la répression des fraudes (DGCCRF) et la Cnil comme autorités administratives chargées de la mise en oeuvre de ce règlement européen.

Par conséquent, l'article 25 insère une section 4, intitulée « Coordinateur pour les services numériques et coopération entre les autorités compétentes » au sein du chapitre II de la LCEN relatif aux fournisseurs de services intermédiaires.

b) L'insertion des articles 7-2 et 7-3

Tirant les conséquences de l'article 57 du règlement européen sur les services numériques, l'article 25 de ce projet de loi insère un nouvel article 7-2 au sein de la LCEN pour préciser que les autorités chargées de la mise en oeuvre du RSN coopèrent étroitement et se prêtent mutuellement assistance, ce qui inclut notamment la libre communication d'informations dont elles disposent. Les modalités de coopération et d'assistance entre les autorités désignées seront précisées par la signature de conventions de coopération.

Tirant les conséquences de l'article 61 du règlement européen sur les services numériques, l'article 25 de ce projet de loi insère un nouvel article 7-3 au sein de la LCEN pour préciser que l'Arcom siège au comité européen des services numériques, sachant que l'Arcom peut être accompagnée, en fonction de l'ordre du jour, d'une autre autorité désignée comme compétente pour la mise en oeuvre du RSN.

Il est également précisé que l'Arcom assure une mission de veille et d'analyse des risques systémiques mentionnées à l'article 34 du RSN, c'est-à-dire :

- la diffusion de contenus illicites par l'intermédiaire des services de ces plateformes ;

- tout effet négatif réel ou prévisible pour l'exercice des droits fondamentaux, en particulier le droit fondamental à la dignité humaine, au respect de la vie privée et familiale, à la protection des données à caractère personnel, à la liberté d'expression et d'information, des droits fondamentaux relatifs aux droits de l'enfant et du droit fondamental à un niveau élevé de protection des consommateurs ;

- tout effet négatif réel ou prévisible sur le discours civique, les processus électoraux et la sécurité publique ;

- tout effet négatif réel ou prévisible lié aux violences sexistes et à la protection de la santé publique et des mineurs et les conséquences négatives graves sur le bien-être physique et mental des personnes.

c) L'insertion d'un article 8-1

Alors que l'Arcom n'était jusqu'à présent compétente que pour certains des acteurs visés par le RSN, par exemple les services de plateforme de partage de vidéo ou les opérateurs de plateforme en ligne - cette dénomination étant abrogée par le présent projet de loi -, l'article 25 consacre les compétences de l'Arcom à l'égard de l'ensemble des fournisseurs de services intermédiaires.

d) L'insertion d'un article 9-1

Tirant les conséquences de l'article 51 du RSN, l'article 25 du projet de loi insère un nouvel article 9-1 au sein de la LCEN afin de préciser que l'Arcom peut bénéficier de pouvoirs d'enquête et d'exécution afin de contraindre les fournisseurs de services intermédiaires à respecter leurs obligations.

À cet égard, l'Arcom peut recueillir, auprès de tout fournisseur de service intermédiaire qui a une activité sur le territoire national, les informations nécessaires à son travail de contrôle.

Surtout, l'article 25 du projet de loi dote les agents habilités et assermentés de l'Arcom d'un pouvoir de visites domiciliaires au sein des locaux des fournisseurs de services intermédiaires, sur le modèle de celui dont bénéficie la Cnil auprès des responsables de traitement de données à caractère personnel. L'Arcom pourra également émettre des injonctions provisoires à l'égard des fournisseurs mis en cause afin de les contraindre, avant la prononciation d'une éventuelle sanction, à se conformer aux griefs de la mise en demeure prononcée à leur égard.

e) L'insertion d'un article 9-2

L'article 25 du projet de loi insère un nouvel article 9-2 au sein de la LCEN afin de préciser les pouvoirs de sanction dont bénéficie l'Arcom à l'égard des fournisseurs de services intermédiaires qui ne respectent pas leurs obligations et pour lesquels le manquement a été constaté.

Les sanctions que l'Arcom peut prononcer sont de nature pécuniaire, et peuvent être assorties d'astreintes, d'injonctions de mise en conformité et de mesures de publicité.

La sanction pécuniaire prononcée ne peut ainsi excéder 6 % du chiffre d'affaires mondial hors taxe de l'exercice qui précède la sanction et le montant maximal de l'astreinte ne peut excéder 5 % des revenus ou du chiffre d'affaires mondial hors taxe journalier de l'exercice précédent l'astreinte.

2. La position de la commission - Un renforcement bienvenu des pouvoirs et missions de l'Arcom qui doit toutefois s'accompagner d'une hausse des moyens qui lui sont alloués

Si la commission spéciale salue le renforcement des pouvoirs de l'Arcom, qui a vocation à devenir le coordinateur national pour les services numériques, le rapporteur Patrick Chaize veillera à ce que l'Arcom bénéficie, dès le prochain projet loi de finances, des moyens budgétaires et humains nécessaires à l'accomplissement de ses nouvelles missions.

Sur ce point, l'étude d'impact du projet de loi insiste sur l'élargissement significatif des missions de l'Arcom permis par ce projet de loi. Si la dernière loi de finances a fixé un plafond d'emplois à 370 équivalents temps plein, un renforcement supplémentaire des effectifs et des moyens de l'Arcom sera nécessaire.

S'il est encore difficile d'évaluer précisément ces besoins, l'étude d'impact de la Commission européenne sur la mise en oeuvre du RSN estime que les coûts engendrés par les autorités de contrôle devraient fluctuer entre 50 000 et 300 000 euros par contrôle ou audit. En outre, la Commission européenne estime qu'en termes d'effectifs, les coûts directs varieront de 0,5 ETP à 25 ETP, en fonction de la taille des services établis dans chaque État membre.

Afin de compléter la rédaction de l'article 25 du projet de loi, la commission spéciale a également adopté les trois amendements suivants du rapporteur :

- l'amendement COM-136 précisant que le rôle attribué à l'Arcom en matière de coordination ne porte pas atteinte aux compétences et attributions des autorités administratives et des autorités de régulation qui concourent, par leurs activités et leurs missions, à mettre en oeuvre le règlement européen sur les services numériques ;

- l'amendement COM-137, qui apporte des précisions juridiques et rédactionnelles ;

- l'amendement COM-138 qui vise à harmoniser davantage la procédure d'enquêtes domiciliaires confiée à l'Arcom avec celle dont dispose déjà la Cnil conformément à l'article 19 de la loi relative à l'informatique, aux fichiers et aux libertés ainsi qu'à l'article 32 du projet de loi.

La commission spéciale a adopté l'article 25 ainsi modifié.

CHAPITRE II

Modification du code de la consommation

Article 26

Adaptation du

code de la consommation en cohérence avec la mise en oeuvre du

règlement sur les services numériques

L'article 26 vise à adapter certaines dispositions du code de la consommation au règlement sur les services numériques (RSN) afin d'harmoniser les définitions et obligations des plateformes en ligne et donner à la Direction générale de la concurrence, de la consommation et de la répression des fraudes (DGCCRF) les pouvoirs lui permettant de contrôler le bon respect de ces obligations.

La commission spéciale a adopté cet article modifié par l'adoption de deux amendements de précision juridique du rapporteur Patrick Chaize.

1. La nécessaire adaptation du code de la consommation au règlement européen sur les services numériques

a) L'harmonisation des différentes définitions

La définition de la plateforme en ligne présente dans le RSN repose sur le stockage et la diffusion au public d'informations par un service d'hébergement, à la demande du bénéficiaire d'un service. Cette définition inclut donc les réseaux sociaux ou les fournisseurs de places de marché en ligne, mais pas les moteurs de recherche.

Le code de la consommation encadre les plateformes dans un sens plus large, incluant les moteurs de recherches, les places de marché en ligne ou encore les comparateurs en ligne :

- l'article L. 111-7 définit l'opérateur de plateforme en ligne, en incluant, selon l'avis du Conseil d'État, les moteurs de recherche et les services d'intermédiation en ligne ;

- son article liminaire définit notamment la place de marché en ligne comme un service utilisant un logiciel qui permet aux consommateurs de conclure des contrats à distance avec d'autres professionnels ou consommateurs. Cette définition est issue de la directive dite « Omnibus »142(*) mais n'apparaît pas dans le RSN, qui considère toutefois les places de marchés en ligne comme une catégorie de plateformes en ligne.

Afin de mettre en cohérence ces définitions, le présent article procède aux adaptations suivantes :

- la définition d'une « plateforme en ligne » présente à l'article L. 111-7 du code de consommation est remplacée par la définition présente au sein du RSN et est placée à l'article liminaire du code de la consommation ;

- l'article liminaire du code est enrichi d'une définition du « moteur de recherche en ligne » puisque ce dernier n'entre pas dans le champ de la définition selon le RSN ;

- enfin, les comparateurs en ligne ne rentrant pas dans le champ du RSN, la définition en droit français peut être maintenue. Elle est toutefois placée à l'article liminaire.

b) L'harmonisation des obligations afférentes aux plateformes en ligne

Le RSN édicte des mesures d'harmonisation totale. Les dispositions nationales imposant des exigences supplémentaires aux opérateurs visés par le RSN doivent donc être abrogées, à l'exception de celles qui transposent des actes juridiques de l'Union européenne. En l'occurrence, la directive dite « Omnibus »143(*) prévoit une obligation d'information des consommateurs applicable aux contrats conclus sur des places de marché en ligne et précise que les États membres peuvent leur imposer des obligations supplémentaires si elles sont proportionnées et non discriminatoires.

Les obligations de transparence et de loyauté des contenus sont donc aménagées dans le respect du droit européen de la consommation :

- l'article L. 111-7 impose aux plateformes d'informer le consommateur sur les modalités de référencement et de déréférencement des contenus des biens ou des services proposés ou mis en ligne. Ces obligations sont désormais réservées aux fournisseurs de places de marché et aux comparateurs - ces derniers n'étant pas visés par le RSN ;

- l'article 111-7-1 prévoit quant à lui que les opérateurs de plateformes en ligne qui dépassent un seuil de nombre de connexions défini par décret (en l'occurrence, cinq millions) élaborent et diffusent aux consommateurs des bonnes pratiques visant à renforcer les obligations de clarté, transparence et loyauté, tandis que le RSN fixe un seuil à 45 millions de connexions par mois. Il est donc abrogé ;

- l'article L. 111-7-3 est modifié pour que l'obligation de réaliser un audit de cybersécurité s'applique aux fournisseurs de plateformes en ligne, de moteurs de recherche en ligne et de comparateurs en ligne.

c) La désignation de la DGCCRF pour contrôler le bon respect des obligations incombant aux opérateurs des places de marché en ligne

L'article 26 crée un régime de sanctions

à l'encontre des fournisseurs de plateforme en ligne à l'article

L. 133-1 du code de la consommation,

dans un nouveau chapitre III

intitulé « Obligations des fournisseurs de plateformes en

ligne ».

Il habilite les agents de la DGCCRF pour rechercher et constater les infractions des fournisseurs de places de marché en ligne à leurs obligations de traçabilité des professionnels144(*), de conformité des interfaces dès leur conception145(*), de droit d'information des consommateurs146(*) et en termes d'interdiction de concevoir des dark patterns - des interfaces conçues de façon à tromper, manipuler ou entraver la capacité des consommateurs à prendre des décisions libres et éclairées147(*).

Bien que les articles 30 à 32 du RSN visent les fournisseurs de plateforme en ligne « permettant aux consommateurs de conclure des contrats à distance avec des professionnels », il est possible pour le droit national de cibler plus largement les fournisseurs de places de marché en ligne, en vertu de la directive « Omnibus » mentionnée plus haut.

Les infractions sont punies d'une peine de deux ans d'emprisonnement et d'une amende de 300 000 euros pouvant atteindre 6 % du chiffre d'affaires mondial pour une personne morale. Il est donné à la DGCCRF la possibilité de demander au juge civil d'enjoindre à l'auteur d'un manquement de se mettre en conformité, injonction qui peut être assortie d'une astreinte pouvant atteindre 5 % du chiffre d'affaires hors taxes journalier moyen réalisé au cours du dernier exercice clos. Des peines complémentaires sont créées pour les personnes physiques ainsi que pour les personnes morales dès lors qu'elles sont déclarées pénalement responsables.

d) L'adaptation des pouvoirs d'enquête et de sanction

Il est inséré une nouvelle section 4 au sein du chapitre II du titre Ier du livre V du code de la consommation, intitulée « Dispositions spécifiques aux plateformes en ligne », afin de régir de manière spécifique les pouvoirs des agents de la DGCCRF pour rechercher et constater les infractions au RSN :

- un article L. 512-66 dispose que la recherche et la constatation de ces infractions par la DGCCRF s'effectuent dans les mêmes conditions d'indépendance que celles qui régissent le coordinateur pour les services numériques148(*) ;

- un article L. 512-7 confère aux agents de la DGCCRF un pouvoir d'accès aux données de certaines plateformes nécessaires au contrôle de la bonne application du RSN, dans les mêmes conditions que le coordinateur national pour les services numériques149(*) ;

- un article L. 512-68 prévoit la coopération entre les agents de la DGCCRF et les agents du coordinateur des services numériques, l'Arcom.

Il est aussi créé un article L. 531-7 pour sanctionner les entraves à l'enquête comme la fourniture d'informations inexactes ou le refus de se soumettre à une opération de visite et une saisie.

Enfin, l'article L. 521-3-1 est adapté pour élargir les cas où la DGCCRF peut avoir recours à la réquisition des plateformes en ligne :

- aux cas de manquement ou d'infraction aux règles relatives à la conformité et à la sécurité non seulement des produits, mais aussi des services ;

- lorsque le professionnel n'a pas déféré à une injonction en matière de sécurité des produits et des services ;

- aux cas d'infraction mettant en jeu la sécurité ou la santé des consommateurs lorsque l'auteur n'a pas déféré à une injonction.

2. La position de la commission : une adaptation du droit de la consommation qui doit s'accompagner d'une hausse indispensable des moyens alloués à la DGCCRF

La commission spéciale est favorable à une adaptation du droit national au droit de l'Union européenne permettant la bonne mise en oeuvre du RSN sans contrariété juridique. Elle est également favorable à l'élargissement des missions et des pouvoirs de la DGCCRF qui découle de sa désignation comme autorité contrôlant la bonne application des obligations des fournisseurs de plateformes numériques prévues au RSN.

Toutefois, elle rappelle que l'élargissement, certes bienvenu, des missions de la DGCCRF doit aller de pair avec une augmentation de ses moyens, budgétaires et humains, et ce dès le prochain projet de loi de finances. Ce constat fait suite à plusieurs alertes de la commission des affaires économiques sur l'inadéquation entre les missions et les moyens de la DGCCRF. Au cours du dernier quinquennat, plus d'une trentaine de lois et ordonnances lui ont confié de nouvelles missions ainsi que des outils d'actions modernisés, sans que le Gouvernement ne mette ses moyens en adéquation avec ses nouveaux objectifs. Dans le cadre de l'examen du projet de loi de finances pour 2023, la commission des affaires économiques avait ainsi adopté un amendement visant à octroyer à la DGCCRF cinq millions d'euros supplémentaires en autorisation d'engagement.

Dès l'examen du prochain projet de loi de finances, la commission des affaires économiques se montrera donc attentive à la poursuite de la hausse des effectifs de la DGCCRF afin que ses moyens soient cohérents avec l'étendue de ses missions, notamment au vu des orientations qui seront précisées dans le prochain programme national d'enquête.

La commission spéciale a adopté deux amendements du rapporteur :

- l'amendement COM-139 de précision rédactionnelle visant à déterminer l'amende maximale pouvant être prononcée pour sanctionner des manquements aux obligations des fournisseurs de plateformes en ligne en fonction du chiffre d'affaires mondial hors taxes de la personne morale contrôlée ;

- l'amendement COM-140 de précision juridique visant à rappeler que les pouvoirs de contrôle de la DGCCRF des fournisseurs de plateforme en ligne au regard de leurs obligations s'exercent conformément au principe du pays d'origine.

La commission spéciale a adopté l'article 26 ainsi modifié.

CHAPITRE III

Modification du code de commerce

Article 27

Adaptation du

code de commerce au règlement

sur les marchés

numériques

L'article 27 vise à adapter le code de commerce au règlement sur les marchés numériques (RMN) pour donner aux autorités françaises les moyens de conduire des investigations et de coopérer avec la Commission européenne sur les pratiques des contrôleurs d'accès.

La commission spéciale a adopté cet article sans modification.

1. Des mesures nécessaires d'adaptation du code de commerce au règlement européen sur les marchés numériques

a) La désignation des juridictions spécialisées

L'article 26 du projet de loi précise à l'article L. 420-7 du code de commerce que les litiges relatifs à l'application du RMN sont attribués aux juridictions civiles et commerciales spécialisées actuellement compétentes pour les litiges en matière de pratiques anticoncurrentielles, dont le siège et le ressort sont fixés par décret en Conseil d'État.

Il est également procédé à une actualisation des références aux articles des traités européens mentionnés au sein de cet article L. 420-7.

b) La désignation des autorités compétentes

Le code de commerce est complété d'un article L. 450-11 qui précise que l'Autorité de la concurrence (ADLC), le ministère chargé de l'économie et les fonctionnaire qu'il a désignés ou habilités - en pratique, à la Direction générale de la consommation, de la concurrence et de la répression des fraudes (DGCCRF) - sont les autorités nationales chargées de faire appliquer les règles mentionnées à l'article 1er, paragraphe 6 , du RMN, c'est-à-dire les règles de concurrence européennes et nationales concernant le contrôle des concentrations, les accords anticoncurrentiels, les décisions d'association, les pratiques concertées et les abus de position dominante.

En effet, le RMN ne se substitue pas à la régulation existante aux niveaux national et européen mais la complète avec un cadre de régulation ex ante applicable à certains acteurs - les contrôleurs d'accès - sans priver ni les autorités nationales ni la Commission européenne de la possibilité d'intervenir en vertu d'autres règles existantes, éventuellement ex post.

c) Les pouvoirs reconnus à ces autorités

Le RMN rappelle que les autorités nationales coopèrent et échangent avec la Commission européenne dans le cadre d'un « Réseau européen de concurrence ». Ainsi, le code de commerce est complété par des articles précisant les compétences du ministre chargé de l'économie ainsi que de l'ADLC :

- un article L. 450-12 précise qu'ils disposent des pouvoirs reconnus par le code de commerce pour mener des auditions et recueillir des déclarations, pour effectuer des inspections et des enquêtes de marché en soutien à la commission et pour ouvrir et conduire des investigations sur un cas de non-respect éventuel des obligations imposées aux contrôleurs d'accès par le RMN ;

- un article L. 462-9-2 les rend compétents pour recevoir les renseignements en provenance de tiers sur toute pratique ou comportement des contrôleurs d'accès relevant du champ d'application du RMN, sans être tenus de donner suite aux renseignements reçus. En cas de non-respect au RMN, ils transmettent ces informations à la Commission européenne.

Enfin, le code de commerce est complété d'un article L. 490-9 qui précise que le ministre chargé de l'économie ou son représentant est habilité à adresser à la Commission européenne, conjointement avec au moins trois autres États membres, une demande d'ouverture d'enquête de marché lorsqu'il existe des motifs raisonnables de soupçonner qu'une entreprise est « contrôleur d'accès », en application de l'article 41 du RMN.

Ces articles actualisent également les références aux articles des traités européens mentionnés.

2. La position de la commission : une adaptation du code du commerce qui doit s'accompagner d'un renforcement indispensable des moyens alloués aux autorités administratives chargées de la concurrence

La commission spéciale est favorable à l'adaptation effective du droit national afin de permettre aux autorités nationales chargées de l'application du droit de la concurrence d'élargir leurs compétences actuelles en coordination avec la Commission européenne au bénéfice de la mise en oeuvre du RMN.

En revanche, la commission note que ces nouvelles missions importantes nécessiteront un renforcement significatif des moyens, notamment humains, de la DGCCRF et de l'ADLC. Ces moyens n'ont pour l'instant pas été objectivés par le Gouvernement, même si l'étude d'impact mentionne des demandes de hausses d'équivalents temps plein portées par ces autorités. Lors de l'examen des prochains projets de loi de finances, la commission des affaires économiques sera donc très vigilante à l'octroi de moyens suffisants à l'ADLC et à la DGCCRF.

La commission spéciale a adopté l'article 27 sans modification.

CHAPITRE IV

Mesures d'adaptation de la loi n° 86-1067

du 30 septembre 1986 relative à la liberté de

communication

Article 28

Adaptations au

RSN de la loi n° 86-1087 du 30 septembre 1986 sur la liberté de

communication

L'article 28 apporte diverses modifications à la loi du 30 septembre 1986 sur la liberté de communication afin de tirer les conséquences des nouvelles responsabilités dévolues à l'Arcom par le RSN et d'y intégrer les terminologies issues du « paquet numérique » européen.

La commission spéciale a adopté cet article en y apportant des modifications visant à clarifier sa rédaction.

1. Les mesures d'adaptation de la loi du 30 septembre 1986 relative à la liberté de communication

L'article 28 du projet de loi comporte diverses mesures d'adaptation de la loi du 30 septembre 1986 relative à la liberté de communication, dite « loi Léotard », pour tenir compte des nouvelles règles instaurées par le RSN. En particulier, il :

- opère des actualisations terminologiques, notamment pour substituer à la notion d'« opérateurs de plateforme en ligne », les notions similaires découlant du RSN. Ce faisant, il est cependant porteur de divergences de rédaction peu compréhensibles, une même notion dans les textes en vigueur pouvant se trouver traduite de plusieurs manières différentes sans justification apparente. C'est ainsi, par exemple, qu'alors que la loi de 1986 renvoie à la même notion d'« opérateurs de plateforme en ligne » au sens de l'article L. 111-7 du code de la consommation en ses articles 14 (contrôle de l'Arcom sur la programmation des émissions publicitaires) et 58 (recommandations de l'Arcom en matière lutte contre la manipulation de l'information en période électorale), le projet de loi ne rend que le premier de ces articles, mais non le second, applicable aux plateformes de partage de vidéos ;

- met à jour des références législatives ou procède à des abrogations, par coordination avec les autres dispositions du projet de loi ;

- réécrit, afin d'en prévoir l'articulation avec les nouveaux outils issus du RSN, les dispositions relatives à la publication, par l'Arcom, d'un bilan périodique des actions entreprises par les plateformes au titre de la lutte contre la désinformation ;

- confirme la compétence de l'Arcom pour superviser, y compris en utilisant ses pouvoirs d'enquête et d'injonction, le respect par les plateformes de partage de vidéos de leurs obligations.

Par ailleurs, l'article 28 maintient en vigueur, jusqu'au 17 février 2024 (au lieu du 31 décembre 2023), les dispositions transitoires issues de la loi n° 2021-1109 du 24 août 2021 confortant le respect des principes de la République et relatives aux obligations des plateformes en ligne en matière de lutte contre les contenus haineux : plus en détail, ces dispositions confient au Conseil supérieur de l'audiovisuel (donc aujourd'hui à l'Arcom) la mission de veiller au respect par les plateformes des obligations issues de l'article 6-4 de la LCEN s'agissant de la lutte contre les contenus illicites150(*) et d'établir, à cet égard, des lignes directrices pour l'application de ces mêmes obligations. Il donne également au régulateur des pouvoirs d'accès aux données des plateformes, y compris avec une collecte automatisée, et le charge de définir les informations et indicateurs chiffrés que les opérateurs sont tenus de publier comme de publier lui-même, chaque année, un rapport établissant le bilan de ce mécanisme. Il le dote enfin d'un pouvoir de mise en demeure lui permettant de faire respecter, à peine de sanction pécuniaire, les obligations de l'article 6-4 ainsi que ses demandes d'accès aux données des opérateurs.

Ces dispositions avaient vocation à s'appliquer dans l'attente de l'entrée en vigueur du RSN, initialement prévue le 1er janvier 2024 ; la modification de la date d'échéance de ce régime provisoire est donc le reflet du report de cette entrée en application.

2. La position de la commission spéciale

La commission spéciale a adopté cet article, enrichi de plusieurs modifications adoptées à l'initiative du rapporteur Loïc Hervé pour :

- clarifier des rédactions ambiguës (amendement COM-142) ;

- consacrer la compétence de l'Arcom en matière de régulation des plateformes de partage de vidéo, cette notion n'étant pas absolument équivalente à celle de « plateforme en ligne » au sens du RSN (amendements COM-141 et COM-143).

La commission spéciale a adopté l'article 28 ainsi modifié.

CHAPITRE V

Mesures d'adaptation de la loi relative

à la lutte contre la manipulation de l'information

Article 29

Abrogation de

trois articles de la loi du 22 décembre 2018 relative à la lutte

contre la manipulation de l'information (loi Infox)

L'article 29 du présent projet de loi tend à abroger les articles 11, 13 et 14 de la loi du 22 décembre 2018 relative à la lutte contre la manipulation de l'information, dite loi Infox, dont plusieurs dispositions apparaissent couvertes par le règlement sur les services numériques (RSN).

Ces trois articles imposent aux plateformes en ligne un devoir de coopération en matière de lutte contre la diffusion de fausses informations, prenant la forme d'un dispositif de signalement spécifique aux fausses informations (article 11), la désignation d'un représentant légal exerçant les fonctions d'interlocuteur référent pour l'application des mesures relatives à la lutte contre la désinformation en ligne (article 13) et la publication de statistiques agrégées sur le fonctionnement des algorithmes de recommandation, classement ou référencement de contenus d'information se rattachant à un débat d'intérêt général (article 14).

La commission spéciale a adopté cet article en maintenant, dans le droit national, l'obligation, pour les plateformes en ligne, de mettre en place un dispositif de signalement des fausses informations.

1. Dans un objectif de « responsabilisation » des opérateurs de plateformes en ligne, la loi Infox de 2018 a imposé à ces derniers un devoir de coopération en matière de lutte contre la diffusion de fausses informations

a) Jusqu'en 2018, aucun dispositif spécifiquement dédié à la lutte contre la diffusion de fausses informations ne s'appliquait aux opérateurs de plateformes en ligne

Conformément à la directive 2000/31/CE du 8 juin 2000151(*), dite directive sur le commerce électronique, le principe d'ensemble régissant l'écosystème numérique repose sur un régime de responsabilité limitée des hébergeurs et des intermédiaires techniques, qui n'ont pas une obligation générale de surveillance des contenus publiés sur leur plateforme en ligne.

Cette obligation s'imposant à l'échelle européenne a été transposée en droit interne à l'article 6 de la loi du 21 juin 2004 pour la confiance dans l'économie numérique152(*) (LCEN), lequel dispose, en son point 7, que les hébergeurs et les intermédiaires techniques « ne sont pas soumis à une obligation générale de surveiller les informations qu'[ils] transmettent ou stockent, ni à une obligation générale de rechercher des faits ou des circonstances révélant des activités illicites. »

Cependant, si les hébergeurs n'ont pas d'obligation de surveillance, ils doivent tout de même mettre en place des dispositifs de signalement pour certains types de contenus, définis par la loi.

Ce dispositif doit être « facilement accessible et visible » et permettre « à toute personne de porter à [la] connaissance » des hébergeurs les « activités illicites » définies par la loi. Une fois ces activités illicites signalées aux hébergeurs, ces derniers sont sommés d'en « informer promptement les autorités publiques compétentes ». Ces signalements sont alors traités par le portail officiel de signalement des contenus illicites de l'Internet, Pharos, géré par l'Office central de lutte contre la criminalité liée aux technologies de l'information et de la communication (OCLCTIC). Les hébergeurs doivent en outre « rendre publics les moyens qu'[ils] consacrent à la lutte contre [ces] activités illicites »153(*).

En l'état actuel du droit154(*), les contenus illicites mentionnés à l'article 6 de la LCEN, pour lesquels les hébergeurs doivent mettre en place des dispositifs de signalement, appartiennent à deux catégories :

- les activités illégales de jeux d'argent ;

- les activités en lien avec la sécurité et la dignité humaine, à savoir « l'apologie, la négation ou la banalisation des crimes contre l'humanité, la provocation à la commission d'actes de terrorisme et leur apologie, l'incitation à la haine raciale, à la haine à l'égard de personnes à raison de leur sexe, de leur orientation sexuelle, de leur identité de genre ou de leur handicap ainsi que la pornographie enfantine, l'incitation à la violence, notamment l'incitation aux violences sexuelles et sexistes, ainsi que les atteintes à la dignité humaine »155(*).

Ainsi, le cadre général régissant les obligations de mise en place de dispositifs de signalement s'appliquant aux opérateurs de plateformes en ligne n'inclut pas les fausses informations, lesquelles sont définies par l'article L. 163-2 du code électoral comme « toute allégation ou imputation d'un fait inexacte ou trompeuse [...] diffusée de manière délibérée ».

La diffusion délibérée de fausses informations est cependant sanctionnée par plusieurs textes, depuis au moins la loi du 29 juillet 1881 sur la liberté de la presse qui a instauré un délit de « fausses nouvelles », sans pour autant que ces dispositions, souvent anciennes, ne prévoient de mesures spécifiques à la désinformation en ligne.

Synthèse des principales dispositions législatives réprimant la désinformation, hors dispositions liées au numérique

|

Fondements |

Qualifications/Principe |

Peines encourues/actions |

|

Article 27 de la loi |

Délit de fausses nouvelles |

45 000 € d'amende (135 000 € |

|

Articles 29, 30, 31 et 32 de la loi |

Délit de diffamation publique |

12 000 € d'amende (45 000 € si la

personne visée est un élu |

|

Article L. 97 |

Délit de fausses nouvelles |

Un an d'emprisonnement |

|

Article 9 |

Droit au respect de la vie privée |

Action en référé possible |

|

Article 226-8 |

Délit de photomontage ou montage sonore sans le consentement et sans consentement et sans précision qu'il s'agit d'un montage |

Un an d'emprisonnement |

Source : commission spéciale

b) La loi Infox de 2018 a soumis les opérateurs de plateformes en ligne à de nouvelles obligations de transparence des algorithmes et de signalement des fausses informations

Le législateur français a récemment cherché à remédier à l'absence de dispositif dédié à la lutte contre les fausses informations en ligne en instaurant un mécanisme ad hoc régi par la loi dite Infox du 22 décembre 2018156(*), et donc distinct du cadre général porté par l'article 6 de la loi pour la confiance dans l'économie numérique.

L'un des objectifs de la loi Infox, selon les termes de la rapporteure du texte pour la commission de la culture, de l'éducation et de la communication du Sénat, Catherine Morin-Desailly, consistait à confier aux opérateurs de plateformes en ligne « de nouvelles responsabilités »157(*) en matière de lutte contre la désinformation, tout en respectant les principes généraux définis par la directive européenne relative à l'économie numérique (cf. supra).

Pour atteindre cet objectif, le titre III de la loi Infox impose aux opérateurs de plateformes en ligne un devoir de coopération en matière de lutte contre la diffusion de fausses informations.

Ce devoir de coopération se matérialise par leur assujettissement à de nouvelles règles, définies notamment aux articles 11, 13 et 14 de la loi Infox :

- l'article 11 leur impose, d'une part, de mettre en place un dispositif de signalement, « facilement accessible et visible », spécifique aux fausses informations susceptibles de troubler l'ordre public ou d'altérer la sincérité d'un scrutin et, d'autre part, de prendre des « mesures complémentaires » pouvant « notamment » porter sur « la transparence des algorithmes », « la promotion de certains contenus d'entreprises et d'agences de presse et d'éditeurs audiovisuels », « la lutte contre certains comptes qui propagent des fausses informations », « la transparence vis-à-vis de l'identité des personnes pour le compte desquelles les contenus sont diffusés » ou encore « l'éducation aux médias et à l'information ». Ces mesures doivent être rendues publiques et donnent lieu à « une déclaration » adressée à l'Arcom ;

- l'article 13 impose aux mêmes opérateurs de plateformes la désignation d'un représentant légal exerçant les fonctions « d'interlocuteur référent » sur le territoire français pour l'application des mesures relatives à la lutte contre la désinformation en ligne et contre les « activités illicites » mentionnées au point 7 de l'article 6 de la LCEN (cf. supra) ;

- enfin, l'article 14 prévoit la publication en format libre et ouvert, par chaque opérateur de plateforme en ligne, de statistiques agrégées sur le fonctionnement des algorithmes de recommandation, classement ou référencement de contenus d'information se rattachant à un débat d'intérêt général.

Aucune sanction n'est passible en cas de manquement aux obligations résultant de ces trois articles, à l'exception de la publicité négative qui pourrait advenir de la publication du bilan annuel de l'Arcom en matière de lutte contre la désinformation en ligne (cf. infra).

En application de l'article D. 111-15 du code de la consommation, ces obligations concernent les opérateurs dont les plateformes dépassent un seuil de cinq millions de connexions de visiteurs uniques par mois.

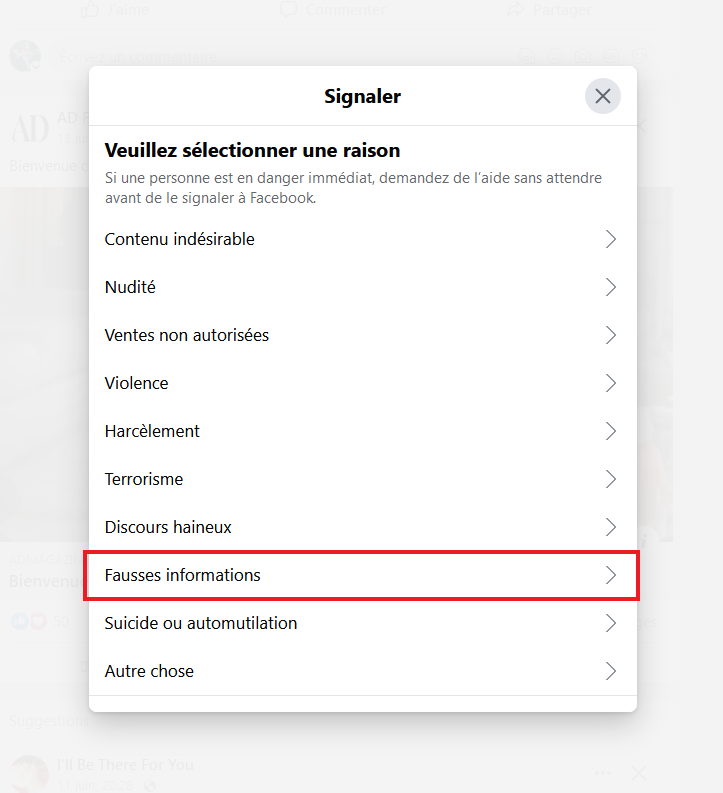

À titre d'illustration, cela inclut le groupe Meta, auquel appartient la plateforme Facebook. Celle-ci a rassemblé au sein d'un onglet unique les divers motifs pour lesquels la LCEN et la loi Infox lui imposent de mettre à la disposition de l'utilisateur un dispositif de signalement, incluant les fausses informations.

Dispositif de signalement de la plateforme Facebook

Source : Commission spéciale d'après une capture d'écran issue de la plateforme Facebook

c) Une application « globalement satisfaisante » des mesures de lutte contre les fausses informations

Aussi bien dans son bilan annuel des moyens et mesures mis en oeuvre par les opérateurs de plateforme en ligne sur l'année 2021158(*) qu'en réponses aux interrogations formulées par le rapporteur Loïc Hervé, l'Autorité de régulation de la communication audiovisuelle et numérique (Arcom) a indiqué que les opérateurs concernés se soumettaient désormais de façon « globalement satisfaisante » à l'obligation de mise en place d'un outil de signalement des fausses informations susceptibles de troubler l'ordre public ou d'altérer la sincérité d'un des principaux scrutins.

L'Autorité estime néanmoins que l'accessibilité et la visibilité de cet outil demeurent « inégales » d'une plateforme à l'autre, en particulier pour les moteurs de recherche. De plus, l'Arcom déplore « un manque flagrant » d'indicateurs et de données chiffrées relatives aux signalements et à l'efficacité de leur traitement, empêchant une évaluation de la pertinence et l'efficacité des mesures au regard des risques associés à chacun des services.

Si la mise en place d'un dispositif de signalement des fausses informations est obligatoire, les « mesures complémentaires » que prévoit, de façon moins contraignante, l'article 11 de la loi Infox (cf. supra) ont également été déployées par tous les opérateurs concernés. L'Arcom a cependant constaté que le déploiement de ces mesures a été « plus ou moins approfondi » selon les opérateurs, certains ayant instauré volontairement des dispositifs allant au-delà de leurs obligations légales, comme par exemple des outils de lutte contre les publicités comportant de la désinformation ou de lutte contre les hypertrucages159(*) à visée de désinformation. Ces mêmes disparités entre opérateurs ont été identifiées en matière d'éducation aux médias et à l'information, la quantité d'actions engagées par les opérateurs en direction des utilisateurs variant fortement.

Toujours selon l'Arcom, l'article 13 de la loi Infox, imposant aux opérateurs de plateformes en ligne de désigner un référent national en matière de lutte contre la désinformation, a été respecté par l'ensemble des opérateurs concernés, à l'exception de Wikipédia. Toutefois, l'Arcom a noté qu'à la suite de départs des référents de deux opérateurs (Snapchat et Twitter), aucun nouveau référent n'a pas été désigné, malgré ses demandes.

Ce bilan plutôt favorable est néanmoins nuancé par les efforts de transparence qui pourraient, selon l'Arcom, être encore accrus, notamment en termes de transmission de données chiffrées et d'informations concernant les modèles de vente et d'enchères et le ciblage publicitaire.

2. L'article 29 procède à l'abrogation de trois articles traitant de la lutte contre la désinformation, qui ne sont que partiellement couverts par le RSN

L'article 29 du projet de loi tend à abroger les articles 11, 13 et 14 de la loi Infox, décrits ci-dessus.

Cette abrogation serait justifiée par leur redondance avec le règlement sur les services numériques, qui est d'application directe et dont certains articles couvrent des sujets similaires.

a) Le signalement des fausses informations

L'article 16 du RSN, qui s'applique aux fournisseurs de services d'hébergement, y compris les plateformes en ligne, prévoit l'instauration obligatoire de « mécanismes permettant à tout particulier ou à toute entité de leur signaler la présence au sein de leur service d'éléments d'information spécifiques que le particulier ou l'entité considère comme du contenu illicite ». Ce dispositif de signalement doit être « facile d'accès et d'utilisation et permettent la soumission de notifications exclusivement par voie électronique ».

Ce dispositif de signalement est présenté dans l'étude d'impact du projet de loi comme une obligation similaire à celle qui résulte de l'article 11 de la loi Infox. Il convient cependant de noter que la définition juridique des « contenus illicites » est imprécise, ce qui pourrait entraîner des divergences d'interprétation quant à l'intégration ou non des fausses informations au sein du dispositif de signalement.

En effet, bien que le considérant n° 12 du RSN dispose qu'il faille « donner une définition large de la notion de contenu illicite », il ne mentionne par la suite que « les informations, quelle que soit leur forme, qui, en vertu du droit applicable, sont soit elles-mêmes illicites, comme les discours haineux illégaux ou les contenus à caractère terroriste et les contenus discriminatoires illégaux, soit rendues illicites par les règles applicables en raison du fait qu'elles se rapportent à des activités illégales ». Outre que les fausses informations ne sont pas nommément incluses au sein du considérant n° 12, l'absence, en droit interne, de définition des fausses informations plus claire que celle qui résulte de l'article L. 163-2 du code électoral rend incertaine l'intégration de celles-ci parmi le nouveau régime d'obligations issu du RSN s'appliquant aux opérateurs de plateformes en ligne.

Ainsi, interrogée par le rapporteur, l'Arcom confirme ces inquiétudes en considérant que « si le législateur a précisé le type de phénomènes contre lequel les plateformes doivent lutter, la manipulation de l'information et les fausses informations ne font pas l'objet d'une définition légale » faisant consensus. C'est pourquoi les fausses informations ne semblent ainsi relever des « contenus illicites » mentionnés par le RSN « que dans l'hypothèse où leur diffusion permet par ailleurs de caractériser une infraction prévue en droit français ». La Direction générale des entreprises (DGE) estime quant à elle sans ambiguïté que « les fausses informations mentionnées à l'article 11 de la loi Infox ne sont pas des contenus illicites »160(*) tels que mentionnés à l'article 16 du RSN, puisque le signalement de ces informations ne déclenchera pas le régime de responsabilité limité des services d'hébergement. La DGE considère que ces éléments restrictifs maintiennent néanmoins la possibilité, pour l'utilisateur, de signaler malgré tout une fausse information par le biais du mécanisme de signalement des contenus illicites prévu à l'article 16 du RSN.

En parallèle du RSN, les fausses informations font l'objet de plusieurs mesures au sein du code européen renforcé de bonnes pratiques contre la désinformation du 16 juin 2022, notamment l'engagement n° 23 qui prévoit la mise en place d'un dispositif de signalement relatif aux « informations fausses et/ou préjudiciables ». Ce code de conduite n'est toutefois soumis qu'à la bonne volonté des opérateurs de plateformes en ligne, lesquels ne sont pas obligés d'y souscrire : d'après la Commission européenne, seuls 34 d'entre eux y ont adhéré lors de la présentation de ce code de bonnes pratiques161(*), dont Twitter qui s'en est depuis retiré.

En outre, dans le cadre de l'évaluation des risques systémiques mentionnés à l'article 34 du RSN, les très grandes plateformes en ligne et les très grands opérateurs de recherche en ligne doivent « recenser, analyser et évaluer » les risques liés « à la diffusion de contenus illicites par l'intermédiaires de leurs services ». La commission spéciale appelle à ce que soit adoptée une acception « large », pour reprendre le terme du considérant n° 12, de ces contenus illicites afin d'y inclure les fausses informations, notamment au regard de l'article 35 qui mentionne également les « risques systémiques » ayant un « effet négatif réel ou prévisible sur le discours civique, les processus électoraux et la sécurité publique ».

b) Les mesures « complémentaires » de lutte contre la désinformation

Plusieurs articles du RSN traitent des « mesures complémentaires » que peuvent mettre en place les opérateurs de plateformes en ligne, conformément à l'article 11 de la loi Infox précitée :

- la transparence des algorithmes et des modalités de diffusion des contenus est régie par l'article 27 du RSN ;

- la transparence sur l'identité des commanditaires de contenus publicitaires est imposée par l'article 26 du RSN.

En revanche, certaines dispositions n'ont aucun équivalent dans le RSN ou vont au-delà des obligations que ce règlement impose, ce qui signifie que leur abrogation ne serait pas compensée par celui-ci. Il s'agit :

- de l'éducation aux médias et à l'information (aucun équivalent dans le RSN) ;

- de la promotion des contenus issus d'entreprises et d'agences de presse et de services de communication audiovisuelle (aucun équivalent dans le RSN) ;

- et de la lutte contre les comptes qui propagent des fausses informations. Ce dernier point va au-delà de l'article 23 du RSN, qui impose aux opérateurs de plateformes en ligne de suspendre les utilisateurs qui « fournissent fréquemment des contenus manifestement illicites », sans qu'il ne soit fait mention particulière des fausses informations.

c) La désignation d'un référent

L'article 13 de la loi Infox impose aux opérateurs de plateformes en ligne la désignation d'un représentant légal sur le territoire français, exerçant les fonctions d'interlocuteur référent en matière de lutte contre la désinformation et de contenus illicites.

Cette obligation n'est que partiellement couverte par l'article 13 du RSN, qui impose certes la désignation d'un représentant légal pour tous les fournisseurs de services intermédiaires proposant des services dans l'Union sans avoir d'établissement au sein de l'Union européenne, mais sans pour autant confier à ce représentant une mission particulière concernant la lutte contre la désinformation. Tout au plus est-il précisé que « le représentant légal désigné peut être tenu pour responsable du non-respect des obligations prévues par le règlement [sur les services numériques] ».

d) La transparence des algorithmes

Enfin, comme évoqué précédemment, le RSN comporte un article dédié à la transparence du système de recommandation, lequel, sans être aussi exigeant en termes de transparence, recouvre en partie l'article 14 de la loi Infox. L'article 27 du RSN dispose ainsi que « les fournisseurs de plateformes en ligne qui utilisent des systèmes de recommandation établissent dans leurs conditions générales, dans un langage simple et compréhensible, les principaux paramètres utilisés dans leurs systèmes de recommandation, ainsi que les options dont disposent les destinataires du service pour modifier ou influencer ces principaux paramètres ».

L'article 14 de la loi Infox allait cependant plus loin puisqu'il imposait aux opérateurs de plateformes en ligne de publier des statistiques agrégées sur le fonctionnement des algorithmes de recommandation, classement ou référencement de contenus d'information se rattachant à un débat d'intérêt général. Ces statistiques devaient notamment faire apparaître la part d'accès direct, sans recours aux algorithmes de recommandation, classement ou référencement, à ces contenus, ainsi que les parts d'accès indirects imputables, d'une part, à l'algorithme du moteur de recherche interne de la plateforme le cas échéant et, d'autre part, aux autres algorithmes de recommandation, classement ou référencement de la plateforme qui sont intervenus dans l'accès aux contenus.

3. L'indispensable maintien d'un dispositif de signalement des fausses informations

Contrairement à ce qu'énonce l'étude d'impact du projet de loi, le règlement sur les services numériques (RSN) ne couvre pas l'obligation, pour les opérateurs de plateformes en ligne, de mettre en place un dispositif de signalement des fausses informations, présentement imposée par l'article 11 de la loi Infox, puisqu'aussi bien l'Arcom que le Gouvernement ont indiqué au rapporteur que les « contenus illicites » mentionnés à l'article 16 du RSN n'incluent pas les fausses informations (cf. supra).

L'abrogation, non compensée par le RSN, de

l'article 11 de la

loi Infox signifierait un net recul en

matière de lutte contre la désinformation en

ligne.

C'est pourquoi la commission spéciale a adopté l'amendement COM-144, présenté par son rapporteur, afin de conserver, dans le droit national, l'obligation, pour les plateformes en ligne, de mettre en place un dispositif de signalement des fausses informations. Ce faisant, la Commission invite le Gouvernement à défendre auprès des instances européennes « une définition large de la notion de contenu illicite », conformément aux termes du considérant n° 12 du RSN.

La commission spéciale a cependant maintenu l'abrogation des articles 13 et 14 de la loi Infox, ainsi que la suppression des dispositions de l'article 11 relatives aux « mesures complémentaires » que peuvent prendre les plateformes en matière de lutte contre la désinformation, lesquels apparaissent in globo couverts par le RSN.

La commission spéciale a adopté l'article 29 ainsi modifié.

CHAPITRE VI

Mesures d'adaptation du droit

électoral

Article 30

Rehaussement du

seuil de connexions à partir duquel s'appliquent certaines règles

de transparence relatives à la propagande en ligne en période

électorale

L'article 30 tend à modifier l'article L. 163-1 du code électoral, lequel impose aux opérateurs de plateforme en ligne des obligations de transparence renforcée en matière de propagande numérique pendant les périodes électorales. Alors que ces obligations s'appliquent, en l'état actuel du droit, à toutes les plateformes dont le nombre de connexions mensuelles de visiteurs uniques dépasse le seuil national de cinq millions, l'article 30 n'imposerait désormais ces obligations qu'aux seules plateformes dépassant un seuil européen de 45 millions de visiteurs uniques par mois.

La commission spéciale a adopté cet article sans modification, tout en invitant le Gouvernement à veiller à ce que l'adoption future du règlement européen relatif à la transparence et au ciblage de la publicité à caractère politique n'entraîne pas à nouveau un recul par rapport au droit national en matière d'encadrement de la publicité politique en ligne.

1. Afin de veiller à la sincérité des scrutins, les opérateurs de plateformes en ligne sont soumis, depuis la loi Infox de 2018, à des obligations de transparence renforcée en matière de propagande lors des périodes électorales

Bien que de nombreuses règles régissent déjà les abus de propagande électorale162(*) et que le code de la consommation encadre l'usage de la publicité en ligne, en imposant notamment, en son article L. 111-7, à tout opérateur de plateforme en ligne de délivrer au consommateur « une information loyale, claire et transparente » sur « l'existence d'une relation contractuelle, d'un lien capitalistique ou d'une rémunération à son profit, dès lors qu'ils influencent le classement ou le référencement des contenus, des biens ou des services proposés ou mis en ligne » et sur « la qualité de l'annonceur », le législateur a souhaité instaurer des obligations supplémentaires, ne s'appliquant qu'en période électorale. L'objectif mis en avant était d'assurer « l'intérêt général attaché à l'information éclairée des citoyens en période électorale » et de garantir « la sincérité du scrutin »163(*).

Ainsi, la loi du 22 décembre 2018 relative à la lutte contre la manipulation de l'information164(*), dite loi Infox, a inséré un nouvel article L. 163-1 au sein du code électoral, afin de règlementer la promotion de contenus d'information se rattachant à un débat d'intérêt général.

Depuis 2018, les opérateurs de plateformes en ligne dépassant le seuil, défini par décret165(*), de cinq millions de connexions mensuelles de visiteurs uniques, sont donc tenus de fournir « une information loyale, claire et transparente » sur les personnes morales ou physiques « versant à la plateforme des rémunérations en contrepartie de la promotion de contenus d'information se rattachant à un débat d'intérêt général », sur « l'utilisation » qui est faite « des données personnelles » de l'utilisateur « dans le cadre de la promotion d'un contenu d'information se rattachant à un débat d'intérêt général » et, enfin, sur « le montant des rémunérations reçues en contrepartie de la promotion de tels contenus ».

Toutes ces informations sont agrégées en format ouvert au sein d'un « registre » mis à la disposition du public sur un support électronique.

Cet effort de transparence accentuée n'est exigé des opérateurs de plateforme en ligne que lors des trois mois précédant le premier jour du mois d'élections générales et jusqu'à la date du tour de scrutin où celles-ci sont acquises. Ces obligations s'appliquent donc pour les élections législatives, les élections sénatoriales166(*), les élections européennes167(*), les opérations référendaires168(*) et l'élection du Président de la République169(*). A contrario, elles ne sont pas exigibles lors d'élections partielles et pour les scrutins locaux.

Il appert cependant qu'en imposant des obligations de transparence concernant tout « contenu d'information se rattachant à un débat d'intérêt général », l'article L. 163-1 du code électoral a un périmètre d'application plus large que les seules informations de nature à altérer la sincérité d'un scrutin.

En application de l'article L. 112 du code électoral, les personnes ne satisfaisant pas aux règles fixées à l'article L. 163-1 précité encourent une peine d'un an d'emprisonnement et de 75 000 euros d'amende, pouvant être portée au quintuple lorsqu'il s'agit d'une personne morale. Le juge pénal peut, en outre, prononcer l'interdiction, pour une durée de cinq ans au plus, d'exercer directement ou indirectement l'activité professionnelle en lien avec l'infraction. Le juge peut également ordonner l'affichage de la décision de justice ou la diffusion de celle-ci soit par la presse écrite, soit par tout moyen de communication au public par voie électronique.

2. L'article 30 du projet de loi rehausse significativement le seuil de connexions à partir duquel s'appliqueraient les obligations de transparence renforcée en matière de propagande électorale en ligne

a) L'article 30 du projet de loi vise à adapter le code électoral au RSN

Tel que déposé au Sénat, l'article 30 du projet de loi apporte deux modifications principales à l'article L. 163-1 du code électoral :

- il restreint le nombre de plateformes concernées par les obligations de transparence précitées, en remplaçant la référence aux opérateurs de plateforme en ligne mentionnés à l'article L. 111-7 du code de la consommation par une référence aux « très grandes plateformes en ligne et les très grands moteurs de recherches en ligne » définis à l'article 33 du règlement européen sur les services numériques (RSN). Le seuil à partir duquel les plateformes appartiennent à cette catégorie a été fixé à 45 millions d'utilisateurs européens par mois, soit 10 % de la population européenne, contre, pour mémoire, cinq millions de connexions mensuelles uniques en l'état actuel du droit interne. La Commission européenne n'a, pour l'instant, désigné que 17 plateformes catégorisées comme « très grandes », à savoir Alibaba AliExpress, Amazon Store, Apple AppStore, Booking.com, Facebook, Google Play, Google Maps, Google Shopping, Instagram, LinkedIn, Pinterest, Snapchat, TikTok, Twitter, Wikipedia, YouTube et Zalando, et deux « très grands » moteurs de recherche, à savoir Bing et Google Search. À titre d'exemple, parmi les opérateurs soumis, en droit actuel, aux obligations de transparence issues de l'article L. 163-1 du code électoral, Twitch, Yahoo Search et Dailymotion en seraient exemptés du fait de ce rehaussement du seuil d'application ;

- il remplace l'actuel registre recensant les données relatives à la propagande numérique par un registre, issu de l'article 39 du RSN, qui concerne de façon plus large la publicité en ligne (cf. infra).

Ces deux modifications sont présentées par le Gouvernement comme une nécessaire adaptation au règlement sur les services numériques170(*).