- L'ESSENTIEL

- I. UN ESPACE NUMÉRIQUE À

RÉGULER

- II. REHAUSSER NOTRE NIVEAU DE PROTECTION COLLECTIVE

DANS L'ESPACE NUMÉRIQUE

- III. CRÉER LES CONDITIONS DE NOTRE

SOUVERAINETÉ NUMÉRIQUE

- IV. ADAPTER NOTRE DROIT NATIONAL AUX

RÈGLEMENTS EUROPÉENS

- A. ADAPTER NOTRE DROIT AU RÈGLEMENT SUR LES

SERVICES NUMÉRIQUES (RSN)

- B. ADAPTER NOTRE DROIT AU RÈGLEMENT SUR LES

MARCHÉS NUMÉRIQUES (RMN)

- C. ADAPTER NOTRE DROIT AU RÈGLEMENT SUR LA

GOUVERNANCE DES DONNÉES (DGA)

- D. ADAPTER NOTRE DROIT AU RÈGLEMENT

GÉNÉRAL SUR LA PROTECTION DES DONNÉES

- E. ADAPTER NOTRE DROIT AU FUTUR RÈGLEMENT

SUR L'ACCÈS ET L'ÉQUITÉ DES DONNÉES

- A. ADAPTER NOTRE DROIT AU RÈGLEMENT SUR LES

SERVICES NUMÉRIQUES (RSN)

- V. LES APPORTS DE LA COMMISSION POUR MIEUX

SÉCURISER ET RÉGULER L'ESPACE NUMÉRIQUE

- A. ASSURER LA PROTECTION DES PLUS

VULNÉRABLES

- B. PROTÉGER LES CITOYENS FACE AUX CAMPAGNES

DE DÉSINFORMATION ET DE DÉSTABILISATION

- C. ASSURER LA PROTECTION DE TOUS LES INTERNAUTES

FACE AUX ACTES QUOTIDIENS DE CYBERMALVEILLANCE

- D. RÉÉQUILIBRER LE MARCHÉ

EUROPÉEN DE L'INFORMATIQUE EN NUAGE

- E. SOUTENIR L'INNOVATION AFIN DE POSITIONNER NOS

ENTREPRISES COMME ACTEURS DES NOUVEAUX MARCHÉS ET D'EN LIMITER LES

RISQUES

- F. ADAPTER NOTRE DROIT NATIONAL AUX

RÈGLEMENTS EUROPÉENS

- G. POUR UNE MISE EN ADÉQUATION DES MOYENS

BUDGÉTAIRES AUX MISSIONS

- A. ASSURER LA PROTECTION DES PLUS

VULNÉRABLES

- I. UN ESPACE NUMÉRIQUE À

RÉGULER

- INTRODUCTION

- I. PREMIER AXE : LA PROTECTION DES CITOYENS

ET DES MINEURS

- II. DEUXIÈME AXE : LA

SOUVERAINETÉ ÉCONOMIQUE ET NUMÉRIQUE

EUROPÉENNE

- III. TROISIÈME AXE : DES

RÈGLEMENTS EUROPÉENS QUI PORTENT LA MARQUE DES TRAVAUX DU

SÉNAT

- I. PREMIER AXE : LA PROTECTION DES CITOYENS

ET DES MINEURS

- EXAMEN DES ARTICLES

- TITRE IER

PROTECTION EN LIGNE DES MINEURS

- Section 1

Renforcement des pouvoirs de l'Autorité de régulation de la communication audiovisuelle et numérique en matière de protection en ligne des mineurs

- Section 2

Pénalisation du défaut d'exécution en vingt-quatre heures d'une demande de l'autorité administrative de retrait de contenu pédopornographique

- Section 1

- TITRE II

PROTECTION DES CITOYENS DANS L'ENVIRONNEMENT NUMÉRIQUE

- Article 4

Protection des citoyens contre les vecteurs de propagande étrangère manifestement destinés à la désinformation et à l'ingérence

- Article 5

Création d'une peine complémentaire de blocage d'un compte d'accès aux plateformes en ligne

- Article 6

Déploiement d'un filtre national de cybersécurité grand public

- Article 4

- TITRE III

RENFORCER LA CONFIANCE ET LA CONCURRENCE DANS L'ÉCONOMIE DE LA DONNÉE

- CHAPITRE IER

Pratiques commerciales déloyales entre entreprises sur le marché de l'informatique en nuage

- Article 7

Encadrement des frais de transfert et des crédits d'informatique en nuage

- CHAPITRE II

Interopérabilité des services d'informatique en nuage

- Article 8

Obligations d'interopérabilité et de portabilité à la charge des services d'informatique en nuage

- Article 9

Obligations d'interopérabilité et de portabilité à la charge des services d'informatique en nuage

- Article 10

Contrôle des obligations des fournisseurs de services d'informatique en nuage par l'Autorité de régulation des communications électroniques, des postes et de la distribution de la presse

- CHAPITRE II BIS

Transparence sur le marché de l'informatique en nuage

(Division nouvelle)

- Article 10 bis (nouveau)

Obligations de transparence sur le marché de l'informatique en nuage

- CHAPITRE III

Régulation des services d'intermédiation de données

- Article 11

Désignation de l'Arcep comme autorité compétente en matière de régulation des services d'intermédiation de données

- Article 12

Champ de compétences et pouvoirs de l'Arcep en matière de régulation des services d'intermédiation de données

- Article 13

Articulation des compétences de l'Arcep et de la Cnil, s'agissant des données à caractère personnel, dans le cadre de la régulation par l'Arcep des services d'intermédiation de données

- Article 14

Coordinations juridiques au sein du code des postes et des communications électroniques

- CHAPITRE IER

- TITRE IV

ASSURER LE DÉVELOPPEMENT EN FRANCE DE L'ÉCONOMIE DES JEUX NUMÉRIQUES MONÉTISABLES DANS UN CADRE PROTECTEUR

- TITRE V

PERMETTRE À L'ÉTAT D'ANALYSER PLUS EFFICACEMENT L'ÉVOLUTION DES MARCHÉS NUMÉRIQUES

- Article 16

Élargissement des pouvoirs de collecte des données par le Pôle d'expertise de la régulation du numérique pour des activités de recherche publique

- Article 17

Dispositif de centralisation des données devant être transmises aux communes par les opérateurs de plateformes numériques en matière de location de meublés de tourisme

- Article 16

- TITRE VI

RENFORCER LA GOUVERNANCE DE LA RÉGULATION DU NUMÉRIQUE

- TITRE VII

CONTRÔLE DES OPÉRATIONS DE TRAITEMENT DE DONNÉES À CARACTÈRE PERSONNEL EFFECTUÉES PAR LES JURIDICTIONS DANS L'EXERCICE DE LEUR FONCTION JURIDICTIONNELLE

- TITRE VIII

ADAPTATIONS DU DROIT NATIONAL

- CHAPITRE IER

Mesures d'adaptation de la loi n° 2004-575 du 21 juin 2004 pour la confiance dans l'économie numérique

- Article 22

Adaptations de la loi pour la confiance dans l'économie numérique

- Article 23

Adaptations relatives à la lutte contre les contenus terroristes et pédopornographiques

- Article 24

Adaptations au RSN de la loi du 21 juin 2004 pour la confiance dans l'économie numérique

- Article 25

Adaptations de la loi pour la confiance dans l'économie numérique

- CHAPITRE II

Modification du code de la consommation

- Article 26

Adaptation du code de la consommation en cohérence avec la mise en oeuvre du règlement sur les services numériques

- CHAPITRE III

Modification du code de commerce

- Article 27

Adaptation du code de commerce au règlement

sur les marchés numériques

- CHAPITRE IV

Mesures d'adaptation de la loi n° 86-1067 du 30 septembre 1986 relative à la liberté de communication

- Article 28

Adaptations au RSN de la loi n° 86-1087 du 30 septembre 1986 sur la liberté de communication

- CHAPITRE V

Mesures d'adaptation de la loi relative à la lutte contre la manipulation de l'information

- Article 29

Abrogation de trois articles de la loi du 22 décembre 2018 relative à la lutte contre la manipulation de l'information (loi Infox)

- CHAPITRE VI

Mesures d'adaptation du droit électoral

- Article 30

Rehaussement du seuil de connexions à partir duquel s'appliquent certaines règles de transparence relatives à la propagande en ligne en période électorale

- CHAPITRE VII

Mesures d'adaptation de la loi n° 78-17 du 6 janvier 1978 relative à l'informatique, aux fichiers et aux libertés

- Article 31

Adaptations de la loi n° 78-17 « Informatique et libertés » au règlement européen sur la gouvernance des données (Data Governance Act - altruisme en matière de données)

- Article 32

Adaptations de la loi n° 78-17 « Informatique et libertés » au règlement européen sur les services numériques

- CHAPITRE VIII

Mesures d'adaptation de la loi n° 47-585 du 2 avril 1947 relative au statut des entreprises du groupage et de distribution des journaux et publications périodiques

- Article 33

Mesures d'adaptation de la loi n° 47-585 du 2 avril 1947 relative au statut des entreprises de groupage et de distribution de journaux et publications périodiques

- CHAPITRE IX

Mesures d'adaptation de la loi n° 2017-261 du 1er mars 2017 visant à préserver l'éthique du sport, du code de la propriété intellectuelle, de la loi n° 2021-1382 du 25 octobre 2021 relative à la régulation et à la protection de l'accès aux oeuvres culturelles et du code pénal

- Article 34

Mesures d'adaptation de la loi n° 2017-261 du 1er mars 2017 visant à préserver l'éthique du sport, du code de la propriété intellectuelle, de la loi n° 2021-1382 du 25 octobre 2021 relative à la régulation et à la protection de l'accès aux oeuvres culturelles et du code pénal

- CHAPITRE X

Dispositions transitoires et finales

- Article 35

Habilitation à légiférer par ordonnance pour l'application dans les territoires ultramarins du projet de loi et de plusieurs règlements européens

- Article 36

Dispositions d'entrée en vigueur

- CHAPITRE IER

- EXAMEN EN COMMISSION

- RÈGLES RELATIVES À L'APPLICATION DE

L'ARTICLE 45

DE LA CONSTITUTION ET DE L'ARTICLE 44 BIS

DU RÈGLEMENT DU SÉNAT (« CAVALIERS »)

- COMPTES RENDUS DES AUDITIONS

PLÉNIÈRES

- Réunion constitutive

- Audition de Cécile Augeraud, commissaire

divisionnaire, chef de l'Office central de lutte contre la

criminalité liée aux technologies de l'information et de la

communication (OCLCTIC), Pierre-Yves Lebeau, chef de l'état-major de

la sous-direction de lutte contre la cybercriminalité (SDLC) et

Clara Timsit, conseillère juridique rattachée à

l'état-major de la SDLC

- Audition de Jean-Noël Barrot,

ministre délégué auprès du ministre de l'économie, des finances et de la souveraineté industrielle et numérique, chargé de la transition numérique et des télécommunications

- Table ronde des régulateurs

- Audition de Lucas Verney,

directeur adjoint du Pôle d'expertise de la régulation numérique (PEReN)

- Table ronde des sociétés

d'informatique en nuage (clouders) européennes

- Table ronde des opérateurs du

numérique

- Audition de

Jean-Philippe Lecouffe,

directeur exécutif adjoint des opérations d'Europol

- Table ronde sur la protection de l'enfance

- Réunion constitutive

- LISTE DES PERSONNES ENTENDUES

- LISTE DES CONTRIBUTIONS ÉCRITES

- LA LOI EN CONSTRUCTION

N° 777

SÉNAT

SESSION ORDINAIRE DE 2022-2023

Enregistré à la Présidence du Sénat le 27 juin 2023

RAPPORT

FAIT

au nom de la commission spéciale (1) sur le projet de loi visant à sécuriser et réguler l'espace numérique (procédure accélérée),

Par MM. Patrick CHAIZE et Loïc HERVÉ,

Sénateurs

(1) Cette commission est composée de : Mme Catherine Morin-Desailly, présidente ; Mmes Florence Blatrix Contat, Alexandra Borchio Fontimp, Toine Bourrat, MM. Thomas Dossus, Bernard Fialaire, Xavier Iacovelli, Mmes Micheline Jacques, Marie Mercier, M. Pierre Ouzoulias, Mme Sylvie Robert, M. Pierre-Jean Verzelen, vice-présidents ; Mme Nadine Bellurot, M. Jérôme Durain, Mme Anne-Catherine Loisier, secrétaires ; MM. Jean-Michel Arnaud, Julien Bargeton, Mme Annick Billon, MM. Jean-Marc Boyer, Rémi Cardon, Patrick Chaize, Mmes Nathalie Delattre, Patricia Demas, M. Rémi Féraud, Mme Pascale Gruny, MM. Ludovic Haye, Loïc Hervé, Pierre-Antoine Levi, Mmes Marie-Noëlle Lienemann, Laurence Muller-Bronn, Sylviane Noël, MM. Cyril Pellevat, Christian Redon-Sarrazy, André Reichardt, Mmes Laurence Rossignol, Elsa Schalck, M. Laurent Somon.

Voir les numéros :

|

Sénat : |

593 et 778 (2022-2023) |

L'ESSENTIEL

Le Sénat a choisi de constituer une

commission spéciale, rassemblant des membres de toutes ses commissions

permanentes, afin d'examiner le projet

de loi visant à

sécuriser et réguler l'espace numérique.

Présidée par Catherine Morin-Desailly, la commission a

désigné Patrick Chaize et Loïc Hervé

rapporteurs.

L'ampleur du texte et la variété des thèmes qui y sont abordés ont motivé le recours à cette procédure. Dans des délais rendus extrêmement contraints par un calendrier d'examen accéléré, la commission spéciale a organisé huit réunions plénières, complétées par 21 auditions des rapporteurs et reçu de très nombreuses contributions écrites.

Lors de sa réunion du 27 juin, la commission a adopté le projet de loi, modifié par 80 amendements permettant de prendre en compte les préoccupations déjà exprimées par les différentes instances du Sénat, qui mènent depuis des années un travail en profondeur sur les différents aspects d'un espace numérique qui, aussi risqué que source d'opportunités, nécessite une véritable régulation ambitieuse et adaptée.

I. UN ESPACE NUMÉRIQUE À RÉGULER

En vingt ans, l'Internet, le réseau des réseaux, s'est rapidement éloigné de la promesse initiale d'un espace ouvert, synonyme de progrès, de développement et de partage illimité de la connaissance.

A. UNE MEILLEURE RÉGULATION POUR FAIRE FACE À LA MULTIPLICATION DES CONTENUS ILLICITES ET PRÉJUDICIABLES

Alors que l'Internet reposait à ses origines sur des standards ouverts, les utilisateurs se sont progressivement retrouvés enfermés dans des écosystèmes « propriétaires » et des « bulles informationnelles » reposant sur des algorithmes complexes. L'Internet est devenu un espace non sécurisé pour nos concitoyens, un monde d'hyper-surveillance et de vulnérabilité, avec en particulier :

- un accès illimité et sans contrôle réel à des contenus préjudiciables pour les mineurs, notamment la pornographie ;

- le développement en ligne de toutes les formes de criminalités, allant du cyberharcèlement à la pédocriminalité en passant par toutes formes d'escroqueries et d'abus, avec des conséquences parfois dramatiques ;

- la diffusion d'informations fausses ou présentées hors de leur contexte, sans aucune hiérarchisation, des tentatives de manipulation des opinions, voire des scrutins électoraux, à travers des campagnes d'ingérence et de déstabilisation, parfois menées depuis l'étranger, comme l'a révélé en 2016 l'affaire « Cambridge Analytica ».

B. UNE MEILLEURE RÉGULATION CONCURRENTIELLE POUR FAIRE FACE À LA DOMINATION SANS PARTAGE DE QUELQUES GRANDS ACTEURS ÉTRANGERS

À la faveur des innovations technologiques, l'économie numérique s'est développée autour de nouveaux usages pour les utilisateurs, particuliers, administrations comme entreprises : accès à l'information, et à de nouveaux formats de divertissements, accroissement des échanges, réactivité, etc.

Cependant, si l'Europe s'est dotée dès 2000 d'un cadre réglementaire, ce dernier a essentiellement profité aux usages, sans considération pour sa position comme acteur du monde numérique et non plus simplement comme consommateur. En conséquence, force est aujourd'hui de constater que quelques grandes entreprises extérieures à l'Union européenne, principalement les « BigTech », dont la richesse et l'influence concurrencent désormais directement les États, en ont été les principales bénéficiaires. Elles ont profité des caractéristiques économiques du monde numérique, qui démultiplie les effets de réseaux, pour imposer leurs standards et leurs modèles économiques, déstabilisant les modèles d'affaires de secteurs entiers de notre économie et le fonctionnement de pans entiers de notre société. Aujourd'hui, on peut parler de quasi monopole. Les phénomènes de verrouillage et de dépendance sont si importants qu'il est impératif de faire évoluer la législation vers de vraies règles de concurrence, afin de redonner une autonomie stratégique aux européens.

La crise sanitaire et la crise ukrainienne ont révélé ces fragilités structurelles, ce qui a permis à la Commission européenne, avec l'impulsion décisive de la Présidence française de l'Union européenne (PFUE), de faire adopter un cadre réglementaire inédit et plus protecteur auquel les grands acteurs du numérique devront bientôt se conformer et les États membres s'adapter.

II. REHAUSSER NOTRE NIVEAU DE PROTECTION COLLECTIVE DANS L'ESPACE NUMÉRIQUE

A. ASSURER LA PROTECTION DES PUBLICS LES PLUS VULNÉRABLES

· Protéger les mineurs de l'exposition précoce aux contenus pornographiques

Conscient des ravages de l'exposition précoce des enfants aux images pornographiques, le Sénat a voté dans le cadre de la discussion de la loi du 30 juillet 2020 visant à protéger les victimes de violences conjugales, à l'initiative de Marie Mercier, rapporteure, une procédure judiciaire de blocage des sites ne respectant pas les restrictions d'accès aux mineurs, sur le modèle de la procédure existante en matière de sites illicites de jeux d'argent1(*).

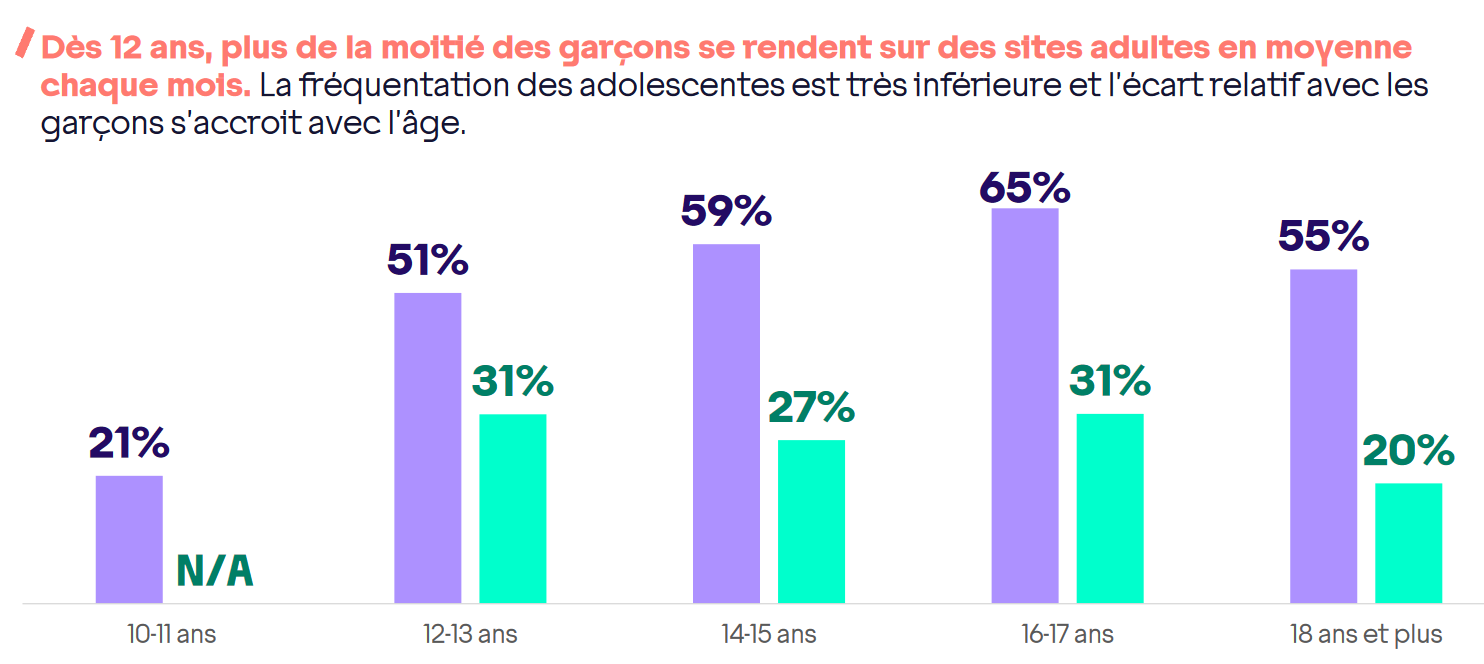

2,3 millions de mineurs visitent chaque mois un site « adulte », et ce dès 12 ans pour plus de la moitié des garçons2(*).

Faisant le constat des lenteurs et difficultés de la procédure judiciaire de blocage et de déréférencement des sites pornographiques accessibles sans restriction aux mineurs, le Gouvernement a souhaité changer de méthode.

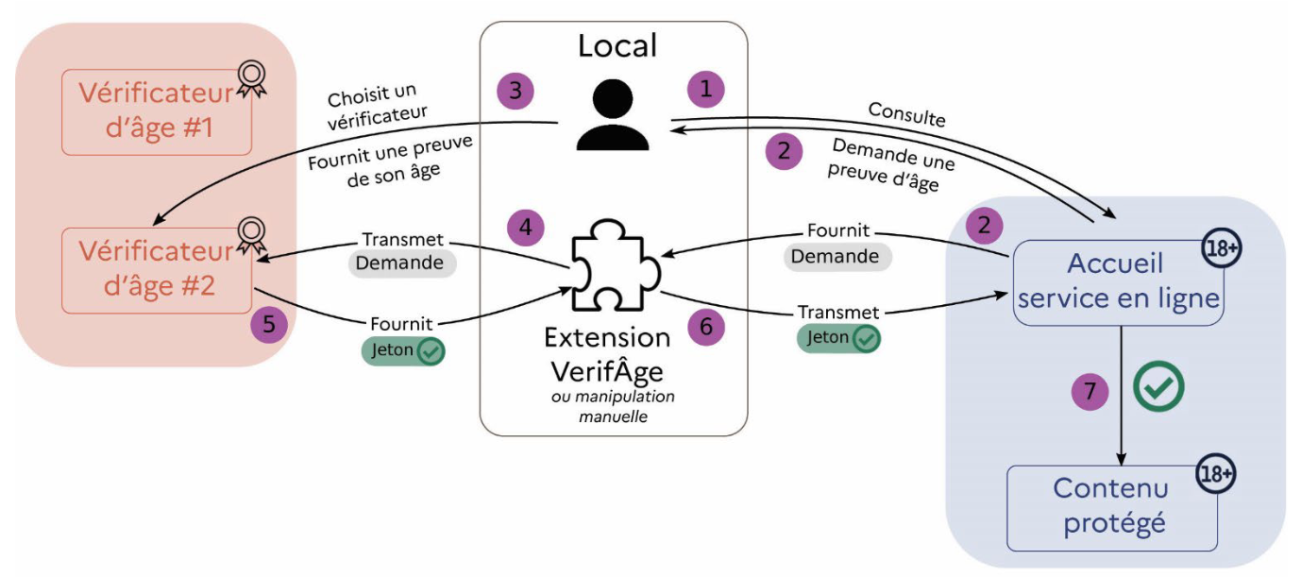

L'article 1er du projet de loi tend à confier à l'Autorité de régulation de la communication audiovisuelle et numérique (Arcom) la compétence d'élaborer un référentiel général déterminant les exigences techniques auxquelles devraient répondre les systèmes de vérification d'âge tout en respectant la vie privée des utilisateurs. Pour rendre ce référentiel contraignant, l'Arcom disposerait d'un pouvoir de mise en demeure et de sanction pécuniaire à l'encontre des éditeurs de sites pornographiques ne se conformant pas à celui-ci. L'article 2 transformerait la procédure judiciaire de blocage et de déréférencement des sites ne respectant pas la restriction d'accès aux mineurs en procédure administrative, confiée également à l'Arcom et sous le contrôle a posteriori du juge administratif, après une phase contradictoire préalable auprès de l'éditeur.

Enfin, l'article 3 vise à compléter le dispositif de lutte contre les contenus pédopornographiques en créant une sanction pénale applicable aux hébergeurs qui ne satisferaient pas à la demande émise par l'Office central de lutte contre la criminalité liée aux technologies de l'information et de la communication (OCLCTIC) de procéder au retrait en vingt-quatre heures d'un contenu. Il serait ainsi aligné sur les dispositions déjà applicables en matière de contenus terroristes3(*).

· Protéger les citoyens face aux campagnes de désinformation et de déstabilisation

Le projet de loi vise à mieux protéger les citoyens contre les contenus diffusés en ligne qui contribuent à la propagation de fausses informations en provenance d'États soumis à des sanctions internationales. Il prévoit ainsi à l'article 4 l'extension des possibilités de bloquer la diffusion sur l'Internet des contenus produits par des médias visés par des sanctions européennes, à l'instar de Russia Today ou de Sputnik.

· Protéger les internautes face aux infractions les plus graves

Le projet de loi prévoit également, dans son article 5, la création d'une peine complémentaire de « bannissement » se traduisant, à l'occasion d'une condamnation pénale pour certains délits (pédopornographie, proxénétisme, négationnisme, apologie du terrorisme, harcèlement sexuel, sur conjoint ou scolaire...), par l'obligation faite aux fournisseurs de plateforme en ligne de bloquer le compte ayant servi à commettre l'infraction. Le texte vise également à leur imposer de prendre des mesures visant à bloquer les autres comptes détenus par une personne condamnée, qu'ils soient préexistants ou nouvellement créés pour échapper aux conséquences de la peine.

B. ASSURER LA PROTECTION DE TOUS LES INTERNAUTES FACE AUX ACTES QUOTIDIENS DE CYBERMALVEILLANCE

· Constater la hausse des actes quotidiens de cybermalveillance

Les tentatives d'arnaques et d'escroquerie en ligne ne cessent de se multiplier et font désormais partie de notre quotidien, prenant différentes formes (piratage de comptes en ligne, hameçonnage, arnaques aux faux supports techniques et à la livraison de colis, faux ordres de virement, attaques par rançongiciel, spams électroniques et téléphoniques, etc.).

· Créer un nouveau dispositif national de filtrage dédié à la cybermalveillance

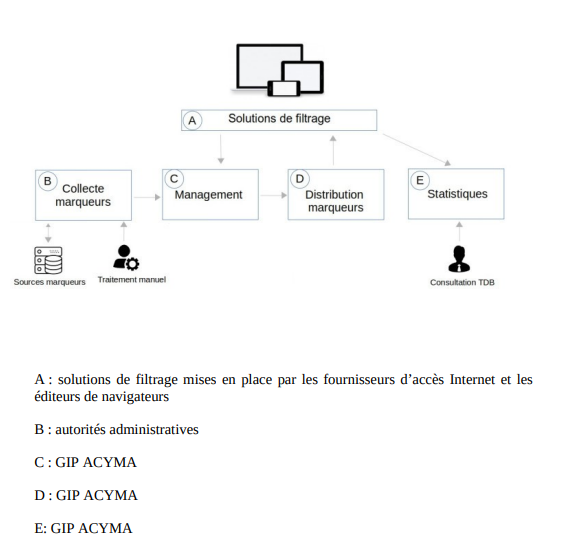

Partant du constat que les actes de cybermalveillance sont en hausse et qu'il n'existe pas en France de dispositif national de filtrage des contenus sur l'Internet permettant de prévenir ces actes, l'article 6 du projet de loi prévoit la création d'un « filtre national grand public de cybersécurité ».

Les autorités administratives compétentes pour constater les infractions correspondant à ces actes (usurpation d'identité, usage frauduleux d'un moyen de paiement, collecte frauduleuse de données à caractère personnel, etc.) pourront d'abord ordonner l'affichage d'un message d'avertissement à destination des internautes qui se connectent à des sites frauduleux, puis ordonner le blocage de ces sites, dans un souci de meilleure protection de notre vie en ligne, sous la vigilance et le contrôle de la Commission nationale de l'informatique et des libertés (Cnil).

III. CRÉER LES CONDITIONS DE NOTRE SOUVERAINETÉ NUMÉRIQUE

A. RÉÉQUILIBRER LE MARCHÉ EUROPÉEN DE L'INFORMATIQUE EN NUAGE

· Constater la hausse des pratiques anticoncurrentielles sur ce marché

Pilier de l'économie de la donnée, l'informatique en nuage est aujourd'hui en forte croissance et représentait en 2021, selon l'étude d'impact du projet de loi, un marché de 65 milliards d'euros en Europe et de 16 milliards d'euros en France qui pourrait atteindre, à l'échelle mondiale, jusqu'à plus de 1 200 milliards d'euros d'ici 2025.

Or, ce secteur est également fortement concentré autour de trois acteurs (AWS, Azure-Microsoft et Google Cloud Platform), qui captent environ 70 % des parts de ce marché en France comme dans le monde. Un tel niveau de concentration pénalise les fournisseurs français et européens qui dénoncent, depuis plusieurs années déjà, des abus de position dominante, des pratiques anticoncurrentielles « d'enfermement propriétaire », de « verrouillage » et qui rendent le marché de moins en moins contestable et interopérable, telle que la « vente liée d'infrastructures et de logiciels ».

65 % des start-up françaises affirment être dépendantes des GAFAM tandis que 73 % d'entre elles utilisent au moins un de leurs services4(*).

C'est la raison pour laquelle le Data Act prévoit de rendre possible la portabilité des données et les systèmes interopérables.

· Encadrer la facturation abusive de frais de transfert de données et l'octroi de crédits

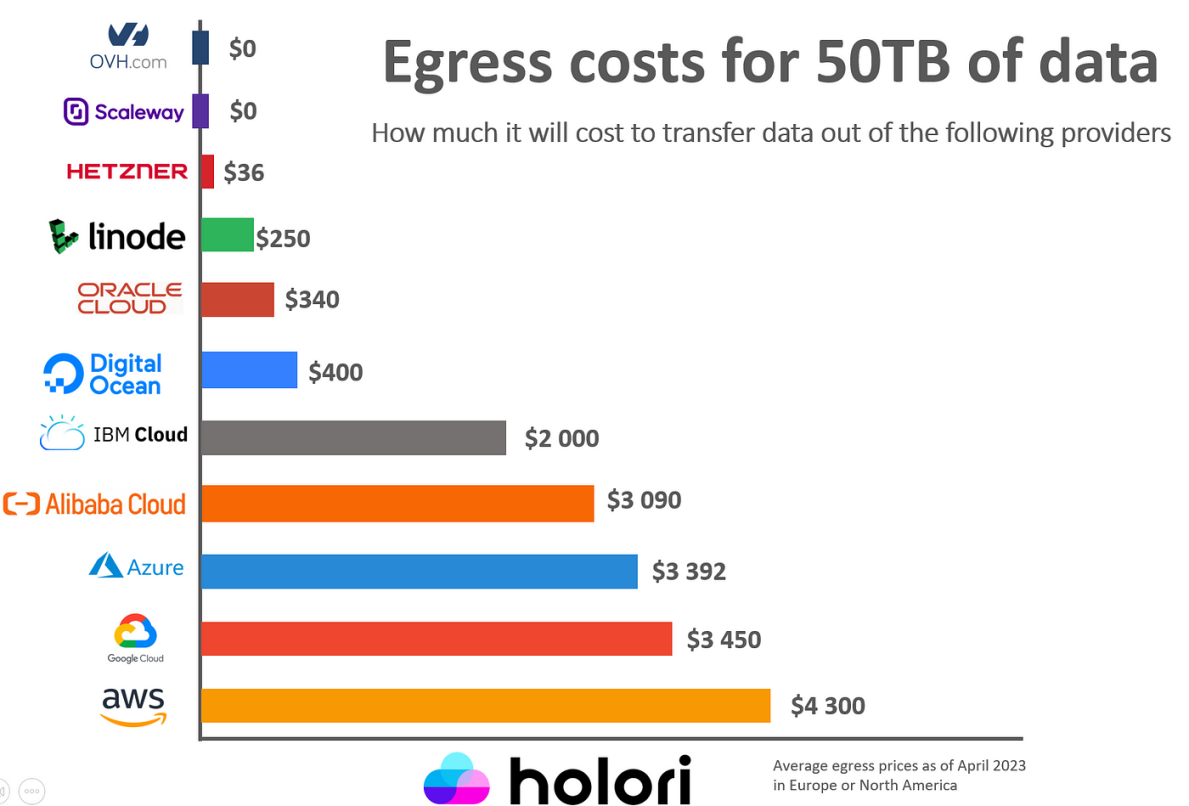

La facturation de frais de transfert sortant de données (« egress fees ») est aujourd'hui particulièrement contestée. Considérés comme « artificiels », ces frais, surtout appliqués par les acteurs dominants (hyperscalers), peuvent parfois représenter jusqu'à 80 fois le coût réel du transfert de données et s'élever à plusieurs centaines de milliers d'euros5(*).

Le Data Act prévoit la suppression de ces frais, ainsi que celle, progressive, des frais de changement de fournisseur, mais ne prévoit pas d'encadrement spécifique des avoirs d'informatique en nuage, au contraire de l'article 7 de ce projet de loi. Il s'agit d'une initiative française bienvenue car, comme le souligne l'Autorité de la concurrence6(*), la facturation abusive des frais de transfert de données permet de compenser l'octroi, à titre gratuit, d'avoirs d'informatique en nuage. Autrement dit, « l'entrée du marché » est gratuite, mais il y a un « péage à la sortie ».

B. SOUTENIR L'INNOVATION AFIN DE POSITIONNER NOS ENTREPRISES COMME PREMIERS ACTEURS DES NOUVEAUX MARCHÉS ET D'EN ENCADRER LES RISQUES

· Définir et autoriser de façon expérimentale les jeux à objets numériques monétisables

Les jeux à objets numériques monétisables (Jonum) sont un nouveau type de jeux en ligne, à la croisée entre les jeux d'argent et de hasard et les jeux vidéo. Aujourd'hui en pleine croissance, l'Autorité nationale des jeux estimant qu'entre 1 200 et 2 500 jeux sont en phase de développement dont une quinzaine en France, ils échappent aujourd'hui à tout cadre de régulation, la législation existante sur les jeux n'étant pas adaptée à leurs spécificités.

Pourtant, ces jeux présentent également des risques de jeu pathologique et addictif, en particulier auprès des mineurs et des personnes les plus vulnérables, ainsi que des risques de blanchiment d'argent, de financement du terrorisme, de détournement de l'interdiction actuelle des casinos en ligne ou de concurrence avec le marché physique des jeux.

La commission spéciale estime indispensable de supprimer le recours à une habilitation à légiférer par ordonnance, prévue à l'article 15 de ce projet de loi, afin de pouvoir proposer une première définition en droit des Jonum et une expérimentation relative à leur autorisation, dans la perspective de l'adoption d'une nouvelle législation dédiée et adaptée à leurs spécificités, distincte de celle des jeux d'argent et de hasard et de celle des jeux vidéo. Cette expérimentation, comme la future législation, ne sauraient déstabiliser les acteurs déjà en place.

· Anticiper le développement du marché de l'intermédiation des données

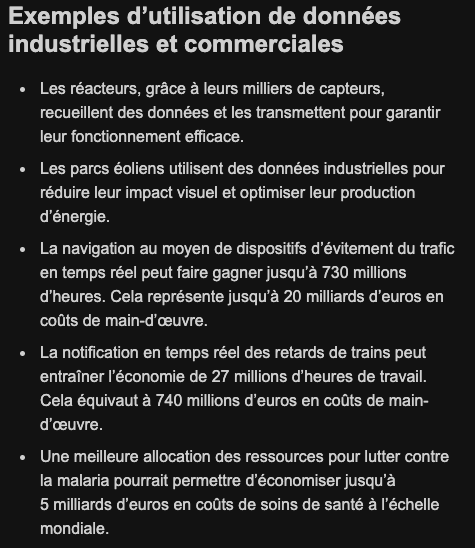

Le règlement européen sur la gouvernance des données (Data Governance Act) crée en même temps qu'il encadre un nouvel acteur de l'économie numérique, les prestataires de services d'intermédiation de données (SID). Ces services doivent permettre de favoriser l'échange de données, notamment industrielles et commerciales, de façon plus transparente et plus concurrentielle entre acteurs économiques, administrations et particuliers, grâce à la séparation de l'échange, de la collecte et du traitement des données.

L'Union européenne anticipe une augmentation de 530 % du volume mondial des données en sept ans. Les applications de ce nouveau marché sont donc prometteuses, notamment dans le domaine de l'intelligence artificielle.

IV. ADAPTER NOTRE DROIT NATIONAL AUX RÈGLEMENTS EUROPÉENS

A. ADAPTER NOTRE DROIT AU RÈGLEMENT SUR LES SERVICES NUMÉRIQUES (RSN)

La Direction générale de la concurrence, de la consommation et de la répression des fraudes (DGCCRF) est désignée comme l'autorité chargée de contrôler le respect de l'ensemble des obligations des fournisseurs de places de marché en ligne, notamment en termes de traçabilité des professionnels, de conformité des interfaces dès leur conception, de droit d'information des consommateurs et d'interdiction d'utiliser des interfaces conçues de façon à tromper, manipuler ou entraver la capacité des consommateurs à prendre des décisions libres et éclairées.

La compétence de la Cnil serait affirmée pour la vérification du bon respect, par les plateformes en ligne, des obligations posées par le RSN en matière de limitation de l'utilisation des données personnelles pour le profilage publicitaire, une telle pratique étant complètement proscrite pour les publicités qui touchent les mineurs.

B. ADAPTER NOTRE DROIT AU RÈGLEMENT SUR LES MARCHÉS NUMÉRIQUES (RMN)

L'Autorité de la concurrence et le ministère de l'économie se voient reconnaître le pouvoir de conduire des investigations, de recevoir des renseignements et de coopérer avec la Commission européenne sur les pratiques des contrôleurs d'accès, dans le cadre du « Réseau européen de concurrence ». Conjointement avec trois États membres, le ministre de l'économie peut enfin demander l'ouverture d'une enquête de marché en cas de soupçon d'éventuel « contrôleur d'accès ».

C. ADAPTER NOTRE DROIT AU RÈGLEMENT SUR LA GOUVERNANCE DES DONNÉES (DGA)

La mise en oeuvre du règlement européen sur la gouvernance des données repose sur deux piliers : la reconnaissance, d'une part, de la compétence de l'Arcep pour réguler le nouveau marché d'intermédiation des données et, d'autre part, des prérogatives de la Cnil sur l'altruisme en matière de données.

La désignation d'une autorité avant le 24 septembre 2023 pour réguler les services d'intermédiation de données (SID) répond à une obligation européenne, que ce projet de loi traduit tardivement. L'Arcep disposera dans ses nouvelles missions de pouvoirs de sanction et d'enquête étendus. La Cnil sera compétente pour gérer le nouveau « registre des organisations altruistes en matière de données » et pour veiller au respect, par les organisations reconnues, des critères posés par le DGA.

D. ADAPTER NOTRE DROIT AU RÈGLEMENT GÉNÉRAL SUR LA PROTECTION DES DONNÉES

Si le règlement général sur la protection des données (RGPD) exclut de la compétence de la Cnil le contrôle des opérations de traitement des données à caractère personnel effectuées par les juridictions et leurs ministères publics dans l'exercice de leurs fonctions juridictionnelles, ces opérations doivent cependant faire l'objet d'un contrôle qui garantisse à la fois l'indépendance de l'autorité judiciaire et la protection des données personnelles des justiciables.

C'est pourquoi il est créé, au sein du Conseil d'État, de la Cour de cassation et de la Cour des comptes, une autorité de contrôle de ces opérations de traitement des données à caractère personnel, respectivement compétente pour les juridictions administratives, judiciaires et financières.

E. ADAPTER NOTRE DROIT AU FUTUR RÈGLEMENT SUR L'ACCÈS ET L'ÉQUITÉ DES DONNÉES

La proposition de règlement européen sur les données (Data Act), toujours en cours de négociation à l'échelle européenne, a pour but de garantir l'équité dans la répartition de la valeur produite par les données entre les acteurs de l'économie fondée sur les données ainsi que de favoriser leur accès et leur utilisation. C'est une condition préalable essentielle à la concrétisation des possibilités offertes par l'ère numérique dans laquelle nous vivons.

Les articles 7 à 10 de ce projet de loi anticipent la mise en oeuvre de cette proposition de règlement. L'Arcep est notamment désignée comme « gendarme du cloud », c'est-à-dire comme autorité compétente chargée de contrôler l'encadrement des avoirs d'informatique en nuage, la suppression progressive des frais de transfert de données et les litiges entre opérateurs ainsi que d'édicter les règles techniques d'interopérabilité, de portabilité et d'équivalence fonctionnelle qui s'appliqueront aux fournisseurs de service d'informatique en nuage.

V. LES APPORTS DE LA COMMISSION POUR MIEUX SÉCURISER ET RÉGULER L'ESPACE NUMÉRIQUE

A. ASSURER LA PROTECTION DES PLUS VULNÉRABLES

Favorable au principe d'une procédure administrative confiée à l'Arcom pour essayer d'accélérer et de massifier la lutte contre les sites pornographiques qui refusent d'instaurer un contrôle d'âge pour empêcher l'accès des mineurs à leurs contenus, la commission a souhaité renforcer la solidité juridique du dispositif en ne créant qu'une unique procédure de mise en demeure et de sanction vis-à-vis de l'éditeur. Elle a distingué les dispositions relatives au référentiel de celles relatives aux sanctions.

À l'article 5, la commission spéciale a estimé nécessaire d'aller plus loin que le dispositif proposé par le Gouvernement pour faire du bannissement une sanction réellement efficace.

Elle a ainsi étendu substantiellement la liste des délits pour lesquels cette peine complémentaire sera encourue, pour y intégrer notamment les délits « voisins » à la pédocriminalité mais aussi, dans une période marquée par la montée en puissance des violences contre les élus, dont témoigne dramatiquement l'actualité récente, les menaces et intimidations à l'encontre des dépositaires d'une fonction publique.

Elle a également fait de cette sanction une obligation susceptible d'être imposée dans le cadre des alternatives aux poursuites, pour qu'elle puisse être facilement imposée aux délinquants qui ont reconnu avoir commis un délit et prévu son application comme modalité d'exécution des peines, ce qui rend le « bannissement » applicable dans de nombreuses hypothèses.

Conjugués, ces dispositifs viendront apporter une réponse à la fois dissuasive et répressive à celles et ceux qui utilisent l'Internet pour répandre des discours haineux ou pour humilier, offenser et harceler.

B. PROTÉGER LES CITOYENS FACE AUX CAMPAGNES DE DÉSINFORMATION ET DE DÉSTABILISATION

La commission a adopté plusieurs amendements à l'article 4 visant à mieux lutter contre les ingérences en renforçant les moyens de l'Arcom. Un amendement vise à combler un « trou dans la raquette » en donnant au régulateur une compétence sur les services de télévision et les services de médias audiovisuels à la demande (SMAD) extra-communautaires diffusés en France ne relevant pas de la compétence d'un autre État membre de l'Union européenne.

C. ASSURER LA PROTECTION DE TOUS LES INTERNAUTES FACE AUX ACTES QUOTIDIENS DE CYBERMALVEILLANCE

Afin de rendre le dispositif plus opérationnel et plus protecteur, la commission spéciale a adopté plusieurs amendements visant à :

· faciliter la constatation des infractions entraînant le déclenchement du dispositif de filtrage afin de pouvoir mettre en demeure les éditeurs de services de communication au public en ligne frauduleux ;

· s'assurer que le message d'avertissement à destination des internautes tentant d'accéder à des sites frauduleux soit clair, lisible, unique, compréhensible et permette le renvoi vers la plateforme Cybermalveillance.gouv.fr ;

· responsabiliser l'ensemble des intermédiaires techniques chargés de mettre en oeuvre les procédures de blocage à la demande des autorités administratives compétentes ;

· renforcer l'information de la personnalité qualifiée au sein de la Cnil chargée de contrôler le caractère justifié et proportionné des mesures de blocage.

D. RÉÉQUILIBRER LE MARCHÉ EUROPÉEN DE L'INFORMATIQUE EN NUAGE

Afin de rééquilibrer les déséquilibres concurrentiels sur le marché de l'informatique en nuage et de soutenir le développement de nos entreprises françaises et européennes, la commission spéciale a adopté des amendements visant à :

· plafonner la durée d'octroi des avoirs d'informatique en nuage à un an tout en laissant la possibilité au pouvoir réglementaire de détailler les différentes pratiques de marché visées ;

· interdire toute condition d'exclusivité lors de l'octroi de tels avoirs ;

· préciser l'articulation de la suppression progressive des frais de transferts de données et des frais de changement de fournisseurs avec les dispositions du Data Act ;

· différencier les règles d'interopérabilité et de portabilité des services d'informatique en nuage édictées par l'Arcep en fonction de la nature de ces services (infrastructure, plateforme, logiciel), tout en prenant en compte les règles techniques édictées par les autres autorités européennes et les standards industriels existants.

E. SOUTENIR L'INNOVATION AFIN DE POSITIONNER NOS ENTREPRISES COMME ACTEURS DES NOUVEAUX MARCHÉS ET D'EN LIMITER LES RISQUES

Afin d'accompagner le développement des jeux à objets numériques monétisables (Jonum), de soutenir l'innovation de l'économie numérique et d'en identifier en amont les risques associés, la commission spéciale a décidé de supprimer l'habilitation à légiférer par ordonnance sur cette question. Une première définition, en droit, des Jonum est posée, afin de reconnaître leurs spécificités, entre jeux d'argent et de hasard d'un côté et jeux vidéo de l'autre.

Par ailleurs, la commission a souhaité autoriser, à titre expérimental pour une durée de trois ans, la création des Jonum, tout en prenant les précautions nécessaires pour s'assurer de la protection des mineurs et pour se prémunir des risques de création détournée de casinos en ligne.

Enfin, pour soutenir le développement des nouveaux marchés des services d'intermédiation des données, la commission a souhaité conforter le rôle de l'Arcep en la matière.

F. ADAPTER NOTRE DROIT NATIONAL AUX RÈGLEMENTS EUROPÉENS

Afin de faciliter l'évaluation et la compréhension de l'évolution des marchés numériques et des risques systémiques, la commission spéciale a souhaité renforcer la capacité de collecte de données du Pôle d'Expertise de la Régulation Numérique (PEReN), y compris au niveau des applications installées sur les systèmes d'exploitation, afin de lui permettre de mieux analyser les risques systémiques liés aux grandes plateformes et aux grands moteurs de recherche en ligne.

La commission a également souhaité faciliter la mise en oeuvre de la procédure d'échange des données de location de meublés de tourisme entre les communes et les plateformes numériques de location, afin de limiter la charge administrative des communes.

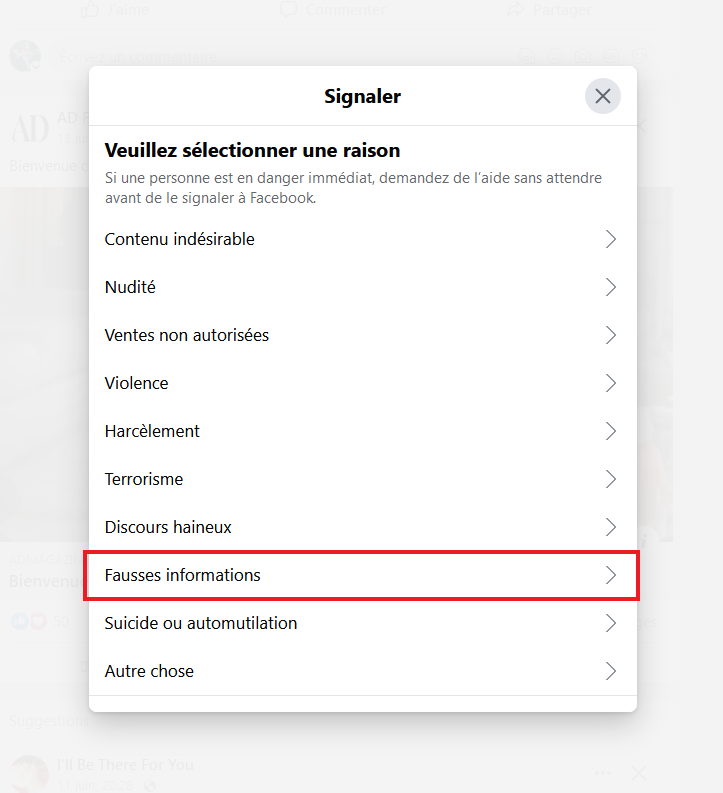

Dans l'optique de préserver les dispositifs « mieux-disants » que le RSN, la commission spéciale a notamment rétabli, à l'article 29, le dispositif de signalement des fausses informations instauré par la loi Infox du 22 décembre 2018.

Aux articles 31 et 32, la commission spéciale a adopté des amendements visant à faciliter l'exercice par la Cnil de ses prérogatives et à sécuriser l'action de ses contrôleurs. Cet objectif suppose l'existence d'un cadre stable et cohérent, s'appliquant sans distinction inutile aux pouvoirs d'enquête et de sanction de la Commission dans leur ensemble. Les nouveaux pouvoirs que la Cnil tire du RSN pourront ainsi s'appliquer aux manquements de toute nature, de même que les « injonctions à caractère provisoire » créées par le projet de loi.

G. POUR UNE MISE EN ADÉQUATION DES MOYENS BUDGÉTAIRES AUX MISSIONS

Même si cela ne relève pas du périmètre du projet de loi, la commission spéciale tient à souligner avec force que les nouveaux pouvoirs des administrations et des régulateurs doivent être accompagnés d'une mise à niveau de leurs moyens, sans quoi les dispositions ambitieuses du projet de loi resteront largement lettre morte.

*

* *

La commission spéciale a adopté le projet de loi ainsi modifié.

INTRODUCTION

La commission spéciale sur le projet de loi visant

à sécuriser et réguler l'espace numérique a

été constituée en séance publique au Sénat

le 1er juin 2023. Elle a tenu sa réunion constitutive le

6 juin, et a désigné à cette occasion Catherine

Morin-Desailly présidente, Patrick Chaize et

Loïc Hervé

rapporteurs. Les membres de la commission spéciale représentent

toutes les commissions permanentes et tous les groupes politiques du

Sénat.

Le calendrier d'examen du texte n'a laissé qu'un

temps très réduit au Sénat pour mener ses

travaux7(*), d'autant

plus que le projet de loi aborde un grand nombre de thématiques dans

différents domaines des politiques publiques, ainsi que des sujets

innovants qui n'ont encore jamais fait l'objet d'un examen parlementaire.

Malgré tout, en ce temps très contraint,

la commission

spéciale a organisé huit auditions

plénières8(*) et 21 auditions des rapporteurs, de nombreuses

contributions écrites ayant été également

communiquées.

Les travaux de la commission spéciale

avaient cependant été largement préparés en amont

par les différentes instances du Sénat,

qui ont

analysé en profondeur ces dernières années les

différents aspects de la régulation de l'économie et des

usages numériques, aux niveaux national et européen.

Les travaux de la Haute Assemblée avaient notamment porté sur les trois axes majeurs du projet de loi :

- la protection des mineurs contre les contenus à caractère pornographique et le cyberharcèlement, notamment dans la lignée des travaux de la délégation aux droits des femmes ;

- la reconquête d'une

souveraineté économique européenne, un

objectif conforté par la crise pandémique et la guerre aux

frontières de l'Europe et dont le numérique constitue une part

essentielle.

La commission des affaires européennes et la commission

des affaires économiques avaient longuement travaillé sur cette

question ;

- la régulation d'ensemble de l'économie, des marchés et des services numériques, avec des résolutions européennes adoptées pendant la phase de négociation par la France des trois projets de règlements sur les services numériques, les marchés numériques et la gouvernance des données, et qui ont permis d'en améliorer le contenu. Le projet de loi procède aux adaptations nécessaires de notre droit interne pour rendre ces règlements d'application directe pleinement opérationnels.

Même si beaucoup reste à faire, l'examen du projet de loi permet ainsi au Sénat de faire valoir ses propositions afin de renforcer la régulation d'un espace numérique autant source d'opportunités que d'inquiétudes.

I. PREMIER AXE : LA PROTECTION DES CITOYENS ET DES MINEURS

La protection des mineurs constitue une préoccupation constante du Sénat. Ainsi, le rapport9(*) de la délégation aux droits des femmes et à l'égalité des chances entre les hommes et les femmes d'Annick Billon, Alexandra Borchio Fontimp, Laurence Cohen et Laurence Rossignol, consacré à l'industrie pornographique a largement décrit les effets toxiques de l'accès des plus jeunes aux sites à caractère pornographique, tandis que la commission des lois, à l'initiative de son rapporteur Marie Mercier, a doté l'Arcom d'un rôle en matière de contrôle de la restriction d'accès des mineurs aux sites à contenus pornographiques10(*).

A. DES RÈGLES EUROPÉENNES (ENFIN) PLUS PROTECTRICES

Le règlement européen sur les services numériques comprend trois dispositions permettant précisément de renforcer la protection des mineurs en ligne :

Ø de manière générale, chaque fournisseur de services intermédiaires doit, à la suite d'une injonction émise par les autorités compétentes, agir contre les contenus illicites (dont les contenus pédopornographiques) ;

Ø plus spécifiquement, les fournisseurs de plateformes en ligne accessibles aux mineurs doivent mettre en place des « mesures appropriées et proportionnées pour garantir un niveau élevé de protection de la vie privée, de sûreté et de sécurité des mineurs sur leur service » ;

Ø enfin, ces fournisseurs de plateformes ne doivent pas développer des publicités en ligne ciblées visant les mineurs.

Une proposition de règlement européen établissant des règles en vue de prévenir et de combattre les abus sexuels sur enfants, en cours de négociation au niveau européen, et au sujet de laquelle le Sénat a adopté, le 15 février dernier, une résolution européenne11(*) sur le rapport des sénateurs Catherine Morin-Desailly, Ludovic Haye et André Reichardt, tend à renforcer les obligations imposées aux fournisseurs de services d'hébergement et de communications interpersonnelles afin d'assurer la protection des mineurs en ligne. Ce texte leur impose en particulier, sur injonction des autorités nationales compétentes, de détecter les contenus pédopornographiques en ligne, de les retirer ou d'en bloquer l'accès, sous peine de sanctions.

B. LES DISPOSITIONS DU PROJET DE LOI RELATIVES À LA PROTECTION DES MINEURS EN LIGNE

Dans le cadre de ses fonctions de coordinateur pour les services numériques, l'Arcom, se voit attribuer des pouvoirs renforcés au titre de la protection des mineurs en ligne.

ü La vérification de l'âge des utilisateurs des sites pornographiques est mise en place par les articles 1er et 2 du projet de loi

L'Arcom serait désormais chargée de veiller « à ce que les contenus pornographiques mis à disposition du public par un service de communication au public en ligne ne puissent pas être accessibles aux mineurs ».

Cette disposition peut être considérée comme l'une des « mesures appropriées et proportionnées » que l'article 28 du règlement européen sur les services numériques (RSN) ordonne aux fournisseurs de plateformes en ligne de mettre en oeuvre pour protéger les mineurs.

Elle répond surtout à une demande réitérée du Sénat, qui l'a exprimée dans ses résolutions européennes du 14 janvier 2022 et du 13 février 2023, ainsi que dans les recommandations de sa délégation aux droits des femmes et à l'égalité des chances entre les hommes et les femmes sur l'industrie de la pornographie.

L'article 2 du projet de loi mettrait en place une sanction administrative des éditeurs de services de communication au public en ligne qui permettent l'accès des mineurs à des contenus pornographiques et permettrait à l'Arcom de délivrer directement des injonctions de blocage et de déréférencement aux fournisseurs d'accès à Internet et aux moteurs de recherche.

Cette disposition constitue, là encore, une déclinaison française des articles 28, 51 et 52 du règlement sur les services numériques (RSN) : « mesures appropriées et proportionnées » exigées des fournisseurs de plateformes en ligne afin de permettre la protection de la vie privée, la sûreté et la sécurité des mineurs sur les services concernés ; pouvoirs d'enquête et de sanction du coordinateur des services numériques ; sanctions définies par les États membres avec un montant maximal égal à 6 % du chiffre d'affaires mondial du fournisseur concerné.

Elle constitue enfin et surtout une actualisation du dispositif sénatorial mis en place en France par la loi du 30 juillet 2020 à l'initiative du sénateur Marie Mercier, qui permet déjà au président de l'Arcom (alors CSA) de mettre en demeure tout éditeur de services de communication au public en ligne qui offre l'accès des mineurs à des contenus pornographiques. Et, si cette mise en demeure reste sans effet, de saisir le président du tribunal judiciaire de Paris, afin que ce dernier ordonne la fin de l'accès à ce service et, le cas échéant, son déréférencement.

L'application de ce dispositif essentiel pour la protection des mineurs a malheureusement été sans effet jusqu'à présent, suite à de nombreux recours contentieux menés par les sites concernés.

ü L'article 3 du projet de loi met en place la pénalisation du défaut d'exécution en vingt-quatre heures d'une demande de l'autorité administrative de retrait de contenu pédopornographique.

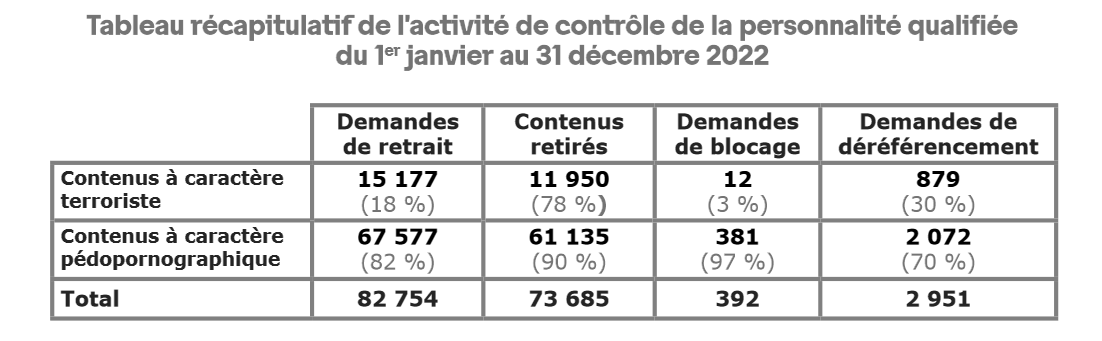

Le droit français, depuis 2004, a confié à l'Office central de lutte contre la criminalité liée aux technologies de l'information et de la communication (OCLCTIC), responsable de la plateforme Pharos, le soin d'ordonner aux fournisseurs de services d'hébergement le retrait de contenus terroristes et pédopornographiques sur Internet. À défaut, si dans un délai de vingt-quatre heures le retrait des contenus visés n'est pas effectif, l'autorité administrative précitée impose, par notification aux fournisseurs d'accès, le blocage de l'accès à ces contenus. En complément, le service concerné peut aussi faire l'objet d'une demande de déréférencement.

Cette procédure administrative se déroule sous le contrôle d'une personnalité qualifiée de l'Arcom, qui examine la régularité des demandes de retraits (article 6-1 de la loi n° 2004-575 du 21 juin 2004 pour la confiance dans l'économie numérique).

Le projet de loi introduit dans cette loi de 2004 trois articles 6-2, 6-2-1 et 6-2-2 pour compléter ce cadre juridique et le rendre plus efficient.

La procédure de retrait des contenus pédopornographiques en ligne existe en France depuis 2004 - notre pays a été pionnier en la matière - et elle fonctionne de manière satisfaisante.

Les dispositions complémentaires du projet de loi seraient conformes à « l'injonction d'agir contre les contenus illicites » prévue à l'article 9 du RSN et seraient partie intégrante des « mesures appropriées et proportionnées » que son article 28 demande aux fournisseurs de prendre au nom de la protection des mineurs.

Elles seraient également compatibles avec les dispositions de la proposition de règlement visant à prévenir et à combattre les abus sexuels sur enfants (délai de vingt-quatre heures pour respecter l'injonction de retrait ; énonciation des motifs légitimes de ne pas la respecter : force majeure, impossibilité de fait ; droit au recours effectif des fournisseurs contre une injonction ; sanctions déterminées par les États membres dans un plafond de 4 % du chiffre d'affaires mondial de l'exercice précédent du fournisseur...).

Enfin, le projet de loi désigne la Cnil pour faire respecter l'interdiction de présentation aux mineurs de publicités fondées sur le profilage par les fournisseurs de plateformes en ligne. En application de cette compétence, la Cnil peut procéder à des contrôles dans les locaux ou installations permettant le traitement de données personnelles afin de vérifier si de telles publicités ciblées sont pratiquées et de demander au responsable de ce traitement de lui communiquer tous les documents utiles. Si elle estime que le responsable de traitement compétent méconnaît cette interdiction, la Cnil peut lui adresser un avertissement.

Cette disposition est la mise en oeuvre de l'article 28, paragraphe 2, du RSN, qui prohibe toute publicité ciblée à l'égard des mineurs.

C. LA PRISE EN COMPTE DES TRAVAUX DE LA DÉLÉGATION AUX DROITS DES FEMMES

De manière générale, on retrouve dans le dispositif proposé une ample prise en compte des recommandations contenues dans le rapport de la délégation aux droits des femmes précité sur l'industrie pornographique, avec en particulier la faculté pour l'Arcom de prononcer des sanctions administratives contre les sites ne respectant pas leurs obligations (recommandation n° 12), via des agents assermentés (recommandation n° 11), de même que l'édiction par l'Arcom de règles exigeantes de vérification de l'âge au moment de la connexion sur un site à caractère pornographique (recommandations nos 14 et 15). Le projet de loi ne rentre cependant pas dans les détails de ce dispositif technique, qui pourrait largement recourir à la solution du double anonymat promu par la délégation.

Par ailleurs, à la suite de l'adoption de la loi du 2 mars 2022 visant à renforcer le contrôle parental sur les moyens d'accès à Internet12(*), dont les mesures d'application devraient prochainement entrer en vigueur, l'usage du contrôle parental devrait être facilité, car le dispositif voté prévoit une pré-installation par défaut d'un outil de contrôle parental sur les terminaux vendus en France et permettant d'accéder à Internet, notamment les téléphones portables

Dans l'ensemble, les travaux de la délégation ont été pris en compte, même si les auditions menées par la commission spéciale et les rapporteurs ont soulevé des interrogations sur la mise en oeuvre pratique des dispositifs, face à des sites Internet peu coopératifs.

D. LA LUTTE CONTRE LA HAINE EN LIGNE

Le Sénat a mené en 2021 une mission d'information13(*) sur le harcèlement scolaire et le cyberharcèlement, un sujet revenu de manière dramatique sous les feux de l'actualité avec le suicide de la jeune Lindsay.

L'article 5 du projet de loi propose de mettre en place une peine complémentaire de suspension de compte sur les réseaux sociaux pour les utilisateurs condamnés pour certains délits, au premier rang desquels la diffusion de la haine en ligne ou pour cyberharcèlement.

II. DEUXIÈME AXE : LA SOUVERAINETÉ ÉCONOMIQUE ET NUMÉRIQUE EUROPÉENNE

A. UN SUJET AU CoeUR DES PRÉOCCUPATIONS DU SÉNAT

La question de la souveraineté numérique de l'Europe est évoquée de longue date au Sénat.

Dès 2013, Catherine Morin-Desailly alertait sur le

risque de voir l'Union européenne devenir « une colonie

du monde numérique14(*) ». Le rapport15(*) de 2019 de la commission

d'enquête présidée par Franck Montaugé avec comme

rapporteur Gérard Longuet intitulé « Le devoir de

souveraineté numérique »

a relancé le

débat sur la nécessité de mettre en place une

véritable stratégie « globale et

lisible ».

Les événements récents, tels que la crise pandémique ou la guerre en Ukraine, ont plus que jamais mis en avant l'impératif pour l'Europe de se doter de réels outils de souveraineté, dans le domaine numérique comme dans tant d'autres. La voie à emprunter n'est pas cependant pas simple, tant les intérêts des États peuvent apparaître en premier abord divergents, même si des progrès notables ont été réalisés ces derniers mois. Pour autant, il est indéniable que, face à des entreprises géantes, soutenues par leur gouvernement, l'Europe est le bon échelon d'action. Ainsi, la commission des affaires économiques, sur le rapport de Patrick Chaize16(*), a approuvé le 13 juillet 2022 la proposition de résolution européenne17(*) adoptée le 14 juin 2022 à l'initiative de Florence Blatrix Contat et Catherine Morin-Desailly sur le programme d'action numérique de l'Union européenne à l'horizon 2030.

Sans constituer une réponse exhaustive, le présent projet de loi permet quelques avancées notables sur la question sensible des données « en nuage ».

B. LA RÉGULATION DE L'INFORMATIQUE EN NUAGE

Dans leur rapport18(*) au nom de la commission des affaires économiques Cinq plans pour reconstruire la souveraineté économique, Sophie Primas, Amel Gacquerre et Franck Montaugé consacrent de larges développements à la réduction de la dépendance de notre pays dans le secteur de la donnée.

Ils mettent en particulier en avant la pratique des « crédits cloud » par les grandes entreprises américaines, à destination des jeunes entreprises, afin de leur permettre d'utiliser gratuitement et temporairement leurs logiciels et services d'hébergement de données.

Cette stratégie des « crédits cloud » peut être vue comme un moyen de soutenir la croissance et le développement des jeunes entreprises, en particulier celles qui sont actives dans le domaine de la technologie. Cependant, à terme, cette pratique commerciale « enferme » littéralement les entreprises dans leur phase de croissance dans une relation de dépendance avec leur fournisseur. En raison de la durée d'octroi de ces crédits, des montants distribués et des conditions restrictives imposées par les grandes entreprises américaines du numérique pour transférer les données qu'elles hébergent vers d'autres infrastructures et logiciels, ces pratiques ont été considérées comme ayant des effets anticoncurrentiels importants dans le rapport précité de la commission des affaires économiques.

De plus, si les entreprises françaises de l'informatique en nuage suivent désormais cette stratégie commerciale, elles ne peuvent en réalité pas rivaliser avec les géants américains qui monopolisent le marché...

La dépendance induite par ces pratiques a par ailleurs des effets de long terme. Ainsi, les jeunes entreprises qui auront recouru aux services des opérateurs américains lors de leur lancement seront invités à poursuivre avec le même fournisseur, ce qui a des impacts à plus long terme à la fois pour elles-mêmes, pour le marché du travail des jeunes diplômés et pour les entreprises européennes qui souhaiteraient se développer dans cette branche.

Dans leur rapport19(*) au nom de la commission des affaires européennes sur la proposition de résolution européenne sur le projet de règlement fixant des règles harmonisées pour l'équité de l'accès aux données et de l'utilisation des données du 11 mai 2023 (dit Data Act), Florence Blatrix Contat, André Gattolin et Catherine Morin-Desailly ont également fixé comme ambition de « supprimer les obstacles au changement de fournisseur ». Ce rapport est assorti d'une proposition20(*) de résolution européenne déposée le même jour, qui propose des objectifs ambitieux en matière de traitement des données et de souveraineté. En particulier, il appelle à « renforcer l'effectivité du droit de changer de fournisseur de services de traitement des données », avec plusieurs mesures comme la limitation des frais de transfert et de migration.

Le Data Act

Le projet de règlement européen sur les données, dit Data Act, est actuellement en cours de discussion. La finalisation des négociations en trilogue semble à ce stade en bonne voie, et le texte pourrait être adopté d'ici la fin de l'année 2023.

Plusieurs points d'accord vont dans le sens de la résolution européenne du Sénat :

- l'affirmation de la primauté des règles de protection des données à caractère personnel ;

- le renforcement des droits des utilisateurs sur les données produites ;

- le partage de données avec des tiers : encadrement des frais de mise à disposition pour prévenir les abus.

Le projet prévoit le droit de changer de fournisseur des services de traitement de données. Comme le souhaitait le Sénat, il est prévu de renforcer l'information préalable à l'acceptation de l'offre sur le droit de changer de fournisseur et les modalités de ce changement. En cas de demande de changement, le processus doit être lancé dans les deux mois suivant la notification (ce qui devrait écarter les délais résultant de crédits gratuits), et il est précisé que les frais doivent correspondre aux coûts de transferts vers le nouveau prestataire. En revanche, le délai de trois ans prévus pour la suppression progressive des frais ne serait pas réduit.

Les conditions de transfert vers des pays tiers avec lesquels l'Union Européenne n'a pas d'accord sont très strictement encadrées, mais l'opportunité de mettre en place un cloud souverain n'est pas évoquée.

Le projet de loi a tenu compte des remarques formulées par la commission des affaires européennes et la commission des affaires économiques visant à limiter la dépendance excessive à quelques fournisseurs d'infrastructures « en nuage » et à permettre le développement d'une véritable industrie européenne de la donnée.

Ainsi, le titre III (articles 7 à 14) vise à renforcer la confiance et la concurrence dans l'économie de la donnée et transpose par anticipation plusieurs dispositions du Data Act, notamment sur les frais de transfert et de migration des données.

L'article 7, qui n'est pas prévu dans le projet de règlement, prévoit pour sa part une limitation de la durée des « crédits cloud », dans une temporalité fixée par décret mais que le ministre, lors de son audition devant la commission spéciale le 8 juin, a souhaitée comprise entre trois et six mois. Ce sujet a fait l'objet d'une table ronde spécifique qui s'est tenue devant la commission spéciale le 15 juin.

III. TROISIÈME AXE : DES RÈGLEMENTS EUROPÉENS QUI PORTENT LA MARQUE DES TRAVAUX DU SÉNAT

Le projet de loi est pour une large partie consacré à l'adaptation de notre droit à trois règlements européens : le règlement sur les marchés numériques (RMN, ou DMA)21(*) du 14 septembre 2022, le règlement relatif à un marché unique des services numériques (RSN, ou DSA)22(*) du 19 octobre 2022 et le règlement du 30 mai 2022 sur la gouvernance européenne des données (Data Governance Act, ou DGA)23(*).

A. LE RÈGLEMENT SUR LES MARCHÉS NUMÉRIQUES (RMN)

Présenté fin 2020 par la Commission européenne et adopté en juillet 2022, le règlement sur les marchés numériques vise à lutter contre les pratiques anticoncurrentielles dans l'économie des plateformes en ligne, qui enferment les utilisateurs dans leurs applications et empêchent le développement de nouveaux concurrents, et à corriger les déséquilibres résultant de leur domination sur le marché numérique européen.

Il définit à cet effet de nouvelles obligations que ces dernières devront respecter, au profit de l'innovation, de produits et services numériques de qualité, de la création de valeur et de son partage équitable pour le bénéfice des entreprises en relation d'affaires avec ces plateformes et du libre choix des consommateurs.

Entré en vigueur le 1er novembre 2022, le RMN est en grande partie applicable depuis le 2 mai 2023 et les contrôleurs d'accès, qui seront désignés à partir de juin 2023, devront s'y conformer à partir de décembre 2023 et au plus tard le 6 mars 2024.

1. Une régulation ex ante des contrôleurs d'accès

Le droit de la concurrence, qui sanctionne a posteriori des ententes ou des abus de position dominante, mais à l'issue de longues enquêtes et de contentieux nourris, n'incitait pas jusqu'à présent les grandes plateformes à modifier en profondeur leurs comportements, motif pour lequel le RMN les a soumis au respect ex ante d'obligations et interdictions concernant des comportements très généralisées et préjudiciables aux utilisateurs.

Celles-ci s'appliquent uniquement aux

« contrôleurs d'accès »

(gatekeepers) qui contrôlent un ou plusieurs services de

plateforme essentiels dans au moins trois États membres,

réalisent un chiffre d'affaires annuel d'au moins 7,5 milliards

d'euros au sein de l'Union européenne ou dont la capitalisation

boursière excède 75 milliards d'euros, et qui

ont plus

de 45 millions d'utilisateurs finaux mensuels au sein de

l'Union européenne

et 10 000 entreprises utilisatrices.

Les entités qui franchissent ces seuils doivent se déclarer auprès de la Commission européenne. À défaut, celle-ci peut les désigner unilatéralement. Elle peut également désigner comme tels des entreprises qui n'atteignent pas tous ces seuils en raison des barrières qu'elles imposent et de leur domination du marché.

Ces contrôleurs d'accès sont soumis à un ensemble d'obligations, en particulier :

Ø permettre aux utilisateurs de désinstaller les applications préinstallées sur leurs smartphones et de choisir leurs services par défaut pour certains services clefs de l'économie numérique ;

Ø rendre les services de messagerie instantanée interopérables avec d'autres services de messagerie ;

Ø permettre aux développeurs d'applications d'accéder dans des conditions équitables aux fonctionnalités auxiliaires et matériels informatiques des smartphones ;

Ø permettre aux entreprises qui utilisent les plateformes d'accéder à un certain nombre de données essentielles.

Il leur est en outre interdit, notamment, de :

Ø classer leurs propres produits ou services de façon plus favorable que ceux des concurrents (auto-préférence) ;

Ø utiliser, sans le consentement des utilisateurs, les données personnelles collectées entre différents services ;

Ø empêcher les entreprises utilisatrices de proposer leurs produits ou services sur d'autres plateformes ou d'autres canaux de distribution, à des conditions différentes.

De manière générale, il s'agit ainsi de remettre en cause les techniques qui ont permis aux grandes plateformes d'asseoir leur domination et d'offrir une plus grande liberté aux utilisateurs, afin qu'ils puissent se désabonner plus facilement, désinstaller de leurs appareils des logiciels préinstallés, utiliser d'autres services (portabilité et interopérabilité). L'accent est mis sur les coûts des transferts et les biais comportementaux. Certaines obligations concernent plutôt les utilisateurs professionnels, en particulier la possibilité de promouvoir leur offre et de conclure des contrats en dehors de la plateforme sur laquelle ils proposent biens et services, comme par exemple la pré-installation exclusive des systèmes d'exploitation et des navigateurs en imposant des écrans multi-choix.

En cas de méconnaissance de ces obligations et interdictions, le contrôleur d'accès est passible d'une amende pouvant atteindre 10 % de son chiffre d'affaires mondial total (20 % en cas de récidive).

Lorsqu'un contrôleur d'accès adopte un comportement de non-respect systématique du RMN (enfreint les règles au moins trois fois en huit ans), la Commission européenne peut ouvrir une enquête de marché et, si nécessaire, imposer des mesures correctives comportementales ou structurelles (dont l'interdiction de réaliser des acquisitions dans le domaine du numérique).

La Commission européenne est seule habilitée à faire appliquer le règlement mais elle peut être appuyée par les autorités nationales de concurrence, qui peuvent ouvrir des enquêtes sur d'éventuelles infractions au DMA et lui transmettre leurs conclusions.

Une obligation d'information de la Commission sur les acquisitions envisagées est par ailleurs prévue, même en deçà des seuils nationaux ou européens de contrôle des concentrations. La Commission européenne peut procéder à un contrôle proprio motu ou à la demande d'un État membre.

Trois comités contribuent à la mise en oeuvre du RMN : le Réseau européen de concurrence (REC), qui assurera la cohérence entre les actions menées au niveau national ou par la Commission, le groupe de haut niveau, qui réunit au niveau européen les représentants de l'ensemble des régulateurs sectoriels concernés, et le comité consultatif, qui joue un rôle très important dans la mise en place, pour les textes d'application.

2. Les apports du Sénat au règlement européen

La proposition de règlement a fait l'objet d'un examen par la commission des affaires européennes, dans la suite du rapport d'information24(*) présenté par Catherine Morin-Desailly et Florence Blatrix Contat, qui a conduit à l'adoption d'une proposition de résolution européenne devenue résolution européenne du Sénat le 12 novembre 2021 et d'un avis politique qui en reprend les termes, destiné à la présidente de la Commission européenne et à la présidente du Parlement européen.

La résolution du Sénat a été suivie sur plusieurs points, en particulier :

ü l'ajout de services essentiels : navigateurs, assistants vocaux et services de messagerie en ligne ainsi que des services que la résolution qualifiait de secondaire : cloud et publicité en ligne ;

ü des précisions sur les interdictions.

Elle a été partiellement prise en compte sur la coopération entre la Commission européenne et les autorités nationales, y compris en matière de contrôle des concentrations en deçà des seuils.

3. Un projet de loi qui adapte le droit français au RMN

S'agissant d'un règlement directement applicable en droit interne et qui n'ouvre pas d'options, la mise en oeuvre en France du RMN s'accompagne de mesures de coordination dans le code de commerce (en particulier des renvois au RMN pour certaines définitions).

L'Autorité de la concurrence et la Direction générale de la concurrence, de la consommation et de la répression des fraudes (DGCCRF), en coopération avec la Commission européenne dans le cadre du « Réseau européenne concurrence », sont désignées comme autorités compétentes pour l'application du RMN et des juridictions spécialisées sont chargées de traiter des litiges ressortissant de celle-ci.

En cas de méconnaissance par les contrôleurs d'accès des obligations et interdictions définies par le RMN et lorsque les manquements se produisent sur le territoire national et qu'elles sont mandatées à cet effet par la Commission, il est prévu que l'Autorité de la concurrence et la DGCCRF sont habilitées à mener des inspections (art. 23 § 3, 4 et 7 à 10 du RMN).

Elles pourront en outre prêter assistance à la Commission pour mener des auditions et recueillir des déclarations dans les locaux d'une entreprise (art. 22 § 2 du RMN). Elles pourront également recevoir des signalements de tiers et prendre des mesures appropriées (art. 27 du RMN).

Il est également prévu qu'elles peuvent mener, de leur propre initiative des enquêtes, sur la méconnaissance éventuelle de ces obligations et interdictions (art. 38 § 6 et 7 du RMN).

Enfin, le ministre chargé de l'économie ou son représentant est habilité à adresser à la Commission européenne, conjointement avec au moins trois autres États membres, une demande d'ouverture d'enquête de marché lorsqu'il existe des motifs raisonnables de soupçonner qu'une entreprise est « contrôleur d'accès » (art. 41 du RMN).

B. LE RÈGLEMENT SUR LES SERVICES NUMÉRIQUES (RSN)

Le règlement relatif à un marché unique des services numériques (RSN), définitivement adopté le 4 octobre 2022, doit entrer en vigueur le 25 août 2023 s'agissant des très grandes plateformes et le 17 février 2024 pour le reste des dispositions. Il établit un cadre juridique européen sur la fourniture de services d'intermédiation en ligne dans le marché intérieur pour responsabiliser les grandes plateformes numériques, mieux définir les contenus pouvant être disponibles en ligne et, simultanément, lutter contre les contenus illicites (contenus terroristes ou pédopornographiques, vente de stupéfiants, de produits contrefaits, etc.).

1. Une régulation des fournisseurs de services d'intermédiation en ligne

Le RSN vise :

Ø les fournisseurs d'accès à Internet (FAI) ;

Ø les services d'informatique en nuage (cloud) ;

Ø les plateformes en ligne (boutiques d'application, réseaux sociaux, plateformes de partage de contenus...) ;

Ø les très grandes plateformes et les très grands moteurs de recherche (définis avec le critère du RMN de 45 millions d'utilisateurs mensuels dans l'Union européenne).

Chaque État membre doit nommer un « coordinateur des services numériques », autorité indépendante chargée de faire appliquer le cadre juridique européen et la Commission européenne va mettre en place une supervision sur les très grandes plateformes, au sein d'un réseau de contrôle européen (« Comité européen des services numériques ») qui réunit les autorités de régulation nationales.

Le règlement prévoit des mesures pour lutter contre les contenus illicites (injonctions des autorités compétentes, rapports de transparence sur les actions de modération des contenus, mécanismes de signalement de ces contenus par les utilisateurs, transmission des informations conduisant à soupçonner une infraction pénale aux autorités compétentes).

Ces mesures sont renforcées pour les plateformes en ligne (« signaleurs de confiance » et traitement de leurs demandes dans les meilleurs délais ; possibilité, pour ces fournisseurs, de suspendre, après un avertissement préalable, la fourniture de leurs services à ceux qui fournissent fréquemment des contenus manifestement illicites ; rapports de transparence renforcés ; information des consommateurs ayant acheté un produit ou un service en ligne illégal sur l'illégalité de ce produit ou service, l'identité du professionnel concerné et les voies de recours ; protection des mineurs en ligne par des « mesures appropriées et proportionnées »).

En outre, les places de marché (market places) devront mieux identifier les vendeurs de produits ou de services sur leurs plateformes et mieux en informer les consommateurs.

Une transparence accrue du fonctionnement des plateformes est également prévue (mise en place de systèmes internes de traitement des réclamations, mise à disposition d'informations sur les algorithmes choisis pour recommander des contenus publicitaires, obligation de proposer un système de recommandation de contenus transparent et non fondé sur le profilage).

Les très grandes plateformes et les très grands moteurs de recherche sont en outre soumis à des obligations renforcées (évaluation de tout risque systémique issu de la conception ou du fonctionnement de leurs services, atténuation de ces risques s'ils sont avérés, audits indépendants, accès à leurs données et contrôle de ces dernières par les coordinateurs des services numériques des États membres et la Commission européenne, mécanisme de réaction aux crises) à compter du 25 août 2023. La Commission européenne a ainsi récemment désigné les dix-sept grandes plateformes (AliExpress, Amazon Store, App Store, Booking, Facebook, Google Maps, Google Play, Google Shopping, Instagram, LinkedIn, Pinterest, Snapchat, TikTok, Twitter, Wikipédia, YouTube, Zalando) et les deux très grands moteurs de recherche en ligne concernés (Bing et Google Search).

Certains types de publicités ciblées sont interdits lorsqu'elles visent les mineurs ou utilisent certaines données à caractère personnel telles que les opinions politiques.

En cas de non-respect du RSN par des entreprises, les coordinateurs nationaux et la Commission européenne pourront prononcer des astreintes ou infliger des sanctions (jusqu'à 6 % du chiffre d'affaires mondial). En cas de violations graves et répétées au règlement, les plateformes pourront se voir interdire d'activités sur le marché européen.

2. Le Sénat entendu sur le RSN, en dépit de quelques regrets

Sur proposition des rapporteures Florence Blatrix Contat et Catherine Morin-Desailly, et à la suite de leur rapport25(*), la commission des affaires européennes a adopté une proposition de résolution européenne devenue résolution européenne du Sénat le 14 janvier 2022.

Le Sénat a en particulier été entendu sur l'inclusion des très grands moteurs de recherche dans le périmètre des obligations définies par le règlement et la prise en compte du critère d'audience (45 millions d'utilisateurs actifs du service dans l'Union) pour définir les très grandes plateformes en ligne et les très grands moteurs de recherche. Il n'est toutefois pas prévu que les régulateurs puissent soumettre au cas par cas d'autres plateformes aux obligations renforcées des très grandes plateformes, notamment en raison de leur taux de pénétration chez les jeunes publics.

En revanche, contrairement à ce que souhaitait le Sénat, le texte adopté n'a pas remis en cause le régime de responsabilité limitée des hébergeurs26(*), y compris des plateformes en ligne, par exemple lorsqu'ils ont permis la conclusion de contrats de vente de produits illicites ou dangereux ayant causé des dommages ou la diffusion de contenus illicites. On peut toutefois noter que, depuis lors, les obligations des fournisseurs de services d'hébergement ont été renforcées en matière de lutte contre le terrorisme en ligne27(*).

Le Sénat avait également attiré l'attention sur le fait que de nombreux fournisseurs de services sur Internet, autres que les plateformes en ligne, permettent de conclure des contrats de vente en ligne, y compris à titre accessoire mais le règlement n'a pas inclus cette problématique.

Par ailleurs, même si elle va mettre en place une supervision sur les très grandes plateformes, au sein d'un réseau de contrôle européen (Comité européen des services numériques) qui réunit les autorités de régulation nationales, la Commission européenne n'est pas dotée de pouvoir d'enquête et de sanction sur les très grandes plateformes, ce qui ne permettra pas de pallier l'inégale diligence des différentes autorités de régulation nationales à faire appliquer les régulations numériques.

S'agissant des signaleurs de confiance, le règlement ne permet pas non plus que ce statut puisse être accordé à certaines entités représentant des intérêts particuliers, telles que des marques, des sociétés de gestion de droits d'auteur ou des journalistes, dans le cadre d'activités de vérification de faits.

Il apparaît également que les spécificités du modèle économique des grandes plateformes en ligne ne sont pas pleinement prises en compte (exploitation par des algorithmes, aussi puissants qu'opaques, de très grandes quantités de données - en particulier de données à caractère personnel -, utilisées pour le ciblage des contenus et des publicités, en vue de maximiser le temps passé par l'utilisateur sur leurs services et, partant, les revenus publicitaires des plateformes) et que la responsabilité des fournisseurs de services intermédiaires utilisant des algorithmes d'ordonnancement des contenus n'a pas été renforcée.

Enfin, de manière générale, les dispositifs de protection des consommateurs prévus par le texte ne prennent pas pleinement en compte les recommandations du Sénat (par exemple en matière d'éthique et de respect des droits fondamentaux, obligatoires pour tous les algorithmes, dès leur création (lega by design) ou de lutte contre la viralité des contenus illicites ou de protection des mineurs (interdiction de la publicité ciblée pour les mineurs et droit à l'oubli pour les mineurs).

3. Adaptation du droit national et désignation des autorités nationales compétentes

S'agissant là encore d'un règlement directement applicable en droit interne et qui n'ouvre pas d'options, la mise en oeuvre en France du RSN s'accompagne de mesures d'adaptation de la loi pour la confiance dans l'économie numérique (articles 22 à 24) pour la mise en oeuvre (procédures, sanctions) et la mise en cohérence avec le RSN (définitions par renvois), y compris en matière de lutte contre les contenus terroristes et pédopornographiques.

Les autorités compétentes françaises pour la mise en oeuvre du RSN sont, selon le cas, l'Arcom, la Cnil ou la DGCCRF, l'Arcom étant désignée comme coordinateur national des services numériques (article 25).

Les pouvoirs d'enquête, d'exécution et de sanction de l'Arcom pour la mise en oeuvre du RSN sont précisés, ainsi que ceux de la DGCCRF et de la Cnil, pour faire respecter certaines obligations du RSN (profilage, publicité ciblée notamment) par les fournisseurs en ligne (article 32).

Des mesures d'adaptation sont également introduites dans le code de la consommation (article 26), afin de les rendre cohérentes avec la mise en oeuvre du RSN (contrôles par la DGCCRF et amendes civiles voire sanctions pénales en cas d'infraction, astreintes pouvant être prononcées par le juge aux fins de mise en conformité).

Il est également renvoyé aux définitions du RSN dans les lois relatives à la liberté de communication et la lutte contre la manipulation de l'information ainsi que dans le code électoral (articles 28 à 30).

Enfin, des coordinations sont prévues en matière de protection de la propriété intellectuelle (article 34).

C. LE RÈGLEMENT SUR LA GOUVERNANCE EUROPÉENNE DES DONNÉES (DGA)

1. Faciliter la réutilisation des données du secteur public

Le règlement prévoit qu'un plus grand nombre de données détenues par le secteur public seront éligibles au droit de réutilisation à compter du 24 septembre 2023, y compris des données protégées par la confidentialité commerciale, le secret statistique, les droits de propriété intellectuelle de tiers et certaines données à caractère personnel, pour que celles-ci servent, in fine, à améliorer la productivité et à stimuler l'innovation.

Pour faciliter la réutilisation de ces données, une obligation d'assistance du demandeur est prévue, chaque État membre devant créer un point d'information unique destiné à fournir aux réutilisateurs potentiels des informations sur les données détenues par les autorités publiques. Un point d'information unique sera également mis en place au niveau européen par la Commission. Pour permettre une disponibilité maximale de ces données détenues par les organismes publics, il est interdit aux organismes publics de conclure des accords d'exclusivité de réutilisation des données, sauf exceptions liées à l'intérêt public.