II. L'AUSTRALIE

Le gouvernement australien considère que « l'accès des mineurs à des services et contenus en ligne inappropriés pour leur âge ou potentiellement dangereux est une préoccupation majeure en matière de sécurité en ligne pour la communauté australienne » 28 ( * ) .

En 2017, une enquête menée par l'Institut australien des études familiales a indiqué que près de la moitié des enfants âgés de 9 à 16 ans étaient régulièrement exposés à des images sexuelles. En 2018, le Bureau du commissaire à la sécurité en ligne ( eSafety Commissioner ) a publié un rapport intitulé Parentalité et pornographie : les résultats de l'Australie, de la Nouvelle-Zélande et du Royaume-Uni , selon lequel 33 % des parents ont indiqué que l'accès à la pornographie était l'une de leurs principales préoccupations pour la sécurité en ligne des enfants. Ce rapport estime également que 40 % des expositions des mineurs à la pornographie était accidentelle.

Pourtant, la production et la vente de films pornographiques ou le chargement de telles vidéos sur Internet sont interdits dans la plupart des États australiens. Dans ces États, Le visionnage de contenus pornographiques classiques, hébergés sur des serveurs étrangers, n'est toutefois pas illégal.

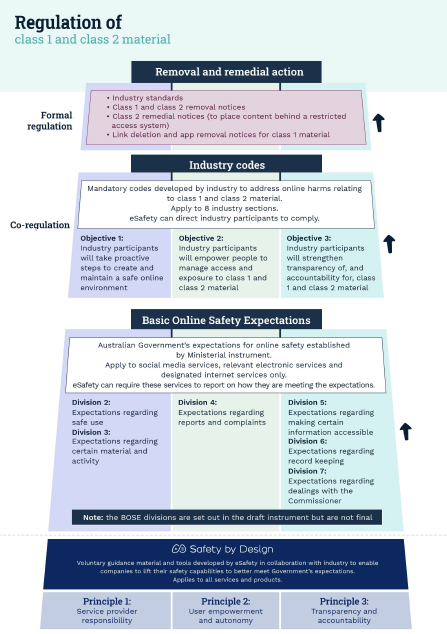

Afin de minimiser l'accès des enfants et adolescents aux contenus inappropriés et potentiellement dangereux, dont les contenus pornographiques, l'Australie a adopté, en 2021, une nouvelle loi sur la sécurité en ligne. L'approche retenue continue de reposer sur la co-régulation, tout en renforçant les pouvoirs du commissaire à la sécurité en ligne. S'agissant des contenus pornographiques, une proposition de mise en place d'un système obligatoire de vérification de l'âge est attendue en décembre 2022.

A. LA LOI SUR LA SÉCURITÉ EN LIGNE

Une nouvelle loi sur la sécurité en ligne (Online Safety Act) a été adoptée en 2021 et est entrée en vigueur le 23 janvier 2022 29 ( * ) . Elle complète et renforce les dispositions de la loi de 2015 ( Enhancing Online Safety Act 2015 ) et certaines parties de la loi sur les services audiovisuels de 1992 ( Broadcasting Services Act 1992 ). Elle modernise le système de classification des contenus en ligne, oblige les entreprises du numérique à adopter des codes de conduite règlementant l'accès aux contenus potentiellement dangereux et renforce les pouvoirs du commissaire à la sécurité en ligne « eSafety ».

1. La classification des contenus en ligne

Selon la loi sur la sécurité en ligne ( Part 9, Division 1 ) 30 ( * ) , les contenus en ligne illégaux et à accès restreint ( illegal and restricted online content ) désignent un large ensemble de contenus allant des contenus les plus dangereux, comme les images d'abus sexuel sur des enfants ou de terrorisme, à des contenus moins graves mais qui ne devraient pas être accessibles à des mineurs. Ils sont classés par référence au système national de classification ( National Classification Scheme 31 ( * ) ) qui s'applique aux films, publications et jeux informatiques. Ainsi :

- la « classe 1 » correspond aux contenus dont la classification serait refusée dans le système national ( Refused Classification, RC ), comme par exemple les contenus montrant des scènes de sexe, de toxicomanie, de crime, de cruauté, de violence ou des phénomènes révoltants ou odieux enfreignant les normes de moralité, de décence et de bienséance généralement admises par des adultes raisonnables, les contenus dépeignant de façon offensante une personne qui est ou semble être un mineur de moins de 18 ans (en particulier, les contenus pédopornographiques) ou encore les contenus incitants au crime ou à la violence ;

- la « classe 2 » est elle-même subdivisée en deux sous-catégories, à savoir la classe 2A comprenant les contenus classés « X18+ » (montrant des scènes d'activité sexuelle non simulée entre adultes consentants, c'est-à-dire de la pornographie dite « mainstream »), et la classe 2B comprenant des contenus classés « R18+ » (représentations d'activités sexuelles simulées, de nudité, de violence ou de consommation de drogue) 32 ( * ) , en vertu du système de classification nationale. Les contenus de classe 2 sont considérés comme inappropriés pour le grand public et/ou pour les enfants et adolescents de moins de 18 ans. Les films et vidéos classés X18+ sont interdits à la vente et à la location dans tous les États australiens, à l'exception du Territoire de la Capitale australienne (Canberra) et du Territoire du Nord 33 ( * ) . Dans tous les États, le fait de regarder des contenus pornographiques en ligne n'est cependant pas répréhensible pour les adultes.

Le ministre compétent en matière de télécommunications peut adopter des « attentes minimales en matière de sécurité en ligne » ( Basic Online Safety Expectations, Online Safety Act, Part 4 ) précisant les attentes à l'égard des fournisseurs de services sur Internet. Il est notamment attendu que ceux-ci « adoptent des mesures raisonnables pour minimiser l'accès à des contenus de classe 1 (...) » et, s'agissant des contenus de classe 2, « pour s'assurer que des mesures technologiques ou d'une autre nature sont mises en place pour restreindre l'accès des enfants à ces contenus » 34 ( * ) . La loi ne rend pas obligatoire la mise en place d'un système de restriction d'accès ou de vérification de l'âge pour les contenus de classe 2, ni ne prescrit de solution technique spécifique mais attend que les entreprises du numérique concernées adoptent des mesures minimales 35 ( * ) . De plus, elle donne au commissaire à la sécurité en ligne le pouvoir d'ordonner la mise en place d'un système d'accès restreint pour des contenus de classe 2B (c'est-à-dire inappropriés pour les moins de 18 ans) hébergés en Australie (cf. infra ).

2. L'adoption de codes de conduite par l'industrie

Dans le modèle australien, la restriction de l'accès aux contenus pornographiques en ligne passe principalement par la co-régulation entre les acteurs privés et les autorités gouvernementales. La loi sur la sécurité en ligne ( Part 9, Division 7 ) exige que les différentes branches de l'industrie numérique 36 ( * ) élaborent et adoptent de nouveaux codes de conduite pour prévenir ou limiter la diffusion de contenus potentiellement dangereux. Les codes de conduite et standards préexistants, adoptés en application de la loi sur les services audiovisuels de 1992, étaient en effet considérés comme dépassés, trop limités dans leur champ d'application et mal ou insuffisamment mis en oeuvre 37 ( * ) .

Ces codes de conduite doivent être enregistrés auprès du commissaire pour la sécurité en ligne eSafety . Les associations d'entreprises peuvent adopter une approche graduelle consistant à adopter d'abord le code relatif aux contenus les plus dangereux (classe 1) d'ici juillet 2022, puis les codes relatifs aux contenus inappropriés pour les enfants (classe 2) d'ici décembre 2022 38 ( * ) .

Suivant une approche fondée sur l'obligation de résultat plutôt que sur l'obligation de moyens, la loi sur la sécurité en ligne ne prescrit pas le contenu des codes de conduite mais fournit une longue liste d'exemples des questions pouvant y être traitées. Celles-ci entrent globalement dans trois catégories : i) les mesures visant à créer et maintenir un environnement en ligne sûr, ii) les mesures visant à donner les moyens aux usagers de gérer l'accès aux contenus de classe 1 et de classe 2 et iii) les mesures relatives à la transparence et à la responsabilité.

Le commissaire à la sécurité en ligne eSafety a publié onze recommandations, à l'aune desquelles il procède à l'enregistrement des codes de conduite, ainsi que des modèles de codes et des exemples de mesures attendues pour atteindre les résultats fixés. Dans la mesure du possible, les codes doivent « donner aux adultes australiens l'autonomie et le contrôle sur le contenu en ligne auquel ils peuvent accéder, qu'ils peuvent créer et partager » 39 ( * ) .

Les recommandations de

eSafety

pour

l'élaboration des codes de conduite

par l'industrie du

numérique

Contenu des codes

1. Les codes traitent des problèmes d'accès, d'exposition et de distribution des contenus de classe 1 et de classe 2.

2. L'application des codes ne doit pas être limitée aux services fournis à partir de l'Australie.

Conception des codes

3. Les associations de l'industrie élaborent un ensemble de principes de rédaction communs afin de faciliter l'élaboration des codes.

4. Les codes adoptent une approche réglementaire fondée sur les résultats et les risques, soutenue par des mesures de mise en conformité claire, s'appliquant aux acteurs de l'industrie dont les services ou appareils présentent le plus grand risque en ce qui concerne les contenus de classe 1 et de classe 2.

Élaboration des codes

5. Les associations de l'industrie préparent tous les codes pour un enregistrement d'ici juillet 2022 ou adoptent une approche progressive dans l'élaboration des codes. Dans le cadre de l'approche progressive, les codes traitant des contenus les plus dangereux doivent être déposés d'ici juillet 2022 et ceux traitant des contenus inappropriés pour les enfants d'ici décembre 2022.

6. Les associations de l'industrie limitent le nombre de codes élaborés.

Enregistrement des codes

7. Les associations de l'industrie s'engagent largement dans un dialogue avec les entreprises des branches du secteur afin de s'assurer qu'elles représentent de façon adéquate chaque branche couverte par un code.

8. Les associations de l'industrie mènent des consultations significatives auprès de l'industrie et du public.

9. Les associations de l'industrie engagement un dialogue avec eSafety tout au long du processus d'élaboration des codes.

Conformité et mise en oeuvre

10. Les participants de l'industrie traitent en premier ressort les rapports et les plaintes concernant les contenus de classe 1 et de classe 2 et la conformité aux codes. eSafety agira comme un « filet de sécurité » si la résolution d'une plainte n'est pas satisfaisante.

11. Les codes incluent une clause de révision (par exemple, 12 mois après leur adoption, puis tous les trois ans).

Source : eSafety, Industry Codes position paper, 2021

Concernant les moyens pour prévenir l'accès ou l'exposition des enfants à des contenus de classe 2 (dont les contenus pornographiques), eSafety cite les mesures suivantes : la mise en place de systèmes de vérification de l'âge, l'activation par défaut de paramètres de sécurité comme le mode de recherche sécurisée ou des procédures d'évaluation des risques et des impacts sur la sécurité qui tiennent spécifiquement compte des utilisateurs de moins de 18 ans. Pour ce qui concerne les hébergeurs de contenus de classe 2 en Australie , eSafety évoque comme mesures la conclusion de contrats avec les clients stipulant les exigences d'hébergement, la mise en place de fonctionnalités de signalement et de technologies de « hachage » 40 ( * ) efficaces.

Les entreprises du numérique sont responsables de la mise en oeuvre des codes de conduite et doivent traiter en premier ressort les plaintes des usagers. eSafety peut également recevoir des plaintes et enquêter sur d'éventuelles violations des codes (cf. infra).

Parallèlement, eSafety encourage les entreprises à adopter de façon volontaire l'initiative « sécurité par la conception » (Safety by Design initiative ) qui leur permet d'évaluer les risques pour la sécurité de leurs utilisateurs et, le cas échéant, leur propose des moyens pour améliorer celle-ci 41 ( * ) .

3. Les pouvoirs du commissaire à la sécurité en ligne « eSafety »

Créé en 2015, initialement uniquement pour les enfants, le commissaire à la sécurité en ligne eSafety est une agence gouvernementale indépendante spécifiquement dédiée à la sécurité en ligne. Son champ de compétences fut étendu aux adultes en 2017 et ses pouvoirs ont été significativement renforcés par la loi sur la sécurité en ligne de 2021. Outre ses rôles de coordination et de conseil auprès des entreprises et des citoyens, eSafety gère quatre mécanismes de plainte ou de signalement de contenus préjudiciables en ligne :

- un mécanisme anti-harcèlement en ligne ( cyberbullying ) pour les Australiens âgés de moins de 18 ans ;

- un mécanisme de plainte contre les abus en ligne ouvert aux adultes (nouvellement créé par la loi sur la sécurité en ligne de 2021) ;

- un mécanisme de plainte concernant les images intimes mises en ligne sans le consentement de la personne ( image-based abuse ) ;

- et un mécanisme de signalement et d'enquête concernant les contenus en ligne illégaux et restreints potentiellement dangereux (contenus de classe 1 et de classe 2).

Concernant les contenus illégaux et restreints, eSafety dispose de trois moyens gradués de mise en conformité ( Online Safety Act , Part 9, Divisions 3-4 ). L'agence peut émettre :

- des notifications informant les fournisseurs de services en ligne (réseaux sociaux ou autre service sur Internet) que eSafety a connaissance de la diffusion de contenus illégaux ou restreints, de classe 1 (contenus interdits), de classe 2A (pornographie sans violence) ou de classe 2B (contenus présentant des scènes de nudité, violence ou de drogue inappropriés pour les moins de 18 ans), à deux reprises ou plus au cours des douze derniers mois. Ces notifications ont un caractère informel et l'absence de réponse par les entreprises concernées n'entraîne aucune pénalité ;

- des demandes de retrait ( removal notice ) pour les contenus de classe 1 ou de classe 2A. Ces avis sont émis à la discrétion d' eSafety et peuvent être adressés au fournisseur ou à l'hébergeur de services en ligne. L'absence de mise en conformité, dans les 24 heures ou dans un délai plus long précisé par eSafety , peut entraîner une amende pouvant aller jusqu'à 500 unités de pénalités (111 000 dollars australiens, soit 74 495 euros) ;

- des demandes de mesure correctrice ( remedial notice ) exigeant de la part du fournisseur de service ou de l'hébergeur de prendre toutes les mesures nécessaires pour retirer les contenus de classe 2B disponibles sur son service ou mettre en place un système d'accès restreint, dans un délai de 24 heures ou plus défini par eSafety . La loi sur la sécurité en ligne de 2021 donne à eSafety le pouvoir de déterminer ce que constitue un système d'accès restreint. L'agence a publié sa décision en la matière en janvier 2022 42 ( * ) . En cas de non-respect de la décision, l'entreprise est passible d'une amende pouvant s'élever jusqu'à 500 unités de pénalités.

La définition des « systèmes

d'accès restreint »

(

Restricted Access

Systems

)

En application de la loi sur la sécurité en ligne, eSafety a adopté, en janvier 2022, une décision précisant les exigences minimales pour qu'un système soit reconnu comme un système d'accès restreint en vertu de la loi australienne :

« Le système de contrôle d'accès doit :

- exiger une demande d'accès au contenu et une déclaration du demandeur attestant qu'il est âgé d'au moins 18 ans ; et

- fournir des avertissements quant à la nature du contenu ; et

- fournir des informations de sécurité aux parents et aux tuteurs sur la manière de contrôler l'accès au contenu ; et

- intégrer des mesures raisonnables pour confirmer qu'un demandeur est âgé d'au moins 18 ans ; et

- limiter l'accès au contenu à moins que certaines étapes ne soient respectées, ce qui peut inclure l'utilisation d'un code PIN . »

Source : Online Safety (Restricted Access Systems) Declaration 2022

La loi sur la sécurité en ligne de 2021 donne également à eSafety le pouvoir de prononcer des demandes de suppression de liens ou de suppression d'applications donnant accès à des contenus de classe 1 (illicites), et ce, y compris pour les contenus diffusés ou hébergés depuis l'étranger et accessibles à des Australiens, ce qui constitue une nouveauté.

La portée des pouvoirs du commissaire à la sécurité en ligne concernant les contenus pornographiques (2A) ou inappropriés pour les moins de 18 ans (2B) est plus limitée. Les demandes de retrait ou mesures correctrices relatives à ce type de contenus ne peuvent concerner que les services fournis à partir de l'Australie 43 ( * ) . Les sites internet ou services fournis depuis l'étranger ne sont pas concernés.

Selon le rapport annuel d'activité de eSafety pour 2020-2021, l'action de l'agence s'est concentrée sur les contenus illicites (classe 1), en particulier ceux à caractère pédopornographique 44 ( * ) (14 633 enquêtes réalisées en 2020-2021 pour des contenus de classe 1, dont 98 % présentant des scènes d'abus sexuel d'enfants) 45 ( * ) . À la suite de ces enquêtes, il a été mis en évidence que deux contenus étaient hébergés en Australie, ce qui a donné lieu à une demande de retrait. Les autres contenus potentiellement interdits hébergés à l'étranger sont notifiés aux fournisseurs de filtres parentaux (appartenant au Family Friendly Filter scheme ) afin que l'accès à ces contenus soit bloqué pour les utilisateurs des filtres. Les contenus à caractère plus grave sont signalés aux forces de l'ordre. En revanche, le rapport ne fait pas état de décisions ou d'enquêtes d' eSafety concernant des contenus pornographiques en 2020-2021.

B. LE PROJET D'INTRODUCTION D'UN SYSTÈME DE VÉRIFICATION DE L'ÂGE POUR LA PORNOGRAPHIE

La loi sur la sécurité en ligne de 2021 ne prévoit pas l'introduction obligatoire d'un système de vérification de l'âge pour les contenus pornographiques. Cette question avait été débattue lors des travaux préparatoires au projet de loi. Le gouvernement avait néanmoins conclu que des analyses plus approfondies étaient nécessaires pour mettre en oeuvre un tel système en Australie 46 ( * ) .

Dans une contribution remise en novembre 2019 à la Chambre des Représentants, le commissaire à la sécurité en ligne eSafety avait recommandé de développer au préalable un écosystème numérique adéquat et d'adopter une approche proportionnée 47 ( * ) . « La vérification de l'âge est une solution possible pour traiter et minimiser l'accès des enfants et des jeunes à la pornographie en ligne. Cependant, pour résoudre efficacement le problème, il faudra une combinaison et une superposition de solutions technologiques » 48 ( * ) , comme le filtrage, le blocage par les fournisseurs d'accès à Internet, la sécurisation des réseaux Wifi ou des fonctionnalités de recherche sécurisée au sein des plateformes de contenus.

En mars 2020, la commission de la politique sociale et des affaires juridiques de la Chambre des Représentants a rendu un rapport, intitulé Protéger l'âge de l'innocence , sur la vérification de l'âge pour les paris et la pornographie en ligne 49 ( * ) . Dans ce rapport, les députés recommandent au gouvernement de charger le commissaire à la sécurité en ligne eSafety de l'élaboration rapide d'une feuille de route pour la mise en oeuvre d'un système obligatoire de vérification de l'âge. Cette recommandation a été soutenue par le gouvernement qui a officiellement demandé à eSafety , en juin 2021, de préparer cette feuille de route 50 ( * ) .

L'agence eSafety a réalisé, entre novembre 2021 et février 2022, une première phase de consultation de l'ensemble des parties prenantes (industries du divertissement pour adultes et du travail du sexe, plateformes et services en lignes, fournisseurs d'accès à Internet, chercheurs, ONG de défense du bien-être des enfants, de défense des droits numériques etc.) et lancé un appel à témoins 51 ( * ) . Ces travaux devraient s'achever en décembre 2022 avec la remise du rapport final au gouvernement. Selon la presse, les principales options technologiques envisagées par eSafety seraient les technologies de reconnaissance faciale et le programme d'identité numérique développé par l'Agence fédérale de transformation numérique ( Digital Transformation Agency (DTA) ) 52 ( * ) . Ce programme intitulé Trusted Digital Identity Framework (TDIF), déjà utilisé pour l'accès aux sites et services gouvernementaux, est actuellement en cours d'expérimentation pour restreindre l'accès aux jeux et à la vente d'alcool en ligne aux plus de 18 ans 53 ( * ) .

* 28 https://www.esafety.gov.au/about-us/who-we-are

* 29 https://www.legislation.gov.au/Details/C2021A00076

* 30 Ces dispositions abrogent les annexes 5 et 7 du Broadcasting Services Act de 1992.

* 31 Le National Classification Scheme est un accord de coopération entre le gouvernement australien et les gouvernements des États et des territoires.

* 32 Les contenus de classe 2B incluent certains contenus pornographiques mais embrassent des types de contenus plus variés.

* 33 https://www.classification.gov.au/classification-ratings/what-do-ratings-mean#MA

* 34 Online Safety Act, Part 4, Division 2, Section 46.

* 35 Afin de tenir compte des Basic Online Safety Expectations de la loi, l'entreprise Google a annoncé en mars 2022 son intention d'exiger la présentation d'une pièce d'identité ou d'une carte de crédit de la part des utilisateurs de YouTube et de GooglePlay tentant d'accéder à certains contenus pour adultes en Australie.

https://www.itnews.com.au/news/google-rolling-out-age-verification-on-youtube-play-store-in-australia-577499

* 36 À savoir les fournisseurs de réseaux sociaux, boîtes de messagerie électronique, messagerie instantanée, jeux, services de rencontres, moteurs de recherche, fournisseurs d'applications, fournisseurs d'accès à Internet, hébergeurs de sites ainsi que les fabricants et fournisseurs d'équipements utilisés pour accéder aux services en ligne.

* 37 Lynelle Briggs AO, Report of the Statutory Review of the Enhancing Online Safety Act 2015 and the Review of Schedules 5 and 7 to the Broadcasting Services Act 1922 (Online Content Scheme), October 2018,

https://www.infrastructure.gov.au/sites/default/files/briggs-report-stat-review-enhancing-onlinesafety-act2015.pdf.

* 38 eSafety Commissioner, Development of Industry codes under the Online Safety Act, September 2021, https://www.esafety.gov.au/sites/default/files/2021-09/eSafety%20Industry%20Codes%20Position%20Paper.pdf

* 39 Ibid.

* 40 Utilisées en informatique et en cryptographie, les fonctions de hachage permettent, à partir d'une donnée fournie en entrée, de calculer une empreinte numérique servant à identifier rapidement la donnée initiale.

* 41 https://www.esafety.gov.au/industry/safety-by-design

* 42 Online Safety (Restricted Access Systems) Declaration 2022,

https://www.legislation.gov.au/Details/F2022L00032/Explanatory%20Statement/Text

* 43 Pour vérifier si cette condition est remplie, eSafety prend en compte différents facteurs comme l'hébergement du site en Australie ou l'inscription du fournisseur de services au registre des entreprises australiennes.

* 44 Dans le cadre du réseau International Association of Internet Hotlines (INHOPE) qui a pour but de combattre la diffusion d'images présentant des scènes d'abus sexuel des enfants.

* 45 https://www.esafety.gov.au/sites/default/files/2021-10/ACMA%20and%20eSafety%20annual%20report%202020-21_0.pdf

* 46 Online Safety Bill 2021, Explanatory memorandum, p. 39,

https://parlinfo.aph.gov.au/parlInfo/download/legislation/ems/r6680_ems_3499aa77-c5e0-451e-9b1f-01339b8ad871/upload_pdf/JC001336%20Clean4.pdf;fileType=application%2Fpdf

* 47 https://www.aph.gov.au/DocumentStore.ashx?id=2c35bb2c-4a68-428b-af67-cf05ff17052e&subId=673265

* 48 Ibid.

* 49 https://www.aph.gov.au/Parliamentary_Business/Committees/House/Social_Policy_and_Legal_Affairs/Onlineageverification/Report

* 50 Australian Government response to the House of Representatives Standing Committee on Social Policy and Legal Affairs report “Protecting the Age of Innocence”,

https://www.aph.gov.au/Parliamentary_Business/Committees/House/Social_Policy_and_Legal_Affairs/Completed_inquiries

* 51 https://www.esafety.gov.au/about-us/consultation-cooperation/age-verification

* 52 https://www.lismorecitynews.com.au/story/7596265/hushed-talks-over-expansion-of-age-checks-for-online-pornography/

* 53 https://www.canberratimes.com.au/story/7445505/mastercard-joins-up-with-govt-digital-agency-for-age-verification-push/