B. UN CONSERVATISME JURIDIQUE LOURD DE CONSÉQUENCES

1. La question du rôle de la CNIL

À la méfiance de l'opinion et des responsables politiques répond un conservatisme juridique des autorités chargées de la protection des données personnelles. La question du rôle de la CNIL , en particulier, est revenue constamment au fil des auditions conduites pour le présent rapport.

Précisons d'emblée qu' il ne s'agit en aucun cas de reprocher à la CNIL de faire son travail, et encore moins de remettre en cause le cadre juridique fixé par la loi Informatique et libertés de 1978 81 ( * ) et le règlement général sur la protection des données (RGPD) de 2016 82 ( * ) , dont les grands principes (cf. encadré) sont particulièrement nécessaires en période de crise sanitaire . En effet, les traitements de données que celle-ci impose portent sur des données médicales, qui constituent des « données sensibles » au sens du RGPD, et bénéficient à ce titre d'une protection particulière. La CNIL a rendu un avis sur tous les décrets relatifs aux fichiers « Covid » (SI-DEP, VAC-SI, etc.), et ses observations ont été très largement suivies.

Les 5 grands principes

de la protection des

données personnelles

1) Le principe de finalité : le responsable d'un fichier ne peut enregistrer et utiliser des informations sur des personnes physiques que dans un but bien précis, légal et légitime ;

2) Le principe de proportionnalité : les informations enregistrées doivent être pertinentes et strictement nécessaires au regard de la finalité du fichier. Ce principe de proportionnalité ( existe-t-il un moyen moins intrusif ? ) comprend notamment le principe de nécessité ( quelle utilité sanitaire ? ) et le principe de minimisation ( seules les données nécessaires à la gestion de la crise sanitaire doivent être collectées ) ;

3) Le principe de durée de conservation limitée : il n'est pas possible de conserver des informations sur des personnes physiques dans un fichier pour une durée indéfinie, afin d'éviter tout détournement ultérieur de ses finalités. Une durée de conservation précise doit être fixée, en fonction du type d'information enregistrée et de la finalité du fichier ;

4) Le principe de sécurité et de confidentialité : le responsable du fichier doit garantir la sécurité et la confidentialité des informations qu'il détient, et veiller en particulier à ce que seules les personnes autorisées y aient accès ;

5) Les droits des personnes , en particulier le droit d'accès aux données les concernant et le droit de rectification .

Source : CNIL

En revanche, on peut légitimement s'interroger sur l'interprétation conservatrice que la CNIL fait de ces principes, en particulier du principe de proportionnalité, et surtout dans un contexte de crise, alors qu'il apparaît que des traitements de données plus intrusifs pour les individus, mais aussi plus limités dans le temps , auraient pu permettre de sauver des vies et d'alléger les restrictions imposées à la société dans son ensemble.

La remarque est d'autant plus valable que d'autres pays européens , soumis comme la France au RGPD, n'en font pas une interprétation aussi restrictive, et bénéficient ainsi d'outils numériques qui se révèlent précieux dans le contexte actuel - sans même parler des pays, asiatiques notamment, qui n'y sont pas soumis.

Les propos tenus par Gilles Babinet, co-président du Conseil national du numérique (CNNum) , lors de son audition publique par la délégation à la prospective 83 ( * ) , font ainsi écho à de nombreuses remarques formulées lors des auditions des rapporteurs : « enfin, je veux dire ici clairement que la CNIL est sortie du cadre réglementaire qui s'impose à elle, et qu'elle est un facteur de retard pour notre pays . Son contrôle parlementaire est insuffisant. Elle est une institution nécessaire, mais pas sous cette forme. Le problème n'est pas au niveau du collège mais au niveau de son personnel administratif, qui n'est pas contrôlé et qui prend systématiquement le parti du principe de précaution absolue ».

S'agissant de la réponse à la crise sanitaire actuelle et à celles à venir, les deux principaux exemples du rôle problématique de la CNIL sont :

- d'une part, son opposition à l'identité numérique unique, et même à l'identifiant national de santé jusqu'à ce que la loi de 2019 vienne remettre en cause cette doctrine, déjà évoquée dans la partie précédente ;

- d'autre part, son opposition à toute solution contact tracing qui permette une identification, une localisation ou des recoupements avec d'autres données de santé , compromettant par là-même son efficacité, comme cela sera détaillé dans la partie suivante (au sujet de l'application TousAntiCovid ).

S'agissant du « pass sanitaire » , dans sa forme « domestique » pour accéder à certains lieux ou comme document de voyage international, le laboratoire d'innovation numérique de la CNIL (LINC), son service de d'études prospectives, s'est très tôt montré réticent à l'égard de ce qu'il qualifie de « totem à risques » dans un article de mai 2020 84 ( * ) . Les avancées européennes en la matière, puis les récents arbitrages du Gouvernement, ont conduit le collège de la CNIL à adopter une position finalement différente, mais avec des réticences de principe qui demeurent entières.

Au-delà de ces exemples principaux, on peut notamment citer les autres sujets suivants :

- l'usage de la vidéo avec les caméras intelligentes et les drones ;

- l'accès aux données par les chercheurs en cette période de crise.

2. Des caméras trop « intelligentes » ?

L'utilité des caméras dites « intelligentes » dans le cadre de la lutte contre l'épidémie est apparue évidente dans de nombreux pays, y comprise européens : prise automatique de température par des caméras thermiques, détection du port du masque, mesure du respect de la distanciation ou du couvre-feu, etc. Ces dispositifs peuvent être mis en place sur la voie publique, mais aussi dans les lieux de travail ou commerces.

En France, pourtant, si la CNIL reconnaît que les objectifs assignés à ces dispositifs sont « le plus souvent légitimes », elle considère aussi et surtout que « leur développement incontrôlé présente le risque de généraliser un sentiment de surveillance chez les citoyens, de créer un phénomène d'accoutumance et de banalisation de technologies intrusives, et d'engendrer une surveillance accrue, susceptible de porter atteinte au bon fonctionnement de notre société démocratique 85 ( * ) ». Elle considère en fait que « la captation de l'image des personnes dans ces espaces » est, en elle-même, « incontestablement porteuse de risques pour les droits et libertés fondamentaux de celles-ci 86 ( * ) ».

C'est à partir de cette position de principe, qui est aussi une opposition de principe, que la CNIL procède ensuite à l'analyse juridique des dispositifs de « caméras intelligentes » envisagés en France, au cas par cas, au regard notamment des principes de nécessité et de proportionnalité 87 ( * ) .

Un encadrement textuel adéquat est en effet requis dès lors que ces dispositifs traitent de données sensibles , en l'espèce biométriques (visage) et/ou relatives à l'état de santé (température corporelle), ou qu'ils ne permettent pas toujours l'exercice effectif du droit d'opposition (du fait du « balayage vidéo » par une caméra située dans la rue ou dans le métro, etc.). Or, d'une manière générale, la CNIL a estimé « nécessaire d'alerter sur le fait que, sous réserve d'une analyse au cas par cas, il lui apparaît qu' une grande partie de ces dispositifs ne respecte pas le cadre légal applicable à la protection des données personnelles 88 ( * ) ».

En pratique, la CNIL a donc considéré que ni les circonstances (la crise sanitaire), ni les garanties apportées par les dispositifs eux-mêmes , n'étaient suffisantes pour justifier leur emploi - alors que d'autres pays arrivaient à la conclusion inverse.

Par exemple, en mai 2020, la RATP a expérimenté l'usage de caméras de détection du port du masque , avec six caméras à la station Châtelet-Les Halles, avant d'y renoncer moins de deux mois plus tard, en raison de l'opposition de la CNIL , laquelle considérait que toute captation d'image constituait par définition un traitement de données biométriques et comportait par définition un risque d'identification.

Pourtant, les caméras en question ne conservaient strictement aucune image, et ne transmettaient que des statistiques agrégées de taux de port du masque , une fois toutes les 15 minutes. Le seul traitement de données, effectué localement (sur la caméra), consistait à comparer l'image prise avec une image témoin portant un masque - afin, concrètement, de détecter ou non un « rectangle blanc », et de mesurer jour après jour l'évolution du port du masque dans les transports en commun. Aucun traitement biométrique n'a lieu en dehors de la caméra elle-même, et aucun algorithme de reconnaissance faciale n'est mise en oeuvre, et aucune identification des personnes, même indirecte, n'est possible .

S'agissant de l'usage des caméras thermiques , largement répandu dans le monde pour détecter le Covid-19, la CNIL s'y est opposée au motif que la fièvre n'est pas un symptôme systématique de la maladie 89 ( * ) : le dispositif présente ainsi « le risque de ne pas repérer des personnes infectées puisque certaines sont asymptomatiques et qu'il peut, en outre, être contourné par la prise de médicaments antipyrétiques (qui réduisent la température corporelle sans traiter les causes de la fièvre) ». Ce qui revient à dire qu'il vaudrait mieux ne rien détecter plutôt que de détecter certains cas seulement .

3. Les drones ou le floutage juridique

Les mêmes remarques s'appliquent à l'usage des drones équipés de caméras , auxquels les forces de l'ordre ont eu recours à plusieurs reprises, dès mars 2020, pour contrôler le respect du confinement : repérage de la présence de contrevenants potentiels sur la voie publique, diffusion de consignes par haut-parleurs, etc. Cet usage des drones à des fins de police sanitaire a notamment été mis en oeuvre par la préfecture de Police, par le commissariat de Cergy-Pontoise, et par le groupement de gendarmerie départemental de Haute-Garonne.

Toutefois le 12 janvier 2021, à l'issue d'une procédure de contrôle initiée en mai 2020, la CNIL a sanctionné le ministère de l'Intérieur pour avoir utilisé ces drones « en dehors de tout cadre légal » , assortissant cette sanction d'une mesure de publicité et d'une injonction à cesser « l'utilisation des drones par l'ensemble des forces de l'ordre dès lors qu'elles agissent sous l'autorité du ministère, qu'il s'agisse de services de police ou de gendarmerie, sur l'ensemble du territoire, et quelles que soient les finalités poursuivies ».

Le raisonnement de la CNIL se fonde sur le fait que le pilote du drone est susceptible d'identifier les personnes 90 ( * ) : « en juillet 2020, la CNIL s'est rendue dans les locaux de la préfecture de police de Paris et a fait procéder à un vol d'essai d'un des drones utilisés pour les finalités précitées. À cette occasion, elle a constaté que les personnes filmées par ce type de dispositif étaient susceptibles d'être identifiées ». Cette possibilité d'identifier les personnes entraîne la qualification de traitement de données à caractère personnel - lequel n'a donc, en l'espèce, pas été autorisé. A fortiori , il n'a pas fait l'objet d'une étude d'impact, et ne permet pas l'information du public.

Toutefois, et sans entrer dans le détail d'un sujet qui excède largement le cadre du présent rapport, on pourra relever que :

- d'une part, la qualification de traitement de données à caractère personnel n'avait rien d'évident : depuis 2011, la jurisprudence constante du Conseil d'État réservait cette qualification aux dispositifs donnant à la fois lieu à enregistrement et conservation des images et à la possibilité d'identifier les personnes, ce qui n'était pas le cas des drones. Ce n'est que dans son référé du 18 mai 2020 que le Conseil d'État a considéré que l'usage de drones constituait, au cas d'espèce, un traitement de données à caractère personnel au sens du RGPD. Le juge des référés enjoignait dès lors l'État à « cesser, sans délai, de procéder aux mesures de surveillance par drone, du respect, à Paris, des règles de sécurité sanitaire », la seule possibilité de zoomer créant un risque de traiter des données personnelles, et donc une atteinte « grave et manifestement illégale au droit au respect de la vie privée », quand bien même aucune exploitation ne serait faite de ces données individuelles ;

- d'autre part, cette qualification juridique aboutit à une impasse opérationnelle , non seulement dans le cadre de la crise sanitaire, mais aussi pour l'ensemble des cas d'usage de drones par les forces de l'ordre. En effet, le juge des référés avait ouvert la voie à la reprise des opérations par drone, assortie de mesures techniques (floutage des images) permettant de ne plus qualifier ces opérations de traitements de données à caractère personnel. Toutefois, la CNIL, dont l'avis s'étend à un périmètre beaucoup plus large, a considéré que le mécanisme de floutage mis en oeuvre à partir du mois d'août n'était pas suffisant, car des images non floutées sont transmises par le drone à son pilote en direct , c'est-à-dire avant traitement par le logiciel de floutage, qui n'est pas installé sur la caméra du drone mais sur les équipements de la préfecture. Il n'est pourtant pas possible d'aller au-delà, les règles de sûreté aérienne étant par nature incompatibles avec un floutage en direct , qui remettrait en cause la maîtrise de son aéronef par le télépilote. Du reste, quand bien même des logiciels embarqués permettraient de réaliser un floutage dès la captation, ceux-ci nécessiteraient une puissance de calcul obligeant à équiper les drones de batteries bien plus volumineuses, entraînant de facto l'impossibilité de les utiliser en milieu urbain de façon sécurisée 91 ( * ) .

Résumons : un raisonnement juridique, dont l'objectif ultime est d'empêcher qu'un pilote puisse fortuitement reconnaître une personne dans une foule, sans pour autant enregistrer la moindre image, conduit à interdire tout usage des drones par les forces de l'ordre , alors qu'il s'agit d'une nécessité opérationnelle évidente que ni le juge ni l'administration ne contestent, et ceci bien au-delà de la seule crise sanitaire ou même du maintien de l'ordre 92 ( * ) . En effet, pour rester dans le champ du présent rapport, les drones présentent un intérêt évident pour le secours aux personnes (par exemple pour intervenir rapidement en cas de catastrophe, localiser les victimes et réaliser une cartographie).

Le référé du Conseil d'État et la décision de la CNIL ont conduit le Gouvernement à privilégier l'élaboration d'un cadre juridique général pour l'emploi des drones par les forces de l'ordre, au sein du projet de loi pour une sécurité globale préservant les libertés. En dépit d'améliorations apportées par le Sénat, le dispositif a toutefois été censuré par le Conseil constitutionnel . Comme le constatent les rapporteurs du projet de loi 93 ( * ) , « le Conseil constitutionnel a de fait interdit l'usage des drones par les forces de sécurité intérieure (article 47) pour plusieurs finalités légitimes et laisse, pour le moment, entière la question du régime permettant aux policiers, gendarmes et policiers municipaux mais aussi aux pompiers de recourir à ces équipements nécessaires ».

4. L'autorisation des projets de recherche

Dès le début de la crise sanitaire, de nombreux projets de recherche ont été lancés , non seulement dans le domaine médical , afin de mieux connaître le Covid-19, mais aussi dans le domaine des sciences économiques et sociales , afin par exemple de mesurer l'impact de la crise sur les inégalités ou d'évaluer le respect des mesures de distanciation ou de confinement. Ces travaux ont une importance fondamentale : ils permettent non seulement de faire progresser la médecine , mais aussi d' éclairer la décision publique et d'accroître la confiance des citoyens - qu'il s'agisse de justifier les restrictions et leur durée, ou d'organiser au mieux les campagnes de dépistage et de vaccination.

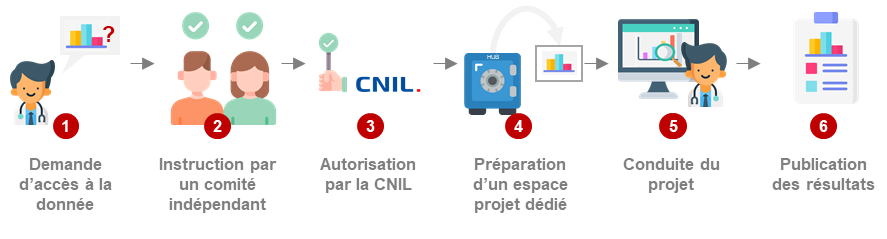

Or de nombreux projets dépendent de l'accès aux données à une maille relativement fine, le cas échéant individuelle , ce qui implique le traitement de données personnelles, y compris de nature médicale. L'accès aux données peut désormais se faire via le Health Data Hub , sous une forme pseudonymisée (cf. supra ). En matière de santé, tout projet de recherche doit auparavant faire l'objet d'une double autorisation , par le Comité éthique et scientifique pour les recherches, les études et les évaluations dans le domaine de la santé (CESREES) d'abord, et par la CNIL ensuite, qui dispose de deux mois renouvelables pour répondre. La seule constitution des dossiers peut demander plusieurs mois aux chercheurs, et aucune procédure allégée n'est prévue pour le renouvellement d'un accès à la même base par un même chercheur.

Dans son point d'étape de novembre 2020, la CNIL indique s'être « mobilisée pour instruire en priorité, dans des délais extrêmement courts, (...) parfois en quelques heures, (...) les demandes d'autorisation déposées (...) portant sur la Covid-19 ». Tel ne semble pas être l'avis de la mission Bothorel , dont le rapport évoque notamment le cas d'une chercheuse en sciences sociales qui avait formulé une demande d'accès aux données pseudonymisées de SI-VIC et SI-DEP via le Health Data Hub afin d'étudier le profil social des personnes infectées sur une zone géographique la plus fine possible. Six mois après sa demande, effectuée en avril 2020, son dossier était toujours en constitution auprès de la CNIL.

Il est toutefois délicat de tirer des conclusions générales d'un exemple individuel. Aussi se bornera-t-on à souligner que la procédure d'autorisation, assez lourde, demeure de toute façon peu adaptée à une « recherche de crise » . D'après la mission Bothorel, en novembre 2020, la CNIL avait autorisé 19 des 52 demandes relatives au Covid-19. Parmi les projets autorisés, seuls deux prévoient une utilisation du Health Data Hub , et ont été traités en respectivement 45 et 47 jours. Pour les autres, le délai moyen est de 20 jours, avec un maximum de 88 jours. Les choses semblent toutefois s'être améliorées : dans son rapport annuel publié le 18 mai 2021, la CNIL indique ainsi avoir accordé 89 autorisations de recherches sur le Covid-19, dont 45 % traitées en moins de deux jours et 63 % en moins d'une semaine.

À vrai dire, s'agissant du Health Data Hub , la CNIL s'est surtout distinguée par son opposition au projet 94 ( * ) , en raison du choix de Microsoft comme prestataire d'hébergement, faute d'une solution européenne, ce qui implique de potentiels transferts de données aux États-Unis et donc un accès direct par les autorités américaines. Si le Conseil d'État a finalement validé ce choix, la CNIL indique qu'elle « restera vigilante », compte tenu notamment de la décision « Schrems II » de la Cour de justice de l'Union européenne du 16 juillet 2020. Lors de son audition par la délégation à la prospective, Gilles Babinait déclarait : « je rappelle que le choix de Microsoft comme prestataire est conforme à la loi. Le Conseil d'État a désavoué la CNIL sur ce point. (...) Le Health Data Hub a pris beaucoup de précautions sur les données confiées à ses algorithmes. (...) Je constate une instrumentalisation politique du sujet qui a surtout montré l'ignorance des personnes qui se sont engagées contre le Health Data Hub . J'ai défendu cet avis de façon très claire et je continuerai à le défendre ».

* 81 Loi n° 78-17 du 6 janvier 1978 relative à l'informatique, aux fichiers et aux libertés. Son article 6 prévoit que les informations collectées doivent être adéquates, pertinentes et non excessives au regard de la finalité poursuivie.

* 82 Règlement (UE) 2016/679 du Parlement européen et du Conseil du 27 avril 2016 relatif à la protection des personnes physiques à l'égard du traitement des données à caractère personnel et à la libre circulation de ces données (RGPD).

* 83 Audition de Gilles Babinet, co-président du Conseil national du numérique, digital champion de la France auprès de la Commission européenne, le 18 mars 2021.

* 84 Régis Chatelier, « Le passeport d'immunité : un totem à risques », LINC, 5 mai 2020, https://linc.cnil.fr/fr/passeport-dimmunite-un-totem-risques

* 85 Caméras dites « intelligentes » et caméras thermiques : les points de vigilance de la CNIL et les règles à respecter , 17 juin 2020 : https://www.cnil.fr/fr/cameras-dites-intelligentes-et-cameras-thermiques-les-points-de-vigilance-de-la-cnil-et-les-regles . Cette situation se retrouve dans la plupart des avis et publications de la CNIL au sujet de la crise sanitaire : points d'étape, rapport annuel, etc.

* 86 La CNIL appelle à la vigilance sur l'utilisation des caméras dites « intelligentes » et des caméras thermiques , 17 juin 2020 : https://www.cnil.fr/fr/la-cnil-appelle-la-vigilance-sur-lutilisation-des-cameras-dites-intelligentes-et-des-cameras

* 87 Contrairement à la vidéoprotection, qui fait l'objet d'un encadrement législatif spécifique, l'usage des caméras « intelligentes » n'est pas aujourd'hui prévu par un texte spécifique

* 88 La CNIL appelle à la vigilance sur l'utilisation des caméras dites « intelligentes » et des caméras thermiques , 17 juin 2020 : https://www.cnil.fr/fr/la-cnil-appelle-la-vigilance-sur-lutilisation-des-cameras-dites-intelligentes-et-des-cameras

* 89 Caméras dites « intelligentes » et caméras thermiques : les points de vigilance de la CNIL et les règles à respecter , 17 juin 2020.

* 90 Avis du 12 janvier 2021 : https://www.cnil.fr/fr/drones-la-cnil-sanctionne-le-ministere-de-linterieur et https://www.legifrance.gouv.fr/cnil/id/CNILTEXT000042960768

* 91 Voir à cet égard le projet de réponse du ministère de l'Intérieur au rapporteur de la CNIL dans le cadre de la procédure de sanction. Ces éléments ont été publiés par Mediapart le 8 mai 2021 : https://www.mediapart.fr/journal/france/080521/drones-comment-gerald-darmanin-voulu-echapper-toute-sanction

* 92 Dans le cadre du maintien de l'ordre, les drones permettent en effet de faciliter la détection des mouvements de foule et de prévenir les incidents, de guider les effectifs pendant les interventions ou encore d'identifier les fauteurs de trouble. Ils peuvent également être utilisés dans le cadre de la sécurité routière.

* 93 Communiqué de presse de François-Noël Buffet, président de la commission des lois, et de Marc-Philippe Daubresse et Loïc Hervé, rapporteurs, 20 mai 2021 :

https://www.senat.fr/presse/cp20210520b.html

* 94 Voir notamment son avis du 20 avril 2020.