Rapport n° 197 (2019-2020) de M. Christophe-André FRASSA , fait au nom de la commission des lois, déposé le 11 décembre 2019

Disponible au format PDF (1,2 Moctet)

Tableau comparatif au format PDF (237 Koctets)

-

L'ESSENTIEL

-

I. LA MOBILISATION DES ACTEURS PUBLICS ET DES

INTERMÉDIAIRES TECHNIQUES CONTRE LES DISCOURS DE HAINE SUR

INTERNET

-

II. LA PROPOSITION DE LOI TRANSMISE : UNE

DIFFICILE SYNTHÈSE ENTRE OBLIGATIONS DE RÉSULTATS ET DE

MOYENS

-

A. LA PRINCIPALE DISPOSITION DU TEXTE : UNE

OBLIGATION DE RETRAIT EN 24 HEURES DES CONTENUS ODIEUX SANCTIONNÉE

PAR UN NOUVEAU DÉLIT

-

B. L'INSTAURATION D'UNE RÉGULATION

AMBITIEUSE DES PLATEFORMES : DE NOUVELLES OBLIGATIONS DE MOYENS SOUS LA

SUPERVISION DU CONSEIL SUPÉRIEUR DE L'AUDIOVISUEL

-

C. PRÉVENIR LA HAINE ET PUNIR LES

AUTEURS : DES AMÉLIORATIONS MARGINALES DE LA FORMATION ET DE

L'ORGANISATION JUDICIAIRE DE LA RÉPRESSION

-

A. LA PRINCIPALE DISPOSITION DU TEXTE : UNE

OBLIGATION DE RETRAIT EN 24 HEURES DES CONTENUS ODIEUX SANCTIONNÉE

PAR UN NOUVEAU DÉLIT

-

III. LA POSITION DE LA COMMISSION DES LOIS :

RÉÉQUILIBRER

ET MIEUX SÉCURISER JURIDIQUEMENT UN ENSEMBLE DE MESURES INÉGALEMENT ABOUTIES

-

A. DES OBJECTIFS PARTAGÉS, UN

PROBLÈME DE MÉTHODE

-

B. L'ARTICLE 1ER : UN DISPOSITIF PÉNAL

INABOUTI ET DÉSÉQUILIBRÉ AU DÉTRIMENT DE LA

LIBERTÉ D'EXPRESSION

-

C. LA RÉGULATION DES PLATEFORMES : UNE

SOLUTION PERTINENTE APPROUVÉE ET PRÉCISÉE

-

D. VIRALITÉ, FINANCEMENT,

INTEROPÉRABILITÉ : DES PROPOSITIONS COMPLÉMENTAIRES

POUR MIEUX S'ATTAQUER AUX RESSORTS PROFONDS DU PROBLÈME

-

A. DES OBJECTIFS PARTAGÉS, UN

PROBLÈME DE MÉTHODE

-

I. LA MOBILISATION DES ACTEURS PUBLICS ET DES

INTERMÉDIAIRES TECHNIQUES CONTRE LES DISCOURS DE HAINE SUR

INTERNET

-

EXAMEN DES ARTICLES

DE LA PROPOSITION DE LOI

-

CHAPITRE IER

SIMPLIFICATION DES DISPOSITIFS DE NOTIFICATION DE CONTENUS HAINEUX EN LIGNE

-

Article 1er

(art. 6 de la loi n° 2004-575 pour la confiance dans l'économie numérique)

Obligation pour les grandes plateformes de supprimer en 24 heures certains contenus manifestement illicites ; liste des contenus et répression pénale des manquements ; exercice des droits reconnus

à la partie civile par les associations de lutte contre les discriminations

-

Article 1er bis (supprimé)

Formalisme de la nouvelle procédure de notification

d'un contenu manifestement haineux

-

Article 1er ter A

(art. 6 de la loi n° 2004-575 pour la confiance dans l'économie numérique)

Simplification du formalisme des notifications prévues par la LCEN pour engager de la responsabilité des hébergeurs à raison de contenus illicites

-

Article 1er ter B

(art. 6-2 [nouveau] de la loi n° 2004-575

pour la confiance dans l'économie numérique)

Notification de contenus haineux par une association

de protection de l'enfance saisie par un mineur

-

Article 1er ter (supprimé)

Sanction des notifications abusives ou malveillantes

-

Article 1er

-

CHAPITRE II

DEVOIR DE COOPÉRATION DES OPÉRATEURS

DE PLATEFORME DANS LA LUTTE CONTRE

LES CONTENUS HAINEUX EN LIGNE

-

Article 2

(art. 6-2 et 6-3 [nouveaux] de la loi n° 2004-575

pour la confiance dans l'économie numérique)

Obligations de moyens mises à la charge des plateformes en matière de traitement des notifications de contenus haineux en ligne

-

Article 3

(art. 6-3 [nouveau] de la loi n° 2004-575

pour la confiance dans l'économie numérique)

Autres obligations de moyens mises à la charge des plateformes en matière d'information et de coopération avec les autorités

-

Article 3 bis

(art. 6 de la loi n° 2004-575 pour la confiance dans l'économie numérique)

Renforcement de l'amende pour non-coopération

avec l'autorité judiciaire en matière de lutte

contre les contenus illicites

-

Article 2

-

CHAPITRE III

RÔLE DU CONSEIL SUPÉRIEUR DE L'AUDIOVISUEL

DANS LA LUTTE CONTRE

LES CONTENUS HAINEUX EN LIGNE

-

Article 4

(art. 17-3 [nouveau], 19 et 42-7 de la loi n° 86-1067 relative à

la liberté de communication ; art. 6-1 de la loi n° 2004-575

pour la confiance dans l'économie numérique)

Nouvelles missions du CSA :

surveillance des obligations à la charge des plateformes, recommandations, pouvoirs de contrôle et de sanction ;

contrôle du blocage administratif des sites terroristes

ou pédopornographiques

-

Article 5 (suppression

maintenue)

Coopération avec l'autorité judiciaire

-

Article 4

-

CHAPITRE IV

AMÉLIORATION DE LA LUTTE CONTRE LA DIFFUSION DE CONTENUS HAINEUX EN LIGNE

-

Article 6 (supprimé)

Simplification de la procédure de blocage et

de déréférencement des sites haineux

(directement auprès des FAI, sans subsidiarité ;

sur injonction administrative contre les sites ou serveurs miroirs)

-

Article 6 bis AA (nouveau)

Obligations de transparence à la charge des régies publicitaires

-

Article 6 (supprimé)

-

CHAPITRE IV BIS

RENFORCEMENT DE L'EFFICACITÉ DE LA RÉPONSE PÉNALE À L'ÉGARD DES AUTEURS DE CONTENUS HAINEUX EN LIGNE

-

Article 6 bis

A

(art. 15-3-3 [nouveau] du code de procédure pénale)

Spécialisation d'un parquet et d'une juridiction

en matière de lutte contre la haine en ligne

-

Article 6 bis B

(art. 138 du code de procédure pénale; art. 132-45 et 131-4-1 du code pénal)

Possibilité de prononcer une interdiction

d'adresser des messages électroniques à une victime

-

Article 6 bis C

(supprimé)

Compétence du juge unique en matière correctionnelle

à l'égard des refus de retrait d'un contenu haineux

-

Article 6 bis

A

-

CHAPITRE IV TER

PRÉVENTION DE LA DIFFUSION

DE CONTENUS HAINEUX EN LIGNE

-

Article 6 bis

(art. L. 312-9 du code de l'éducation)

Sensibilisation des élèves à la lutte

contre la diffusion des contenus haineux en ligne

-

Article 6 ter A

(nouveau)

(art. L. 121-1°du code de l'éducation)

Information sur les violences, y compris en ligne

-

Article 6 ter

(art. L. 721-2°du code de l'éducation)

Formation des enseignants en matière de lutte

contre la diffusion des contenus haineux

-

Article 6 bis

-

CHAPITRE V

DISPOSITIONS FINALES

-

Article 7

Observatoire de la haine en ligne

-

Article 8 (suppression maintenue)

Gage

-

Article 9

Entrée en vigueur

-

Article 10

(Art. L. 371-1, L. 771-1, L. 773-1 et L. 774-1 du code de l'éducation;

art. 108 de la loi n°86-1067 relative à la liberté de communication ;

art. 57 et 58 [abrogé] de la loi n° 2004-575 pour

la confiance dans l'économie numérique)

Application outre-mer

-

Article 7

-

LISTE DES PERSONNES ENTENDUES

ET CONTRIBUTIONS ÉCRITES

N° 197

SÉNAT

SESSION ORDINAIRE DE 2019-2020

|

Enregistré à la Présidence du Sénat le 11 décembre 2019 |

RAPPORT

FAIT

au nom de la commission des lois constitutionnelles, de législation, du suffrage universel, du Règlement et d'administration générale (1) sur la proposition de loi , adoptée par l'Assemblée nationale après engagement de la procédure accélérée, visant à lutter contre les contenus haineux sur internet ,

Par M. Christophe-André FRASSA,

Sénateur

|

(1) Cette commission est composée de : M. Philippe Bas , président ; MM. François-Noël Buffet, Jean-Pierre Sueur, Mme Catherine Di Folco, MM. Jacques Bigot, André Reichardt, Mme Sophie Joissains, M. Arnaud de Belenet, Mme Nathalie Delattre, MM. Pierre-Yves Collombat, Alain Marc , vice-présidents ; M. Christophe-André Frassa, Mme Laurence Harribey, M. Loïc Hervé, Mme Marie Mercier , secrétaires ; Mme Esther Benbassa, MM. François Bonhomme, Philippe Bonnecarrère, Mmes Agnès Canayer, Maryse Carrère, Josiane Costes, MM. Mathieu Darnaud, Marc-Philippe Daubresse, Mme Jacky Deromedi, MM. Yves Détraigne, Jérôme Durain, Mme Jacqueline Eustache-Brinio, MM. Jean-Luc Fichet, Pierre Frogier, Mmes Françoise Gatel, Marie-Pierre de la Gontrie, M. François Grosdidier, Mme Muriel Jourda, MM. Patrick Kanner, Éric Kerrouche, Jean-Yves Leconte, Henri Leroy, Mme Brigitte Lherbier, MM. Didier Marie, Hervé Marseille, Jean Louis Masson, Thani Mohamed Soilihi, Alain Richard, Vincent Segouin, Simon Sutour, Mmes Lana Tetuanui, Claudine Thomas, Catherine Troendlé, M. Dany Wattebled . |

Voir les numéros :

|

Assemblée nationale ( 15 ème législ.) : |

1785 , 1989 , 2062 et T.A. 310 |

|

|

Sénat : |

645 (2018-2019), 173 , 184 et 198 (2019-2020) |

|

L'ESSENTIEL

Réunie le 11 décembre 2019 sous la présidence de Philippe Bas , la commission des lois a adopté avec modifications, sur le rapport de Christophe-André Frassa , la proposition de loi visant à lutter contre les contenus haineux sur internet.

Examiné après engagement de la procédure accélérée, ce texte vise à lutter contre la propagation de certains « discours de haine » sur internet. Il renforce les sanctions pénales encourues par les réseaux sociaux et les moteurs de recherche qui ne retireraient pas en 24 heures de tels contenus et met en place une régulation administrative de ces grandes plateformes sous l'égide du CSA. Il facilite également l'organisation de la réponse judiciaire et promeut certaines actions de prévention en milieu scolaire.

Lors de ses travaux, la commission a adopté 45 amendements afin notamment :

- de supprimer le nouveau délit de « non-retrait » de contenu haineux , trop inabouti - car déséquilibré aux dépens de la liberté d'expression - et juridiquement fragile - alors même qu'elle touche à la matière pénale et intervient dans un champ régi par le droit de l'Union européenne ;

- de clarifier la régulation administrative des grandes plateformes pour mieux tenir compte des exigences du droit européen (directive « e-commerce »), en proportionnant les obligations à la charge des plateformes au risque d'atteinte à la dignité humaine et en écartant toute obligation générale de surveillance des réseaux ;

- de mieux s'attaquer à la viralité des discours de haine ainsi qu'à leur financement par la publicité , et de promouvoir l'interopérabilité entre plateformes pour garantir aux victimes un passage plus fluide de l'une à l'autre.

I. LA MOBILISATION DES ACTEURS PUBLICS ET DES INTERMÉDIAIRES TECHNIQUES CONTRE LES DISCOURS DE HAINE SUR INTERNET

A. LES DISCOURS DE HAINE SUR INTERNET : UN PHÉNOMÈNE PRÉOCCUPANT MAIS DONT L'AMPLEUR RESTE DIFFICILE À ÉVALUER

Comme la commission nationale consultative des droits de l'Homme (CNCDH) en dressait déjà le constat en 2015, « la prolifération des contenus haineux sur la toile, qui se nourrissent régulièrement des tensions sociales et de la crise de la citoyenneté, devient un phénomène très inquiétant . Elle constitue le terreau de conflits croissants entre groupes et communautés remettant en cause le vivre ensemble démocratique » 1 ( * ) .

S'il n'en nie évidemment pas la réalité, votre rapporteur regrette cependant l'absence de moyens fiables et exhaustifs permettant de mesurer l'ampleur et l'évolution du phénomène.

En France , seuls certains indices de tendance indirects peuvent ainsi être relevés. En 2018, sur les 163 723 signalements à la plateforme Pharos, 14 000 relevaient de la haine en ligne ou de discriminations 2 ( * ) . La majorité des signalements concernait des contenus présents sur les grands réseaux sociaux américains. Plus de la moitié constituaient des injures ou diffamations xénophobes ou discriminatoires, et plus du tiers, de la provocation publique à la haine et la discrimination raciale, ethnique ou religieuse.

À l'échelle de l'Europe , la Commission européenne a adopté en 2016 une approche volontariste mais privilégiant l'auto-régulation : elle a ainsi conclu avec les principales plateformes concernées un « Code de conduite » pour inciter celles-ci à prendre des mesures proactives et endiguer la diffusion des contenus de haine sur Internet.

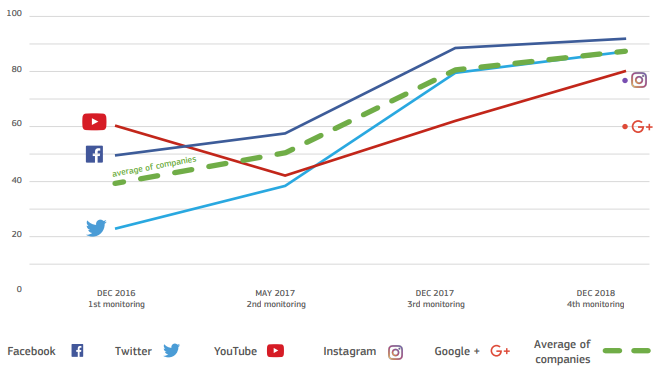

Cette approche reposant sur les engagements volontaires des acteurs a produit des résultats sensibles : fin 2018, 89 % des contenus signalés et 72 % des contenus considérés comme des discours de haine illégaux étaient examinés et traités dans les 24 heures du signalement, contre respectivement 40 % et 28 % lors du lancement du code de conduite en 2016.

Taux de traitement en moins de 24 heures des

notifications

par les entreprises parties au code de conduite

Source : Commission européenne, quatrième évaluation du code de conduite contre les discours de haine illégaux en ligne, février 2019.

B. LE RÔLE DES HÉBERGEURS : UN RÉGIME DE RESPONSABILITÉ PROTECTEUR EN CONTREPARTIE D'OBLIGATIONS DE COOPÉRATION

Transposant en droit français la directive « e-commerce » du 8 juin 2000 3 ( * ) , la loi pour la confiance dans l'économie numérique (LCEN) du 21 juin 2004 prévoit un régime de responsabilité spécifique pour les fournisseurs d'accès à Internet 4 ( * ) et les hébergeurs 5 ( * ) à raison des contenus à la diffusion desquels ils contribuent.

Les hébergeurs , en particulier , bénéficient d'une exonération facilitée de leur responsabilité civile ou pénale : c elle-ci ne peut être engagée en l'absence de connaissance de l'illicéité des contenus stockés ou, en cas de connaissance de l'illicéité manifeste des contenus stockés, s'ils ont procédé promptement à leur retrait .

Ce régime juridique protecteur est destiné à éviter que l'engagement trop systématique de leur responsabilité ne soit un frein à la libre expression sur internet des citoyens qui dépendent d'eux pour échanger.

Il s'applique à un spectre d'acteurs extrêmement large, qui englobe désormais les grandes plateformes bien connues : les moteurs de recherche ( Google , Qwant ), les réseaux sociaux (Facebook , Twitter ), les plateformes de diffusion de vidéos ( YouTube , Dailymotion ), etc.

En outre, les hébergeurs ne peuvent pas être soumis à une obligation générale de surveillance des informations qu'ils stockent ni de recherche des activités illicites, sous réserve des demandes « ciblées et temporaires de l'autorité judiciaire ».

En échange de ce régime favorable, les intermédiaires techniques sont tenus de coopérer avec la puissance publique pour lutter contre la diffusion desdits contenus illicites : cela se traduit par une obligation de recueil et de conservation de données sur leurs utilisateurs, de dénonciation des activités illicites, de transparence, voire de blocage des contenus.

II. LA PROPOSITION DE LOI TRANSMISE : UNE DIFFICILE SYNTHÈSE ENTRE OBLIGATIONS DE RÉSULTATS ET DE MOYENS

La proposition de loi présentée par la députée Laetitia Avia s'inscrit dans le plan national triennal 2018-2020 de lutte contre racisme et l'antisémitisme publié par le Gouvernement en mars 2018, qui prévoyait de modifier la législation nationale en vue de lutter contre la haine en ligne.

Elle tente une difficile synthèse entre deux orientations bien différentes :

- une approche insistant sur les obligations de résultat mises à la charge des plateformes pour l'effacement rapide et exhaustif des propos haineux en ligne, sous peine de sanctions, comme le recommandait le rapport Renforcer la lutte contre le racisme et l'antisémitisme 6 ( * ) remis au Premier ministre en septembre 2018 dont Mme Avia était co-auteure (avec Karim Amellal et Gil Taïeb) ;

- et une approche par la régulation, centrée sur un contrôle plus poussé des moyens mis en oeuvre par les plateformes , afin de s'assurer qu'ils sont suffisants pour lutter efficacement contre la haine en ligne, en cohérence avec les conclusions de la mission « Régulation des réseaux sociaux » 7 ( * ) publiées en mai 2019 (et faisant suite à la rencontre entre le Président de la République et Mark Zuckerberg, président-directeur général de Facebook).

A. LA PRINCIPALE DISPOSITION DU TEXTE : UNE OBLIGATION DE RETRAIT EN 24 HEURES DES CONTENUS ODIEUX SANCTIONNÉE PAR UN NOUVEAU DÉLIT

Le coeur de la proposition de loi adoptée par l'Assemblée nationale consiste en la création d'une obligation de suppression de certains contenus haineux manifestement illicites, dans les 24 heures après leur notification aux grandes plateformes (réseaux sociaux ou moteurs de recherche à fort trafic accessibles sur le territoire français). Chaque « non retrait » dans les temps d'un tel contenu serait pénalement réprimé par un nouveau délit spécifique (un an de prison et 250 000 euros d'amende, portés au quintuple pour les personnes morales).

Les contenus « haineux » concernés sont, par le jeu d'ajouts et de renvois successifs, devenus nombreux et disparates (injures aggravées, apologies de crimes, provocations à la discrimination, à la haine ou à la violence, harcèlement sexuel, exposition de mineurs à des messages violents ou pornographiques, traite des êtres humains, proxénétisme, pédopornographie et provocation au terrorisme...)

Les associations de lutte contre les discriminations seraient autorisées à exercer les droits reconnus à la partie civile contre le nouveau délit de refus de retrait d'un contenu manifestement haineux, et il est prévu qu'une association de protection de l'enfance puisse notifier un tel contenu à la place d'un mineur.

Les règles formelles de notification de tous les contenus illicites (haineux ou non) son drastiquement simplifiées.

B. L'INSTAURATION D'UNE RÉGULATION AMBITIEUSE DES PLATEFORMES : DE NOUVELLES OBLIGATIONS DE MOYENS SOUS LA SUPERVISION DU CONSEIL SUPÉRIEUR DE L'AUDIOVISUEL

La proposition de loi transmise impose de nouvelles obligations de moyens aux plateformes en matière de lutte contre les contenus haineux en ligne (dispositif de notification ; information des utilisateurs ; possibilité de contester des décisions de retrait ou de maintien de contenus ; transparence des activités ; protection spécifique des mineurs).

Elle confie au Conseil supérieur de l'audiovisuel (CSA) une nouvelle mission de régulation administrative de ces plateformes . Chargé de s'assurer de leur coopération et du respect de ces nouvelles obligations de moyens, il disposerait pour ce faire d'un pouvoir réglementaire (lui permettant de formuler des recommandations contraignantes) et d'investigation, et pourrait prononcer des sanctions pécuniaires considérables et dissuasives (l'amende administrative pouvant atteindre 4 % du chiffre d'affaires annuel mondial de l'opérateur).

Le texte transfère également au CSA la compétence aujourd'hui confiée à une personnalité qualifiée de la CNIL pour contrôler le blocage et le déréférencement administratifs de sites terroristes ou pédopornographiques.

C. PRÉVENIR LA HAINE ET PUNIR LES AUTEURS : DES AMÉLIORATIONS MARGINALES DE LA FORMATION ET DE L'ORGANISATION JUDICIAIRE DE LA RÉPRESSION

La proposition de loi permet de spécialiser un parquet et une juridiction en matière de lutte contre la haine en ligne et complète les obligations du contrôle judiciaire et du sursis probatoire (réaffirmant la possibilité de prononcer une interdiction d'adresser des messages électroniques à une victime).

Elle prévoit d'inscrire expressément dans le code de l'éducation la sensibilisation des élèves et la formation des enseignants en matière de lutte contre la diffusion des contenus haineux.

III. LA POSITION DE LA COMMISSION DES LOIS :

RÉÉQUILIBRER

ET MIEUX SÉCURISER JURIDIQUEMENT UN

ENSEMBLE DE MESURES INÉGALEMENT ABOUTIES

A. DES OBJECTIFS PARTAGÉS, UN PROBLÈME DE MÉTHODE

L'intention première des auteurs de cette proposition de loi est louable et il existe un large consensus au Sénat pour mieux responsabiliser les grandes plateformes qui jouent un rôle décisif dans la diffusion sur internet de discours de haine.

Les travaux et propositions de notre assemblée ces dernières années en attestent , incitant régulièrement le Gouvernement à ne pas avoir une position attentiste mais à agir à l'échelon national avant une hypothétique solution harmonisée au niveau européen souvent annoncée mais longtemps retardée. Tel est le cas notamment des recommandations de la commission d'enquête du Sénat pour une souveraineté numérique 8 ( * ) afin d'améliorer la régulation des acteurs « systémiques » du numérique et de mieux responsabiliser les plateformes, ou encore la résolution européenne du Sénat en faveur d'une révision de la directive « e-commerce » 9 ( * ) .

Malheureusement, alors que les mesures proposées s'inscrivent clairement dans le cadre d'un plan gouvernemental global de lutte contre les discriminations, votre rapporteur regrette vivement le choix qui a été fait de recourir à une proposition de loi plutôt qu'à un projet de loi privant à nouveau le Parlement d'une étude d'impact .

Nuisant à la clarté de nos débats, l'existence de trois autres textes adoptés ou en voie de l'être (directive « service de médias audiovisuels », règlement européen sur les contenus terroristes, projet de loi de réforme de l'audiovisuel) risque également d'interférer avec certaines dispositions de la présente proposition de loi, voire d'en imposer la réécriture à brève échéance.

B. L'ARTICLE 1ER : UN DISPOSITIF PÉNAL INABOUTI ET DÉSÉQUILIBRÉ AU DÉTRIMENT DE LA LIBERTÉ D'EXPRESSION

1. Un risque de déséquilibre au détriment de la conception française de la liberté d'expression

En exigeant des opérateurs de plateformes qu'ils apprécient le caractère manifestement illicite des messages haineux signalés dans un délai particulièrement bref, alors, d'une part, que cet exercice de qualification juridique est difficile pour certaines infractions contextuelles, et alors, d'autre part, qu'ils sont sous la menace de sanctions pénales lourdes en cas d'erreur, ce dispositif encouragera mécaniquement les plateformes à retirer - par excès de prudence - des contenus pourtant licites.

D'autres effets pervers sont également à redouter :

- la multiplication du recours à des filtres automatisés ;

- l' instrumentalisation des signalements par des groupes organisés de pression ou d'influence (« raids numériques » contre des contenus licites mais polémiques) ;

- l' impossibilité de prioriser , dans un délai couperet uniforme de 24 heures, les contenus les plus nocifs qui ont un caractère d'évidence et doivent être retirés encore plus rapidement - terrorisme, pédopornographie - à côté d'autres infractions moins graves ou plus longues à qualifier car « contextuelles » ;

- le contournement du juge et l' abandon de la police de la liberté d'expression sur internet aux grandes plateformes étrangères.

2. Un « droit pénal purement expressif » ? Des problèmes d'imputabilité et d'intentionnalité

Le dispositif pénal semble difficilement applicable - il a même été qualifié de « droit pénal purement expressif » par des représentants du parquet, tant les contraintes procédurales et considérations budgétaires limitent le pouvoir d'action de l'autorité judiciaire en la matière -, et présente :

- un problème d' imputabilité concrète, s'agissant des personnes physiques (qui du modérateur sous-traitant indien ou du dirigeant américain sera poursuivi ?) et, surtout, des personnes morales ( comment qualifier l'intention pénale des organes dirigeants des hébergeurs concernés, domiciliés à l'étranger et dont il faut démontrer la complicité ?) ;

- un problème de caractérisation de l' intentionnalité : le simple non retrait suffira-t-il, ou sera-t-il nécessaire pour l'autorité de poursuite de caractériser une absence de diligences normales de l'opérateur dans sa capacité à qualifier l'illégalité manifeste d'un contenu ?

3. Une contrariété probable au droit européen

La Commission européenne a transmis au Gouvernement des observations longues et très critiques alertant sur la violation probable de la directive « e-commerce » et de la Charte des droits fondamentaux de l'Union européenne.

Selon elle, le texte viole plusieurs principes majeurs du droit européen (principe du « pays d'origine » ; responsabilité atténuée des hébergeurs ; interdiction d'instaurer une surveillance généralisée des réseaux). Rappelant l'existence de plusieurs initiatives législatives européennes en cours, la commission a invité formellement la France à surseoir à l'adoption de ce texte.

Le Gouvernement n'ayant été capable d'offrir aucune solution alternative pour rendre opérant l'article 1 er , et écarter le risque de sur-blocage de propos licites, le rapporteur a recommandé à la commission, qui l'a suivi, la suppression à ce stade de cette nouvelle sanction pénale inapplicable et contraire au droit européen.

Certaines dispositions intéressantes ont été conservées ou améliorées, en les intégrant au régime général prévu par la LCEN :

- la substitution de messages aux contenus haineux retirés et la possibilité (et non l'obligation) de leur conservation en vue d'enquêtes judiciaires ;

- l' ajout des injures publiques à caractère discriminatoire et du négationnisme aux contenus devant faire l'objet d'un dispositif technique de notification spécifique mis en place par les hébergeurs ;

- la simplification des notifications prévues par la LCEN, en la rendant conforme au droit européen ;

- la reconnaissance de l' action des associations de protection de l'enfance .

C. LA RÉGULATION DES PLATEFORMES : UNE SOLUTION PERTINENTE APPROUVÉE ET PRÉCISÉE

Le rapporteur estime que l'imposition d'obligations de moyens sous la supervision d'un régulateur armé de sanctions dissuasives est la solution la plus pertinente pour contraindre les grandes plateformes à une lutte plus efficace contre les discours de haine véhiculés sur les réseaux.

Il a souhaité d'abord tenir compte des observations de la commission européenne et rendre ce dispositif plus respectueux du droit européen :

- proportionnant les obligations à la charge des plateformes au risque d'atteinte à la dignité humaine ;

- et écartant toute obligation générale de surveillance des réseaux.

Pour améliorer la rédaction de certaines des obligations de moyens mis à la charge des plateformes , la commission a prévu, à son initiative :

- l'absence d'information systématique des auteurs de contenus au stade de la simple notification par un tiers, pour éviter les spams et « raids numériques » contre les auteurs de contenus licites mais polémiques ;

- à titre exceptionnel, la possibilité dans certains cas de ne pas informer l'auteur de contenus retirés, notamment pour préserver les enquêtes en cours ;

- la suppression de l'obligation générale faite aux plateformes d'empêcher la réapparition de tout contenu illicite (« notice and stay down ») contraire au droit européen.

La commission a également approuvé plusieurs clarifications procédurales concernant les pouvoirs de régulation et de sanction attribués au CSA. Le rapporteur a indiqué toutefois s'inquiéter à cet égard du risque de manque de moyens et de compétences techniques du régulateur pour expertiser efficacement les plateformes .

D. VIRALITÉ, FINANCEMENT, INTEROPÉRABILITÉ : DES PROPOSITIONS COMPLÉMENTAIRES POUR MIEUX S'ATTAQUER AUX RESSORTS PROFONDS DU PROBLÈME

1. Mieux s'attaquer à la viralité, coeur du problème

Comme il en a été fait l'observation au cours des auditions, en l'état du texte, une plateforme qui retire un contenu haineux vu 8 millions de fois 23 heures après sa notification respecterait parfaitement l'obligation de résultat instaurée à l'article 1 er de la proposition de loi...

Dès lors, le rapporteur a souhaité compléter ce texte pour lutter plus efficacement contre la viralité des contenus haineux , qui est le véritable coeur du problème à traiter. À ce titre, il a proposé :

- d'ajuster le champ des acteurs soumis aux obligations de moyens renforcés de lutte contre les contenus haineux, pour permettre au CSA d'attraire les plateformes moins grandes mais très virales dans le champ de sa régulation ;

- d'encourager les plateformes, sous le contrôle du CSA, à prévoir des dispositifs techniques de désactivation rapide de certaines fonctionnalités de rediffusion massive des contenus .

2. S'attaquer au financement des entrepreneurs de haine par la publicité

La commission a également adopté un amendement visant à mieux associer les régies publicitaires à la lutte contre le financement de sites facilitant la diffusion en ligne des discours de haine par un renforcement des obligations de transparence à leur charge.

3. Intégrer l'obligation d'interopérabilité à la boîte à outils du régulateur

Enfin, comme le recommandait la commission d'enquête du Sénat sur la souveraineté numérique, votre rapporteur a souhaité approfondir l'obligation de portabilité , en complétant la boîte à outil du régulateur des plateformes. La possibilité d'encourager l' interopérabilité permettrait ainsi aux victimes de haine de se « réfugier » sur d'autres plateformes avec des politiques de modération différentes, tout en pouvant continuer à échanger avec les contacts qu'elles avaient noués jusqu'ici.

EXAMEN

DES ARTICLES

DE LA PROPOSITION DE LOI

CHAPITRE IER

SIMPLIFICATION

DES DISPOSITIFS DE NOTIFICATION DE CONTENUS HAINEUX EN LIGNE

Article

1er

(art. 6 de la loi n° 2004-575 pour la confiance dans

l'économie numérique)

Obligation pour les grandes plateformes

de supprimer en 24 heures certains contenus manifestement illicites ;

liste des contenus et répression pénale des manquements ;

exercice des droits reconnus

à la partie civile par les associations

de lutte contre les discriminations

L'article 1 er de la proposition de loi tend à créer une nouvelle obligation de suppression de certains contenus « haineux » manifestement illicites par les grandes plateformes (réseaux sociaux ou moteurs de recherche à fort trafic accessibles sur le territoire français), dans les 24 heures après leur notification, dont la méconnaissance serait pénalement réprimée par un nouveau délit (un an de prison et 250 000 euros d'amende, somme portée au quintuple pour les personnes morales).

1. Le rôle des hébergeurs face aux contenus illicites sur internet : un régime de responsabilité protecteur mais des obligations de coopération

Pour recevoir et émettre des informations ou accéder à des services en ligne, les utilisateurs d'internet dépendent d'une chaîne d'intermédiaires techniques aux activités variées : fournisseurs d'accès à internet, hébergeurs de données et prestataires de services aux dénominations diverses (annuaires, forums, moteurs de recherche, réseaux sociaux, etc.).

Plus facile à identifier - et à attraire en justice - et souvent plus solvables que les auteurs de contenus illicites diffusés grâce à eux sur internet, ces intermédiaires font l'objet depuis les années 2000 d'un régime juridique protecteur destiné à éviter que l'engagement trop systématique de leur responsabilité pénale ou civile ne soit un frein à leur développement économique ou à la libre expression sur internet.

|

Les hébergeurs :

La notion d'hébergeur a été définie il y a près de 15 ans, elle figure dans la directive e-commerce (« service de la société de l'information consistant à stocker des informations fournies par un destinataire du service ») et dans la LCEN qui la transpose (« personnes physiques ou morales qui assurent, même à titre gratuit, pour mise à disposition du public par des services de communication au public en ligne, le stockage de signaux, d'écrits, d'images, de sons ou de messages de toute nature fournis par des destinataires de ces services »). Outre les prestataires d'hébergement traditionnels offrant des espaces de stockage de données (comme OVH), sont apparus depuis les années 2010 des prestataires de services nouveaux, utilisant des algorithmes d'indexation, de classement et de mise en avant, valorisant et diffusant des textes, images ou vidéos produits par les utilisateurs eux-mêmes, et permettant aux internautes de former des réseaux de relations et d'échanges. L'essor du « Web 2.0 » a ainsi mis à mal la distinction juridique classique entre hébergeur et éditeur. La jurisprudence - à qui il est seule revenu d'actualiser la notion faute de révision de la directive e-commerce -, vérifie désormais pour octroyer le statut d'hébergeur l'absence de « rôle actif de nature à lui confier une connaissance ou un contrôle des données stockées » 10 ( * ) . Dès lors, eu égard à leur rôle, ont pu être qualifiées d'hébergeurs et bénéficier du régime protecteur de responsabilité aménagée de nombreuses plateformes de partage de contenus créés par leurs utilisateurs, qu'il s'agisse de sites de partage de vidéos ( Youtube , Dailymotion ...), de réseaux sociaux ( Facebook , Twitter , LinkedIn , Viadeo ), de forums de discussion ou d' agrégateurs d'actualités, de plateformes commerciales de mise en relation ( eBay , PriceMinister ...), de sites de streaming , de comparateurs de prix ( Shopping.com ). Il en est allé de même pour les moteurs de recherche ( Google , Qwant ...), eu égard au caractère largement automatisé des opérations d'indexation et de présentation des contenus. |

Transposant en droit français la directive « e-commerce » du 8 juin 2000 11 ( * ) , la loi pour la confiance dans l'économie numérique (LCEN) du 21 juin 2004 prévoit ainsi un régime de responsabilité spécifique pour les fournisseurs d'accès 12 ( * ) et les hébergeurs 13 ( * ) à raison des contenus à la diffusion desquels ils contribuent. Les acteurs exerçant une activité d'intermédiaire dans la mise à disposition de contenus en ligne voient leur responsabilité plus facilement écartée que dans le régime de droit commun, en contrepartie d'une obligation de collaboration dans la lutte contre la diffusion des contenus illicites.

Les hébergeurs , en particulier , bénéficient d'une exonération facilitée de leur responsabilité civile et pénale : c elle-ci ne peut être engagée en l'absence de connaissance de l'illicéité des contenus stockés ou, en cas de connaissance de l'illicéité manifeste des contenus stockés, s'ils ont procédé promptement à leur retrait . Ce régime protecteur s'applique ainsi à un spectre d'acteurs extrêmement large qui englobe désormais les grandes plateformes bien connues : les moteurs de recherche ( Google , Qwant ) les réseaux sociaux (Facebook , Twitter ), les plateformes de diffusion de vidéos ( YouTube , Dailymotion ), etc.

En outre, les hébergeurs ne peuvent pas être soumis à une obligation générale de surveillance des informations qu'ils stockent ni de recherche des activités illicites (sous réserve des demandes « ciblées et temporaires de l'autorité judiciaire »).

En échange de ce régime favorable, les intermédiaires techniques sont tenus de coopérer avec la puissance publique pour lutter contre la diffusion desdits contenus illicites : cela se traduit par une obligation de recueil et de conservation de données sur leurs utilisateurs, de dénonciation des activités illicites, de transparence, voire de blocage des contenus.

|

La « responsabilisation » des

hébergeurs :

En l'état du droit, en France, les hébergeurs doivent : - retirer promptement tout contenu illicite dont ils ont connaissance (2 et 3 du I de l'article 6 de la LCEN) ; - détenir et conserver pendant une certaine durée les données d'identification et de connexion de tout contributeur à la création d'un contenu en ligne (ce qui doit faciliter l'engagement et l'efficacité de poursuites ultérieures) ; - répondre aux réquisitions de l'autorité judiciaire aux fins de communication de ces données identifiantes (II de l'article 6 de la LCEN) ; - se conformer aux décisions administratives (article 6-1 de la LCEN) et aux jugements ordonnant le blocage de certains contenus illicites (8 du I de l'article 6) ; - mettre en place, pour certaines infractions particulièrement odieuses, un mécanisme de notification « facilement accessible et visible permettant à toute personne de porter à leur connaissance ce type de données » (7 du I de l'article 6 de la LCEN) ; - informer « promptement » les autorités publiques compétentes en cas de signalement d'activités illicites (idem) ; - et rendre publics les moyens qu'ils consacrent à cette lutte (idem). Des dispositions pénales spécifiques viennent sanctionner le manquement de tout hébergeur à ces obligations de coopération (1 et 2 du VI de l'article 6 de la LCEN). |

2. Le texte adopté par l'Assemblée nationale : imposer à certains hébergeurs une obligation de résultat (retrait en 24 heures des contenus odieux), sanctionnée par un nouveau délit

Dans le dernier état de sa rédaction, l'article 1 er , qui a subi des modifications substantielles à l'Assemblée nationale en commission puis en séance, créerait une obligation de retrait ou de suppression pour tout contenu « haineux » manifestement illicite, dans les 24 heures après sa notification aux grandes plateformes (réseaux sociaux ou moteurs de recherche à fort trafic) accessibles sur le territoire français. La méconnaissance en serait pénalement réprimée par l'instauration d'un nouveau délit spécifique puni d'un an de prison et 250 000 euros d'amende par infraction.

Par sa portée , ce dispositif se veut radicalement nouveau, puisqu'il s'agirait désormais bien d'une « obligation de résultat », selon les termes de la rapporteure de l'Assemblée nationale : énoncé au sein d'un nouvel article 6-2, le régime spécifique instauré aurait vocation à se combiner avec le régime général de responsabilité des intermédiaires techniques issu de la LCEN (« sans préjudice des dispositions [de] l'article 6 »), imposant pour une sous-catégorie d'hébergeurs, et pour un sous-ensemble de contenus illicites, de nouvelles contraintes particulières et des sanctions spécifiques.

Son champ d'application organique et territorial recouvrirait ainsi certains grands opérateurs de plateformes en ligne présents en France : les réseaux sociaux 14 ( * ) et les moteurs de recherche 15 ( * ) qui dépassent des seuils d'activité sur le territoire français déterminés par décret.

Interrogé par votre rapporteur, le Gouvernement n'a malheureusement pas été en mesure d'indiquer précisément ni les types de seuils et niveaux envisagés, ni le nombre d'opérateurs susceptibles d'être concernés en fonction desdits seuils, faisant seulement référence au décret pris pour l'application des obligations de transparence et de loyauté instaurées depuis la loi « République numérique » (seuil fixé en la matière à cinq millions de visiteurs uniques par mois, par plateforme, calculé sur la base de la dernière année civile 16 ( * ) ) ;

Le champ d'application matériel de l'obligation de retrait a été modifié lors de l'examen du texte en commission puis en séance, et a fait l'objet d'âpres discussions et de nombreux amendements destinés à l'élargir à un nombre croissant d'infractions.

En l'état du texte transmis, ce champ recouvrirait les contenus relevant manifestement de certaines infractions ayant un caractère particulièrement odieux : injures aggravées, apologies de certains crimes, provocations à la discrimination, à la haine ou à la violence, harcèlement sexuel, exposition de mineurs à des messages violents ou pornographiques, traite des êtres humains, proxénétisme, pédopornographie et provocation au terrorisme (infractions visées, par référence, au 7 du I de l'article 6 de la LCEN qui prévoit la mise en place de dispositifs de notification par les hébergeurs au titre de leur devoir de coopération dans la lutte contre certains contenus illégaux, auxquelles ont été ajoutées les injures à caractère discriminatoire) :

|

Fondement textuel |

Description de l'infraction |

PPL initiale |

Texte transmis |

|

Cinquième

alinéa

de

l'article 24

|

Apologie des crimes d'atteinte volontaire à la vie, d'atteinte volontaire à l'intégrité de la personne, d'agression sexuelle, de vol aggravé, d'extorsion, de destruction, de dégradation ou détérioration volontaire dangereuse pour les personnes, des crimes de guerre, des crimes contre l'humanité, des crimes de réduction en esclavage ou d'exploitation d'une personne réduite en esclavage ou des crimes et délits de collaboration avec l'ennemi, y compris si ces crimes n'ont pas donné lieu à la condamnation de leurs auteurs |

OUI |

OUI |

|

Sixième alinéa de l'article 24 de la loi du 29 juillet 1881 sur la liberté de la presse |

Cris ou chants séditieux |

OUI |

NON |

|

Septième alinéa de l'article 24 de la loi du 29 juillet 1881 sur la liberté de la presse |

Provocation à la discrimination, à la haine

ou à la violence à l'égard d'une personne ou d'un groupe

de personnes à raison de leur origine ou de

leur appartenance ou

|

NON |

OUI |

|

Huitième alinéa de l'article 24 de la loi du 29 juillet 1881 sur la liberté de la presse |

Provocation à la haine ou à la violence à l'égard d'une personne ou d'un groupe de personnes à raison de leur sexe, de leur orientation sexuelle ou identité de genre ou de leur handicap ou ayant provoqué, à l'égard des mêmes personnes, aux discriminations prévues par les articles 225-2 et 432-7 du code pénal. |

NON |

OUI |

|

Troisième alinéa de l'article 33 de la loi du 29 juillet 1881 sur la liberté de la presse |

Injure commise par les mêmes moyens envers une personne ou un groupe de personnes à raison de leur origine ou de leur appartenance ou de leur non-appartenance à une ethnie, une nation, une race ou une religion déterminée |

OUI |

OUI |

|

Quatrième

alinéa

de

l'article 33

|

Injure commise dans les mêmes conditions envers une personne ou un groupe de personnes à raison de leur sexe, de leur orientation sexuelle ou identité de genre ou de leur handicap. |

OUI |

OUI |

|

Article

222-33

|

Harcèlement sexuel |

NON |

OUI |

|

Article

225-4-1

|

Traite des êtres humains |

NON |

OUI |

|

Articles 225-5 et 225-6 du code pénal |

Proxénétisme |

NON |

OUI |

|

Article

227-23

|

Captation, enregistrement, transmission, offre, mise à disposition, diffusion, importation ou exportation, acquisition ou détention d'image pornographique d'un mineur ; consultation habituelle ou en contrepartie d'un paiement d'un service de communication au public en ligne mettant à disposition des images pornographiques de mineurs |

NON |

OUI |

|

Article

227-24

|

Fabrication, transport, diffusion ou commerce de message violent ou pornographique susceptible d'être vu ou perçu par un mineur |

NON |

OUI |

|

Article

421-2-5

|

Provocation directe à des actes de terrorisme ou apologie publique de ces actes |

NON |

OUI |

La précision que seules les illicéités ayant un caractère manifeste relèvent de l'obligation de retrait en 24 heures transpose explicitement, au sein du nouveau régime de responsabilité instauré par le présent article pour les grands opérateurs de plateformes, une importante réserve d'interprétation 17 ( * ) énoncée par le Conseil constitutionnel à propos du cadre général de la LCEN.

Le régime particulier d'obligation de retrait des contenus manifestement illicites et de sanction instauré par le texte est, pour le reste, bien plus rigoureux que celui prévu par la LCEN. Alors que la LCEN prévoit une obligation de « prompt » retrait (dont le respect a ainsi vocation à être apprécié en fonction du contenu, de l'illicéité alléguée et des diligences de l'hébergeur) et ne détaille pas les conditions concrètes d'engagement de la responsabilité pénale en cas de manquement (qui pourrait être recherchée au titre de la complicité avec l'auteur des contenus 18 ( * ) ), la proposition de loi crée, elle, une obligation de retrait dans un délai préfix (24 heures après notification) dont la méconnaissance est réprimée par l'instauration d' un nouveau délit spécifique, chaque « non retrait » de contenu étant passible d'une sanction pénale (quelle que soit, à cet égard, l'infraction sous-jacente dont relève ledit contenu illicite).

Les peines encourues sont fixées par un renvoi à celles prévues au 1 du VI de l'article 6 de la LCEN soit, en l'état actuel du droit :

- pour les hébergeurs personnes physiques ou le dirigeant de droit ou de fait d'une personne morale exerçant cette activité, un an d'emprisonnement et 75 000 euros d'amende ;

- pour les personnes morales, outre une amende de 375 000 euros 19 ( * ) , l'interdiction, pour une durée de cinq ans au plus, d'exercer directement ou indirectement l'activité professionnelle dans l'exercice ou à l'occasion de laquelle l'infraction a été commise , et l'affichage de la décision prononcée ou la diffusion de celle-ci soit par la presse écrite, soit par tout moyen de communication au public par voie électronique.

La proposition de loi, dans son article 3 bis, propose cependant d'augmenter considérablement le montant de ces amendes, portant les sanctions encourues, par infraction, à 250 000 euros pour les personnes physiques, et donc à 1,25 million d'euros pour les personnes morales.

3. Une intention louable mais un dispositif inabouti : le risque de nombreux effets pervers et des obstacles juridiques non résolus

L'intention première des auteurs de cette proposition de loi est louable et il existe un large consensus pour tenter de mieux responsabiliser les grandes plateformes qui jouent un rôle décisif dans la diffusion sur internet de propos constituant des infractions.

Les travaux et propositions du Sénat ces dernières années en attestent d'ailleurs :

- la commission d'enquête du Sénat pour une souveraineté numérique, dont votre rapporteur était membre, a récemment formulé à l'unanimité plusieurs recommandations pour améliorer la régulation des acteurs « systémiques » du numérique et pour mieux responsabiliser les plateformes ;

- le Sénat a également pris position sur ce sujet en adoptant, à l'initiative de notre collègue Catherine Morin-Desailly, présidente de la commission de la culture et rapporteure pour avis du présent texte, une résolution européenne en faveur d'une révision de la directive « e-commerce » (qui appelle à faire émerger un « troisième statut », à côté de celui des hébergeurs et des éditeurs, défini au niveau européen, et ménageant la liberté d'expression et la compétitivité des acteurs du secteur).

Néanmoins, la rédaction proposée par le texte de cet article reste très inaboutie - car trop déséquilibrée aux dépens de la liberté d'expression - et juridiquement fragile - alors même qu'elle touche à la matière pénale et intervient dans un champ régi par le droit de l'Union européenne.

3.1 Sur-censure et contournement du juge : un risque de déséquilibre au détriment de la conception française de la liberté d'expression

Votre rapporteur a été alerté des risques d'effets pervers que présente ce texte par les nombreux acteurs de la société civile qu'il a entendus en audition (représentants des avocats, de Conseil national du numérique, de la Commission nationale consultative des droits de l'Homme, des associations de défense des libertés numériques) ou dont il a reçu contributions.

Comme eux, votre rapporteur estime que, tel qu'il est envisagé à ce stade, le dispositif reste trop déséquilibré et ne manquera pas d'entraîner de nombreux effets pervers et un risque de rompre les équilibres de notre conception traditionnelle de la liberté d'expression.

En exigeant des opérateurs de plateformes qu'ils apprécient le caractère manifestement illicite des messages haineux signalés dans un délai particulièrement bref, alors, d'une part, que cet exercice de qualification juridique est difficile pour certaines infractions contextuelles, et alors, d'autre part, qu'ils sont sous la menace de sanctions pénales explicites et dissuasives en cas d'erreur, ce dispositif encouragera mécaniquement les plateformes à retirer - par excès de prudence - des contenus pourtant licites. Un trop grand zèle dans la suppression de contenus et un comportement de « sur-censure » n'engageront d'ailleurs pas, eux, la responsabilité pénale des plateformes, quand celle des personnes notifiant à tort restera quasiment impossible à rechercher en pratique 20 ( * ) . Votre rapporteur ne doute dès lors pas que les grands opérateurs de plateformes auront vite fait le bilan des risques économiques et réputationnels encourus par eux entre, d'une part, les retraits insuffisants pénalement sanctionnés par la puissance publique et, d'autre part, les cas de retraits excessifs où ils s'exposent seulement au mécontentement d'utilisateurs individuels...

Mais d'autres effets pervers sont également à redouter :

- la multiplication du recours à des filtres automatisés 21 ( * ) de reconnaissance, d'analyse et de retrait des contenus par les plateformes, sans intervention humaine, alors qu'il s'agit de prendre des décisions touchant aux droits fondamentaux des utilisateurs ;

- l' instrumentalisation des signalements par des groupes organisés de pression ou d'influence (« raids numériques » contre des contenus licites mais polémiques), prospérant sur l'attitude trop précautionneuse des plateformes face au risque de sanction pénale ;

- l' impossibilité de prioriser , dans un délai couperet uniforme de 24 heures, les nombreuses notifications à traiter (en privilégiant les contenus les plus nocifs qui ont un caractère d'évidence et doivent être retirés encore plus rapidement - terrorisme, pédopornographie- et d'autres infractions, moins graves ou plus « contextuelles », nécessitant d'être analysées pour en apprécier le caractère manifestement illicite).

Enfin, la faculté donnée à chacun de s'exprimer librement, de publier des vidéos ou des photos, et plus largement de partager des contenus, suppose un équilibre délicat entre la liberté reconnue aux personnes et la protection des droits d'autrui.

L'une des garanties essentielles pour assurer cet équilibre repose sur l'intervention de l'autorité judiciaire. Or le dispositif proposé ferait essentiellement reposer l'appréciation du caractère illicite d'un contenu sur les seules plateformes, en lieu et place de l'autorité judiciaire. Il est alors plus que probable que, pour trancher, les références juridiques (Premier Amendement tempéré par leurs conditions générales d'utilisation draconiennes) et les moyens (les algorithmes qu'ils développent et les modérateurs humains qui sont généralement leurs sous-traitants) seront ceux des géants américains du numérique, parfois éloignés des règles posées par l'Union européenne et notre législation nationale.

Dans un champ aussi sensible que celui des droits fondamentaux de nos concitoyens, c'est au juge, et à lui seul, qu'il doit normalement revenir d'apprécier le caractère abusif de l'exercice de la liberté d'expression. Votre rapporteur ne se résout pas à renforcer aussi massivement l'influence qu'ont les grandes plateformes étrangères en France en leur déléguant sans garanties la police de la liberté d'expression sur internet.

3.2 Un « droit pénal purement expressif » ? Des problèmes d'imputabilité, d'intentionnalité et de cumul

Alors même que ce texte entend instaurer un nouveau délit en cas de « non retrait » de certains contenus, votre rapporteur est frappé que des représentants du parquet qu'il a entendu n'aient pas hésité à qualifier le dispositif proposé de « droit pénal purement expressif » , les peines encourues n'ayant pas réellement vocation à être prononcées en pratique mais répondant à un pur objectif d'affichage, à vocation dissuasive.

En l'état du texte, les dispositions pénales proposées présentent d'abord un problème d'imputabilité . Faute d'avoir reçu des réponses satisfaisantes permettant de la lever, votre rapporteur relève qu'une ambiguïté demeure quant aux personnes susceptibles d'être poursuivies du fait de l'absence de retrait en 24 heures des contenus « haineux ». Pour définir la sanction pénale, le texte proposé par le 6 e alinéa de l'article 1 er de la proposition de loi renvoie en effet aux seules« peines prévues » au 1 du VI de l'article 6 de la LCEN, sans jamais préciser l'imputabilité de l'infraction énoncée.

À supposer même que cette difficulté soit surmontée, s'agissant des personnes physiques , la seule dont la responsabilité pénale semble pouvoir être recherchée n'est sans doute, en pratique, ni le modérateur de contenu chargé de l'examen du contenu illicite, ni le dirigeant de l'entreprise si celle-ci a son siège à l'étranger, mais, selon le Gouvernement 22 ( * ) , le « représentant légal » nommé en France. Votre rapporteur relève pourtant que l'article 3, qui prévoit l'obligation de sa désignation, ne fait de ce représentant qu'un simple « interlocuteur référent » chargé de « recevoir les demandes de l'autorité judiciaire » dénué de pouvoir de décision ou de direction au sein des opérateurs.

S'agissant des personnes morales , les difficultés à engager leur responsabilité ont été soulignées par la rapporteure de l'Assemblée nationale elle-même, qui indique dans son rapport, à propos de la LCEN : « votre rapporteure n'a trouvé aucun cas où un hébergeur avait vu sa responsabilité pénale engagée à raison des contenus qu'ils stockaient, pour des raisons tenant à la fois à des contraintes procédurales lourdes et des considérations budgétaires limitant le pouvoir d'action de l'autorité judiciaire mais aussi aux difficultés à qualifier l'intention pénale des organes dirigeants des hébergeurs concernés, domiciliés à l'étranger et dont il faut démontrer la complicité » . Votre rapporteur ne voit pas en quoi le dispositif proposé par le présent article règlerait chacune de ces très sérieuses difficultés.

Le dispositif pénal proposé soulève en outre un problème d'intentionnalité dans la caractérisation de l'élément moral 23 ( * ) . Dans le cas de l'absence de retrait en 24 heures d'un contenu manifestement illicite au regard des infractions « haineuses » visées par la proposition de loi, votre rapporteur s'interroge si la simple absence de retrait suffira bien à entraîner la condamnation de la personne physique ou morale (« obligation de résultat ») ou si, plus vraisemblablement, il sera nécessaire pour l'autorité de poursuite de caractériser une absence de diligences normales de l'opérateur dans sa capacité à qualifier l'illégalité manifeste d'un contenu.

Il ressort des échanges de votre rapporteur avec des magistrats comme avec les services de la Chancellerie que l'intentionnalité ne pourra selon eux être caractérisée que lorsque l'absence de retrait en 24 heures aura été constatée à plusieurs reprises et qu'il sera donc établi qu'elle résulte d'une absence de volonté de la mettre en oeuvre.

Votre rapporteur, regrette que ces dispositions ne figurent pas expressément et bien plus clairement dans la loi pénale (mais il s'agirait alors plutôt d'instaurer une obligation de moyens). Il estime en tout état de cause juridiquement tortueux ce processus, qui ne pourra reposer en l'état du texte que sur l'engagement quasi-systématique de l'action publique contre les plateformes en cas de non retrait d'un contenu manifestement illicite, pour en démontrer le manque de diligences. Cet engagement supposera d'abord qu'une plainte soit déposée par les personnes ayant demandé le retrait, et que l'autorité judiciaire dispose de moyens suffisants pour engager des poursuites. Si de tels moyens existent désormais, notamment la plainte en ligne, pour faciliter la première étape du processus, ceux du Parquet, comme des juges du siège, demeurent limités et devraient d'abord être consacrés à la poursuite des auteurs des contenus illicites.

Enfin, votre rapporteur relève que la coexistence des deux régimes de responsabilité semble pouvoir amener les opérateurs à subir une double sanction pénale pour un même fait : d'une part, au titre du délit spécifique de « non retrait » en 24 heures d'un contenu haineux (instauré par l'article 1er de la proposition de loi), et d'autre part, au titre de l'infraction constituée par le contenu illicite dont ils assurent le stockage lui-même, l'absence de « prompt retrait » engageant alors leur responsabilité pénale à ce titre (en application du 3 du I de l'article 6 de la LCEN).

3° Une contrariété probable au droit européen

Selon la Commission européenne, à qui le dispositif proposé a été notifié, le texte rédigé par l'Assemblée nationale semble contraire à plusieurs principes majeurs du droit de l'Union européenne : la libre prestation des services , précisée par la directive « e-commerce » pour les services de la société de l'information, ainsi que la liberté d'expression, garantie par la Charte des droits fondamentaux. La Commission mentionne ainsi expressément dans son avis transmis au Gouvernement une possible violation des principes du « pays d'origine », de responsabilité aménagée des hébergeurs , et de l'interdiction d'instaurer une surveillance généralisée des réseaux.

|

Résumé des observations de la Commission européenne

Violation de la libre prestation

- Violation du principe du « pays d'origine » (Article 3(1), (2) et (3)) Les États membres ne peuvent restreindre la libre circulation des services de la société de l'information en provenance d'un autre État membre, et c'est à ce dernier de veiller à ce que les prestataires établis sur son territoire respectent les dispositions relevant du domaine coordonné par la directive « e-commerce » (principe du « pays d'origine »). La proposition de loi s'appliquera aux plateformes en ligne qui atteignent un seuil de connexions depuis le territoire français, sa portée territoriale s'étend donc aux plateformes en ligne établies dans d'autres États membres. Pourtant, la proposition de loi notifiée impose des obligations 24 ( * ) potentiellement très lourdes aux plateformes en ligne. Ces mesures constituent une restriction à la prestation transfrontalière des services. Les seuils prévus pour s'assurer de la proportionnalité de ces obligations sont sans incidence sur le fait qu'un nombre significatif de plateformes sera touché par ces restrictions. Au surplus, ledit seuil d'activité ne résulte d'aucune analyse d'impact quantitative ni qualitative ; aucune information n'a été fournie afin de justifier une corrélation directe entre le nombre de connexions depuis le territoire français et la taille de la plateforme en ligne. - Absence de motifs valables pour déroger à ce principe (Article 3(4)) Toute dérogation au principe du pays d'origine doit être ciblée (« prise à l'encontre d'un service de la société de l'information ») et proportionnelle à l'objectif poursuivi. En ce qui concerne le caractère ciblé des mesures, la Commission n'est pas convaincue que cette exigence soit satisfaite en l'espèce. Elle a également des doutes en ce qui concerne la proportionnalité de cette mesure. |

|

Violation du régime de responsabilité

aménagée des hébergeurs

La directive sur le commerce électronique prévoit, sous certaines conditions, une exclusion de responsabilité pour les fournisseurs de services d'hébergement. Pour en bénéficier, un fournisseur de services d'hébergement se doit d'agir « promptement » pour retirer les informations ou rendre l'accès à celles-ci impossible lorsqu'il en a effectivement connaissance. - L'allègement des notifications : une violation des règles permettant de présumer une prise de connaissance avérée des fournisseurs de services d'hébergement et ainsi d'engager leur responsabilité Du point de vue de la Commission, les conditions minimales de notification prévues dans la proposition de loi (articles 1 er bis et 1 er ter A) ne respecteraient pas les normes établies par la CJUE et les recommandations de la Commission en la matière : elle n'impose en effet plus d'identifier ni l'emplacement exact du contenu illicite, ni les dispositions légales prétendument enfreintes. - L'obligation d'agir dans un délai fixé (24 h) : une charge excessive, un risque de sur-blocage et d'atteinte à la liberté d'expression Selon la directive, un service d'hébergement est tenu d'agir promptement après notification ; ce délai doit être proportionné et raisonnable compte tenu, notamment, du contenu illicite concerné. Il doit également permettre une certaine flexibilité dans certains cas justifiés. La Commission estime qu'il est peu probable que les rares garanties prévues (retrait limité au « manifestement illicite », contre-notifications) soient suffisantes afin de supprimer le risque de sur-blocage et d'atteinte à la liberté d'expression dû à l'établissement d'un délai fixe aussi court (24 heures) et aux lourdes sanctions prévues. - L'obligation d'empêcher la réapparition de contenus haineux : une violation de l'interdiction d'instaurer des obligations générales de surveillance Selon la proposition de loi (article 2), les plateformes en ligne seraient tenues de mettre en oeuvre les moyens appropriés pour empêcher la rediffusion de tout contenu supprimé ou déréférencé. Pour respecter cette obligation, les plateformes en ligne pourraient en pratique être contraintes d'appliquer un filtrage automatique et général de tout leur contenu. La proposition de loi ne fournit pas des garanties appropriées et proportionnées à cet égard. Le champ d'application du texte inclut également des types de contenus nécessitant une évaluation approfondie de leur contexte pour être qualifiées d'illicites. La proposition de loi risque ainsi : - d'entraîner la suppression de contenus licites et par conséquent de porter atteinte à la liberté d'expression ; - de porter atteinte à la protection de la vie privée et des données à caractère personnel des utilisateurs ; - et de porter atteinte à la liberté d'entreprise des plateformes en ligne. |

Rappelant l'existence de plusieurs initiatives législatives européennes en cours, la Commission européenne a invité formellement la France à surseoir à l'adoption de ce texte.

Pressé par votre rapporteur qui souhaitait connaître le contenu de ces observations, l'analyse que le Gouvernement en faisait et les suites qu'il comptait y donner , le cabinet du secrétaire d'État au numérique a refusé de les lui transmettre 25 ( * ) , tout en l'assurant lors de son audition qu'il en serait tenu compte pour procéder à quelques ajustements marginaux , sans remettre en cause sa détermination à faire rapidement aboutir la proposition de loi.

Malgré les questions de votre rapporteur, le Gouvernement a ainsi été incapable de détailler la nature des ajustements requis - ni même de dévoiler le calendrier selon lequel il envisageait d'apporter ces corrections.

Il n'a pas non plus donné suite à la suggestion du président de la commission des lois, Philippe Bas, de lever la procédure accélérée pour permettre, grâce à la poursuite de la navette, d'envisager sereinement de nouvelles solutions plus conformes au droit.

Dès lors, le dispositif prévoyant une nouvelle sanction pénale proposé par l'article 1 er restant manifestement encore inabouti - trop déséquilibré aux dépens de la liberté d'expression, probablement inapplicable et contraire au droit européen -, votre rapporteur n'a pu que proposer au Sénat sa suppression ( amendement COM-26 ).

Certaines dispositions intéressantes méritant cependant d'être conservées ou améliorées, votre commission les a intégrées, à l'initiative du rapporteur, au régime général prévu par la LCEN, en prévoyant ainsi :

- la substitution de messages aux contenus haineux retirés et la possibilité (et non l'obligation) de leur conservation en vue d'enquêtes judiciaires ;

- l' ajout des injures publiques à caractère discriminatoire et du négationnisme aux contenus devant faire l'objet d'un dispositif technique de notification spécifique mis en place par les hébergeurs.

Enfin, l'intitulé du chapitre I er de la proposition de loi a été adapté pour tenir compte de ces modifications.

Votre commission a adopté l'article 1 er ainsi modifié.

Article 1er bis (supprimé)

Formalisme de la nouvelle

procédure de notification

d'un contenu manifestement haineux

L'article 1er bis de la proposition de loi fixe un formalisme allégé pour la nouvelle procédure de notification des contenus haineux auprès des opérateurs de plateforme en ligne à fort trafic.

Par cohérence avec la suppression de la procédure spécifique de signalement de certains contenus haineux auprès des plateformes à fort trafic, à l'article 1 er , votre commission a supprimé le présent article dont les dispositions fixaient un formalisme particulièrement allégé pour ces notifications.

Adoptant en conséquence les amendements identiques COM-27 de votre rapporteur et COM-2 de notre collègue Jean-Pierre Grand, votre commission a supprimé l'article 1 er bis .

Article 1er ter A

(art. 6 de la loi n° 2004-575 pour la confiance

dans l'économie numérique)

Simplification du formalisme des

notifications prévues par la LCEN pour engager de la

responsabilité des hébergeurs à raison de contenus

illicites

Introduit par un amendement du Gouvernement en séance à l'Assemblée nationale, l'article 1 er ter A de la proposition de loi tend à faciliter la procédure de notification des contenus illicites auprès des hébergeurs prévue par la loi pour la confiance dans l'économie numérique (LCEN), en réduisant les informations à fournir par les notifiants.

1. Les notifications prévues par la LCEN : un formalisme rigoureux pour engager de la responsabilité des hébergeurs à raison de contenus illicites

La directive « e-commerce » 26 ( * ) et la loi du 21 juin 2004 pour la confiance dans l'économie numérique (LCEN) qui la transpose 27 ( * ) ménagent un régime de responsabilité atténuée en faveur des hébergeurs . En raison de la nature même de leur activité, qui rend techniquement et économiquement difficile le contrôle de la totalité des contenus stockés, et pour éviter une surveillance généralisée des réseaux qui découlerait d'une responsabilité solidaire et automatique du fait de tous ces contenus, l'engagement de leur responsabilité civile ou pénale est notamment tributaire de la connaissance qu'ils ont, ou pas, du caractère illicite d'un contenu donné .

Les prestataires de services d'hébergement ne peuvent ainsi voir leur responsabilité engagée dans deux hypothèses :

- en l'absence de connaissance de l'illicéité des contenus stockés ;

- en cas de connaissance de l'illicéité manifeste des contenus stockés, s'ils ont procédé promptement à leur retrait.

La philosophie de la directive « e-commerce » repose donc sur le fait que l'illicéité de certains contenus stockés a vocation à être portée à la connaissance des hébergeurs soit à la suite de démarches effectuées de leur propre initiative (les grandes plateformes déploient ainsi des dispositifs automatisés de reconnaissance de certains contenus), soit via les notifications qui leur sont adressées par des tiers.

Ces signalements de contenus illicites ne faisant pas l'objet de développements spécifiques dans la directive « e-commerce », une certaine latitude a été laissée en la matière aux États membres.

En France, pour faciliter l'engagement de la responsabilité des hébergeurs, la LCEN a instauré une présomption de connaissance par ceux-ci de l'existence d'un contenu dès lors que la notification qui leur est adressée comprend certains éléments précis (sur leur auteur, le contenu notifié, l'illicéité alléguée, et les démarches préalables entreprises).

En outre, tout en excluant de mettre à leur charge une obligation générale de surveillance des informations qu'ils traitent, la LCEN soumet les intermédiaires techniques à une obligation particulières de collaboration à la lutte contre certains contenus odieux 28 ( * ) et contre les activités illégales de jeux d'argent. À ce titre, fournisseurs d'accès internet comme hébergeurs doivent mettre en place un dispositif de signalement , « facilement accessible et visible permettant à toute personne de porter à leur connaissance ce type de données », spécifique pour ces infractions .

La méconnaissance de cette obligation est pénalement sanctionnée par un an d'emprisonnement et de 75 000 euros d'amende ou, dans le cas de personnes morales, une amende de 375 000 euros.

2. Une simplification bienvenue qui doit toutefois respecter le droit européen et mieux tenir compte des facilités techniques offertes par les plateformes

L'Assemblée nationale a adopté en séance un amendement du Gouvernement simplifiant drastiquement le formalisme des « notifications LCEN » : les données relatives au notifiant seraient considérablement réduites (l'adresse électronique remplaçant par exemple l'indication des professions, domicile, nationalité, lieu et date de naissance des personnes physiques), l'exigence de « localisation précise » du contenu litigieux disparaîtrait, tout comme celle d'indiquer les dispositions légales violées.

Votre rapporteur salue cette démarche de simplification des mécanismes de notification des contenus, qui doit permettre de faciliter les signalements en évitant un formalisme parfois trop fastidieux qui peut décourager certaines victimes.

Dans ses observations, la Commission européenne estime toutefois que la rédaction envisagée par l'Assemblée nationale risque de ne pas respecter les exigences de la directive « e-commerce ».

Selon elle : « contrairement à la norme établie actuellement dans la LCEN, il ne serait pas nécessaire pour une notification d'identifier l'emplacement exact du contenu faisant l'objet de ladite notification. La recherche active d'un tel emplacement incombe ainsi à la plateforme, qui devra par exemple parcourir de nombreux contenus (comme de longues vidéos ou de longs textes). De plus, le projet notifié supprimerait l'exigence actuelle prévue par la LCEN permettant d'identifier les dispositions légales prétendument enfreintes. Ceci impliquerait que les plateformes en ligne pourraient être amenées à évaluer toutes les dispositions nationales concernant toutes les catégories de contenus relevant de l'article premier »

Dès lors, à l'initiative de votre rapporteur, votre commission a adopté un amendement COM-28 qui, outre une correction rédactionnelle, rétablit l'exigence que la notification, pour valoir présomption de connaissance du contenu signalé auprès des hébergeurs, indique bien :

- premièrement, la localisation précise du contenu,

- et, deuxièmement, les motifs juridiques de l'illicéité alléguée.

Toutefois, par souci de simplicité, votre rapporteur a souhaité tenir compte des possibilités techniques désormais offertes par la plupart des grandes plateformes en réservant explicitement les cas où :

- un dispositif technique directement accessible depuis le contenu litigieux permet de procéder précisément à la notification (la première exigence devrait alors être considérée comme remplie) ;

- la plateforme a prévu un dispositif technique de notification proposant d'indiquer la catégorie d'infraction à laquelle peut être rattaché ledit contenu litigieux (la seconde exigence devrait ainsi être considérée comme remplie).

En outre, il a souhaité dispenser les personnes notifiant des contenus odieux de l'obligation qui leur est faite, sous le régime actuel, d'apporter la preuve des démarches entreprises pour contacter préalablement l'auteur des propos litigieux. Cette exigence de la LCEN est une « sur-transposition » qui ne figure pas dans la directive « e-commerce » et ne résulte ni de la jurisprudence ni des lignes directrices de la commission européenne. Elle ne constitue pas une garantie pour les hébergeurs et, dans le cas très particulier des contenus odieux, obligerait indument les victimes à poursuivre un contact malvenu avec l'auteur de propos haineux.

Votre commission a adopté l'article 1 er ter A ainsi modifié.

Article 1er ter B

(art. 6-2 [nouveau] de la loi n° 2004-575

pour la confiance dans l'économie numérique)

Notification

de contenus haineux par une association

de protection de l'enfance saisie

par un mineur

L'article 1 er ter B de la proposition de loi ouvre aux associations de protection de l'enfance sur internet la possibilité de notifier un contenu haineux lorsqu'elles en sont saisies par un mineur.

Figurant parmi les utilisateurs les plus actifs des réseaux sociaux, l es mineurs sont particulièrement exposés aux cyberviolences et, plus généralement aux contenus illicites . Sans avoir un caractère statistiquement représentatif, une enquête 29 ( * ) réalisée dans les établissements où l'association Génération numérique intervient permet de dresser un premier tableau du phénomène : plus de la moitié des jeunes seraient exposés à des propos haineux sur internet, la tranche d'âge des 15-18 ans étant davantage confrontée aux contenus choquants que celle des 11-14 ans (du fait notamment de sa forte présence sur les réseaux sociaux). Si 42 % des mineurs exposés à des propos choquants sur internet déclare ne pas réagir, c'est à 29 % parce qu'ils ne savaient pas comment répondre, et pour 25 % parce qu'ils considèrent que c'est inutile.

Fruit de réflexions transpartisanes, le présent article, introduit en séance à l'Assemblée nationale, entend dès lors donner un fondement législatif à l'action de certaines associations qui proposent de servir d'interface aux mineurs pour effectuer, à leur place ou en leur nom, la notification auprès des hébergeurs des infractions dont ils sont victimes ou témoins sur internet. Les mineurs bénéficient ainsi de l'appui moral et technique de professionnels qui ont une plus grande familiarité avec les dispositifs de notification, savent plus aisément qualifier juridiquement les propos litigieux, et peuvent leur proposer écoute et conseils pour y faire face.

L'association e-Enfance, reçue en audition par votre rapporteur, opère ainsi un numéro national gratuit et confidentiel (12 000 appels en 2019) ainsi qu'un site internet. Elle bénéficie du statut de « signaleur de confiance » (« trusted flagger ») auprès de la plateforme publique PHAROS et de certains grands opérateurs privés (comme YouTube , par exemple), permettant un traitement accéléré des signalements qui font l'objet d'une pré-qualification juridique.

Le dispositif adopté prévoit ainsi de consacrer dans la loi de telles initiatives en précisant les rôles et obligations respectifs de ces associations (condition d'agrément ; information à chaque stade de la procédure du mineur qui l'a saisie et, obligatoirement, de ses représentants légaux ; conservation des données) et des plateformes (accusé de réception ; obligation de réponse et d'information sur les suites données à la notification).

Lors de leurs auditions, les associations de protection de l'enfance sur internet se sont cependant inquiétées auprès de votre rapporteur de ce que, dans de nombreux cas, les contenus litigieux qui leurs sont signalés pour en obtenir le retrait font référence à la vie affective et aux pratiques ou orientations sexuelles - vraies ou supposées - des victimes mineures, qui ne souhaitent parfois pas les voir dévoilées de cette façon. En l'état, le dispositif proposé risquerait donc de décourager lesdits mineurs de recourir à ces associations pour leur venir en aide.

Pour répondre à ce problème sans revenir sur l'indispensable information due aux représentants légaux, votre commission a adopté l'amendement COM-30 de son rapporteur qui prévoit une exception limitée au cas où cela serait contraire à l'intérêt de l'enfant.

Au bénéfice d'un amendement COM-29 de cohérence rédactionnelle de son rapporteur, votre commission a adopté l'article 1 er ter B ainsi modifié .

Article 1er ter (supprimé)

Sanction des notifications abusives ou

malveillantes

L'article 1 er ter de la proposition de loi tend à créer un délit de signalement abusif d'un contenu sur la base du dispositif prévu à l'alinéa 3 de l'article 1 er de la proposition de loi. Le fait de signaler un contenu comme étant illicite alors que l'inexactitude de ce fait est connue serait sanctionné d'un an d'emprisonnement et de 15 000 euros d'amende.

Cet article reprend la sanction figurant au 4 du I. de l'article 6 de la LCEN qui punit « le fait, pour toute personne, de présenter [...] un contenu ou une activité comme étant illicite dans le but d'en obtenir le retrait ou d'en faire cesser la diffusion, alors qu'elle sait cette information inexacte » « d'une peine d'un an d'emprisonnement et de 15 000 euros d'amende ».

Par cohérence avec la suppression du dispositif auquel cette infraction est liée et dans la mesure où un dispositif équivalent existe déjà dans la LCEN, votre commission a adopté les amendements identiques COM-31 de son rapporteur et COM-4 de notre collègue Jean-Pierre Grand, et supprimé cet article.

CHAPITRE II

DEVOIR DE COOPÉRATION DES OPÉRATEURS

DE

PLATEFORME DANS LA LUTTE CONTRE

LES CONTENUS HAINEUX EN LIGNE

Article 2

(art. 6-2 et 6-3 [nouveaux] de la loi n° 2004-575

pour la confiance dans l'économie numérique)

Obligations

de moyens mises à la charge des plateformes en matière de

traitement des notifications de contenus haineux en ligne

L'article 2 de la proposition de loi vise à organiser une régulation administrative des grandes plateformes en mettant à leur charge de nouvelles obligations de moyens en matière de traitement des notifications de contenus haineux en ligne.

Celles-ci doivent notamment prévoir un dispositif technique de notification directement accessible depuis les contenus, l'envoi d'un accusé de réception et d'informations sur les suites données, la mobilisation de moyens humains et technologiques adaptés à leur traitement rapide, et un mécanisme pour contester les décisions de retrait ou de maintien de contenus.

Votre rapporteur estime que l'imposition d'obligations de moyens sous la supervision d'un régulateur armé de sanctions dissuasives est effectivement la solution la plus pertinente pour contraindre les grandes plateformes à une lutte plus efficace contre les discours de haine véhiculés sur les réseaux.